Cum să răspunzi la mențiuni incorecte ale brandului tău generate de AI

Află strategii eficiente pentru a identifica, monitoriza și corecta informațiile inexacte despre brandul tău în răspunsurile generate de AI precum ChatGPT, Perp...

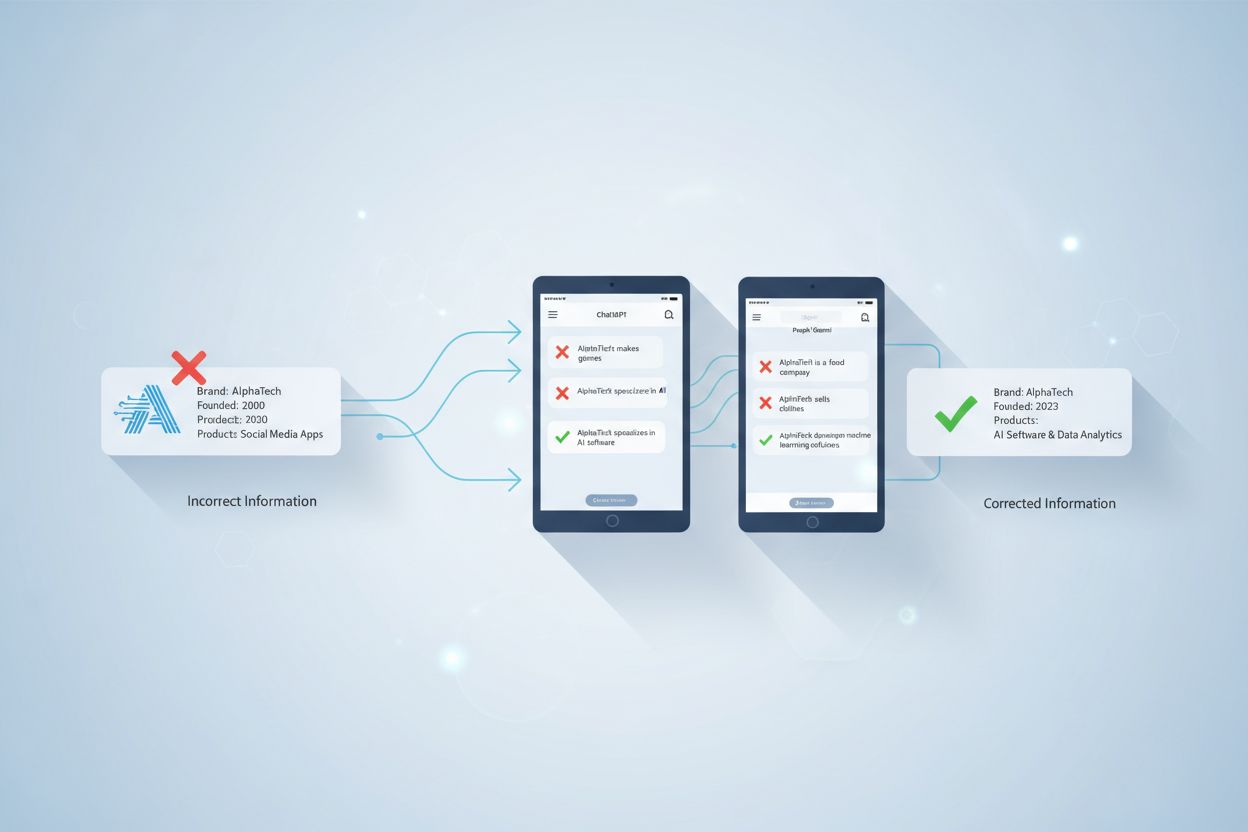

Află cum să contești informațiile inexacte generate de AI, să raportezi erorile către ChatGPT și Perplexity și să implementezi strategii pentru ca brandul tău să fie reprezentat corect în răspunsurile generate de AI.

Puteți contesta informațiile inexacte generate de AI raportându-le direct pe platforma AI, optimizând conținutul pentru sisteme AI, utilizând instrumente de monitorizare a brandului și implementând date structurate pentru a asigura o reprezentare corectă pe ChatGPT, Perplexity și alte motoare de căutare AI.

Informațiile inexacte din răspunsurile AI reprezintă o provocare semnificativă pentru afaceri și persoane în peisajul digital modern. Atunci când sisteme AI precum ChatGPT, Perplexity și Gemini generează informații incorecte despre brandul, produsele sau serviciile tale, acest lucru poate afecta reputația, poate induce în eroare potențialii clienți și poate duce la pierderea unor oportunități de afaceri. Problema este deosebit de acută deoarece aceste motoare de căutare bazate pe AI schimbă fundamental modul în care utilizatorii descoperă și evaluează informațiile online. Având în vedere că 60% din căutările pe Google se încheie fără clic în 2024 și că ratele de clic organic scad la mai puțin de jumătate când apar răspunsuri AI, asigurarea unei reprezentări corecte a brandului în răspunsurile AI a devenit esențială pentru menținerea unui avantaj competitiv.

Sistemele AI generează informații inexacte prin mai multe mecanisme. Aceste sisteme funcționează pe o arhitectură duală formată din cunoștințe pre-instruite și augmentare prin căutare în timp real, ceea ce înseamnă că informațiile incorecte pot fi încorporate în două moduri distincte. În primul rând, informațiile învechite sau incorecte din datele de instruire pot persista în răspunsurile modelului. În al doilea rând, conținutul inexact din surse web actuale poate fi preluat și citat de sistemul AI. Problema fundamentală este că modelele AI sunt concepute să genereze cea mai probabilă succesiune de cuvinte pentru a răspunde la un prompt, nu să verifice dacă informația este corectă. Aceasta înseamnă că AI-ul nu poate distinge între informații corecte și inexacte—pur și simplu produce ceea ce consideră ca fiind cel mai probabil răspuns pe baza datelor sale de instruire.

Majoritatea platformelor AI importante oferă mecanisme pentru ca utilizatorii să raporteze răspunsurile inexacte sau problematice. Perplexity, de exemplu, permite utilizatorilor să raporteze răspunsurile incorecte sau inexacte folosind pictograma steag situată sub răspuns. Utilizatorii pot crea, de asemenea, un tichet de suport prin fereastra de suport a Perplexity sau pot trimite un e-mail direct la support@perplexity.ai cu detalii despre inexactitate. Acest mecanism de raportare ajută platforma să identifice tiparele de dezinformare și să îmbunătățească calitatea răspunsurilor în timp. Atunci când raportezi informații inexacte, este important să fii specific cu privire la ce informație este incorectă, să oferi dovezi ale informației corecte și să explici cum inexactitatea ar putea afecta utilizatorii sau afacerea ta.

ChatGPT și alte platforme AI oferă mecanisme similare de feedback, deși procesul specific variază de la o platformă la alta. Utilizatorii pot, de obicei, să marcheze răspunsurile ca fiind problematice sau inexacte prin butoanele de feedback integrate. Totuși, este important de înțeles că raportarea informațiilor inexacte la nivelul platformei AI este o abordare reactivă—abordează cazuri specifice, dar nu previne apariția lor în viitor. Provocarea reală este că sistemele AI generează continuu răspunsuri noi pe baza datelor de instruire și a rezultatelor de căutare în timp real, astfel încât un singur raport nu poate preveni apariția aceleiași inexactități în răspunsuri viitoare la întrebări similare.

Cea mai eficientă strategie pe termen lung pentru contestarea informațiilor inexacte AI este să optimizezi conținutul special pentru consumul de către sisteme AI. Această abordare, cunoscută sub denumirea de Generative Engine Optimization (GEO), diferă fundamental de SEO-ul tradițional. În timp ce SEO-ul tradițional se concentrează pe poziționarea în paginile cu rezultate de căutare, GEO asigură ca informațiile despre brandul tău să fie citate și încorporate corect în răspunsurile generate de AI. Aceasta implică structurarea și formatarea conținutului pentru a fi ușor de înțeles, extras și citat de platformele AI.

Marcajul de date structurate joacă un rol crucial în acest proces. Prin implementarea schemelor de markup corespunzătoare pe site-ul tău, oferi sistemelor AI informații clare, lizibile de către mașini despre afacerea, produsele și serviciile tale. Acest lucru face mult mai ușor pentru sistemele AI să acceseze date corecte despre brandul tău, în loc să se bazeze pe date învechite sau incorecte din alte surse. În plus, mesajul de brand clar și consecvent pe toate canalele digitale ajută sistemele AI să înțeleagă și să reprezinte corect brandul tău. Atunci când site-ul, profilurile de social media și alte proprietăți online prezintă informații consecvente, AI-ul este mai probabil să citeze aceste informații corecte în răspunsurile sale.

| Strategie | Implementare | Rezultat Așteptat |

|---|---|---|

| Marcaj de Date Structurate | Implementează markup schema.org pe site | Sistemele AI accesează date corecte, lizibile de mașini |

| Optimizare Conținut | Creează conținut clar, factual, bine documentat | Acuratețe îmbunătățită a citărilor în răspunsurile AI |

| Consecvența Brandului | Menține mesaj consecvent pe toate platformele | Confuzie și interpretări greșite reduse |

| Actualizări Regulate | Menține conținutul proaspăt și actual | Sistemele AI prioritizează informații recente, autoritare |

| Construirea Autorității | Dezvoltă relații cu publicații de industrie | Semnale de credibilitate sporite pentru sistemele AI |

Instrumentele de monitorizare a brandului în AI oferă vizibilitate esențială asupra modului în care brandul tău este reprezentat pe diferite platforme AI. Aceste instrumente specializate monitorizează continuu modul în care sistemele AI descriu brandul tău, identifică inconsistențe și urmăresc schimbările în reprezentarea brandului în timp. Folosind aceste instrumente, poți detecta rapid inexactitățile și poți implementa măsuri corective înainte ca acestea să afecteze semnificativ reputația ta.

Platformele cuprinzătoare de monitorizare a brandului AI oferă mai multe capabilități cheie. Ele pot audita modul în care brandul tău apare pe ChatGPT, Perplexity și alte motoare de căutare AI, oferind informații detaliate despre sentimentul brandului, utilizarea cuvintelor cheie și poziționarea competitivă. Aceste instrumente includ adesea Scoruri de Vizibilitate AI care combină mențiuni, citări, sentiment și clasamente pentru a oferi o imagine de ansamblu fiabilă a vizibilității brandului tău în sistemele AI. Prin monitorizarea regulată a prezenței brandului tău în AI, poți identifica tipare de dezinformare, urmări eficiența eforturilor corective și asigura că informațiile corecte sunt citate în răspunsurile AI.

Avantajul utilizării instrumentelor dedicate de monitorizare este că acestea oferă urmărire continuă și sistematică în locul verificărilor manuale ocazionale. Astfel, poți identifica rapid inexactitățile și poți răspunde cu conținut corectiv înainte ca dezinformarea să devină răspândită. În plus, aceste instrumente oferă adesea informații competitive, arătând cum se compară reprezentarea brandului tău în AI față de concurenți și identificând oportunități de îmbunătățire a poziționării.

După ce ai identificat informații inexacte despre brandul tău în răspunsurile AI, cel mai eficient remediu este să creezi și să distribui conținut corectiv, autoritar. Acest conținut ar trebui să abordeze direct inexactitățile și să furnizeze informații clare, factuale, pe care sistemele AI să le poată extrage și cita ușor. Cheia succesului este ca acest conținut corectiv să fie foarte autoritar, bine documentat și optimizat pentru înțelegerea AI.

Conținutul corectiv eficient urmează câteva bune practici. În primul rând, trebuie să conțină declarații clare, factuale care să contrazică direct informațiile inexacte. În loc să enunți doar ce este corect, conținutul ar trebui să explice de ce informația anterioară era greșită și să ofere dovezi care susțin informația corectă. În al doilea rând, conținutul ar trebui să utilizeze formatare structurată cu titluri clare, puncte și secțiuni organizate, astfel încât sistemele AI să poată analiza și înțelege ușor conținutul. În al treilea rând, conținutul trebuie actualizat regulat pentru a reflecta cele mai noi informații despre brandul tău, semnalând sistemelor AI că acestea sunt date autoritare, actualizate și demne de citare.

Strategia de distribuție este la fel de importantă ca și crearea conținutului. Conținutul corectiv ar trebui publicat pe platforme cu autoritate mare, unde sistemele AI sunt susceptibile să îl descopere și să îl citeze. Acestea includ site-ul oficial, publicații de industrie și directoare relevante. Prin distribuirea conținutului corectiv pe mai multe canale, crești șansele ca sistemele AI să găsească și să citeze aceste informații corecte, în loc să se bazeze pe surse învechite sau incorecte. În plus, amplificarea acestui conținut prin social media și influenceri din industrie poate crește vizibilitatea și semnalele de autoritate, făcându-l mai probabil să fie citat de AI.

Halucinațiile AI reprezintă o formă deosebit de dificilă de informații inexacte, în care sistemele AI generează fapte, citări sau surse complet fabricate. Acestea nu sunt simple erori sau interpretări greșite—sunt situații în care AI-ul prezintă cu încredere informații false ca fiind reale. De exemplu, un AI poate cita lucrări de cercetare inexistente, inventa statistici false sau crea citate nereale atribuite unor persoane reale. Aceste halucinații sunt deosebit de problematice deoarece sunt prezentate cu atâta certitudine încât utilizatorii pot să nu le pună la îndoială.

Cauza principală a halucinațiilor AI stă în modul în care aceste sisteme sunt instruite și funcționează. Modelele AI sunt optimizate să genereze text care sună plauzibil, nu să verifice acuratețea factuală. Când un sistem AI întâlnește un prompt pentru care nu are date clare de instruire, poate genera ceea ce pare a fi un răspuns rezonabil pe baza tiparelor din datele sale, chiar dacă acel răspuns este complet fabricat. De aceea sistemele AI generează adesea citări și surse false—creează ceea ce cred că sunt referințe plauzibile, nu extrag surse reale.

Pentru a combate halucinațiile AI despre brandul tău, trebuie să te asiguri că informațiile corecte și autoritare despre brandul tău sunt larg disponibile și ușor de descoperit de către sistemele AI. Atunci când AI-ul are acces la informații clare, factuale, din surse autoritare, este mai puțin probabil să inventeze alternative. De asemenea, monitorizând regulat răspunsurile AI, poți identifica rapid halucinațiile și implementa măsuri corective înainte ca acestea să se răspândească.

În cazurile în care informațiile inexacte generate de AI provoacă prejudicii semnificative afacerii tale, acțiunea legală poate fi necesară. Câteva cazuri de mare profil au creat precedent pentru tragerea la răspundere a sistemelor AI și a operatorilor acestora pentru furnizarea de informații inexacte. De exemplu, Air Canada a fost considerată responsabilă legal după ce chatbot-ul său AI a furnizat informații incorecte despre tarifele pentru situații de deces, rezultând într-o decizie a tribunalului care a stabilit răspunderea companiei pentru reprezentare eronată. Aceste cazuri demonstrează că firmele pot fi trase la răspundere pentru informațiile inexacte generate de sistemele lor AI.

Dincolo de acțiunea legală, consultarea cu consultanți de brand și experți SEO te poate ajuta să dezvolți strategii complete pentru abordarea reprezentărilor greșite pe scară largă. Acești profesioniști te pot ajuta să identifici cauzele principale ale inexactităților, să dezvolți strategii de conținut corectiv și să implementezi abordări sistematice pentru îmbunătățirea reprezentării brandului în sistemele AI. De asemenea, colaborarea cu echipa ta juridică pentru a înțelege drepturile și soluțiile posibile este importantă, mai ales dacă informațiile inexacte cauzează prejudicii de afaceri măsurabile.

Pentru probleme complexe de brand sau reprezentare greșită pe scară largă, asistența profesională este adesea necesară. Specialiștii în Generative Engine Optimization și managementul brandului în AI te pot ajuta să navighezi complexitatea corectării informațiilor inexacte pe multiple platforme AI. De asemenea, ei te pot ajuta să implementezi procese sistematice de monitorizare și corectare pentru a preveni inexactitățile viitoare.

Contestarea eficientă a informațiilor inexacte AI necesită măsurare și urmărire sistematică a eforturilor tale. Prin stabilirea unor metrici clare și monitorizarea progresului în timp, poți determina dacă strategiile tale corective funcționează și poți ajusta abordarea după necesitate. Indicatorii cheie de performanță ar trebui să includă îmbunătățirea acurateței, creșterea vizibilității și schimbările de poziționare competitivă.

Companiile care implementează strategii sistematice de corectare observă de obicei o reducere de 80-95% a erorilor factuale în decurs de 30 de zile, împreună cu îmbunătățiri semnificative ale vizibilității brandului și poziționării competitive. Aceste îmbunătățiri pot fi măsurate prin testarea regulată a răspunsurilor AI la întrebări legate de brand, urmărirea modului în care sistemele AI descriu brandul și monitorizarea sentimentului și a tiparelor de citare. Prin stabilirea unor măsurători de bază înainte de implementarea strategiilor corective, poți demonstra clar impactul eforturilor tale.

De asemenea, urmărirea metricilor de impact asupra afacerii precum calitatea lead-urilor, solicitările clienților și ratele de conversie te poate ajuta să înțelegi consecințele reale ale informațiilor inexacte AI și valoarea eforturilor de corectare. Când poți demonstra că corectarea informațiilor AI inexacte duce la rezultate de afaceri îmbunătățite, va fi mai ușor să justifici investiția în monitorizare și optimizare continuă.

Preia controlul asupra modului în care brandul tău apare în răspunsurile generate de AI. Urmărește mențiunile, sentimentul și vizibilitatea pe ChatGPT, Perplexity și alte platforme AI.

Află strategii eficiente pentru a identifica, monitoriza și corecta informațiile inexacte despre brandul tău în răspunsurile generate de AI precum ChatGPT, Perp...

Află cum să identifici și să corectezi informațiile incorecte despre brand în sistemele AI precum ChatGPT, Gemini și Perplexity. Descoperă instrumente de monito...

Învață metode eficiente pentru a identifica, verifica și corecta informațiile inexacte generate de AI, precum ChatGPT, Perplexity și alte sisteme de inteligență...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.