Vizibilitatea AI în Serviciile Financiare: Conformitate și Optimizare

Monitorizează modul în care brandul tău financiar apare în răspunsurile generate de AI. Află cerințele de conformitate, strategiile de vizibilitate și tehnicile...

Cerințe de reglementare pentru instituțiile financiare de a dezvălui transparent utilizarea inteligenței artificiale în procesele de luare a deciziilor, managementul riscurilor și aplicațiile orientate către client. Acoperă așteptările SEC, CFPB, FINRA și ale altor autorități de reglementare privind documentarea guvernanței AI, performanței modelelor și impactului asupra consumatorilor și piețelor.

Cerințe de reglementare pentru instituțiile financiare de a dezvălui transparent utilizarea inteligenței artificiale în procesele de luare a deciziilor, managementul riscurilor și aplicațiile orientate către client. Acoperă așteptările SEC, CFPB, FINRA și ale altor autorități de reglementare privind documentarea guvernanței AI, performanței modelelor și impactului asupra consumatorilor și piețelor.

Dezvăluirea AI în domeniul financiar se referă la cerințele de reglementare și la cele mai bune practici pentru ca instituțiile financiare să dezvăluie transparent utilizarea inteligenței artificiale în procesele de luare a deciziilor, managementul riscurilor și aplicațiile orientate către client. Aceasta acoperă așteptările SEC, CFPB, FINRA și ale altor autorități de reglementare privind documentarea guvernanței AI, performanței modelelor și potențialelor impacturi asupra consumatorilor și piețelor. În decembrie 2024, Comitetul Consultativ pentru Investitori (IAC) al SEC a avansat o recomandare formală ca agenția să emită ghiduri care să oblige emitenții să dezvăluie informații despre impactul inteligenței artificiale asupra companiilor lor. IAC a menționat o „lipsă de coerență” în dezvăluirile AI actuale, care „poate fi problematică pentru investitorii care caută informații clare și comparabile”. Doar 40% dintre companiile S&P 500 oferă dezvăluiri legate de AI, iar doar 15% furnizează informații despre supravegherea AI la nivelul consiliului, deși 60% dintre companiile S&P 500 consideră AI drept un risc material.

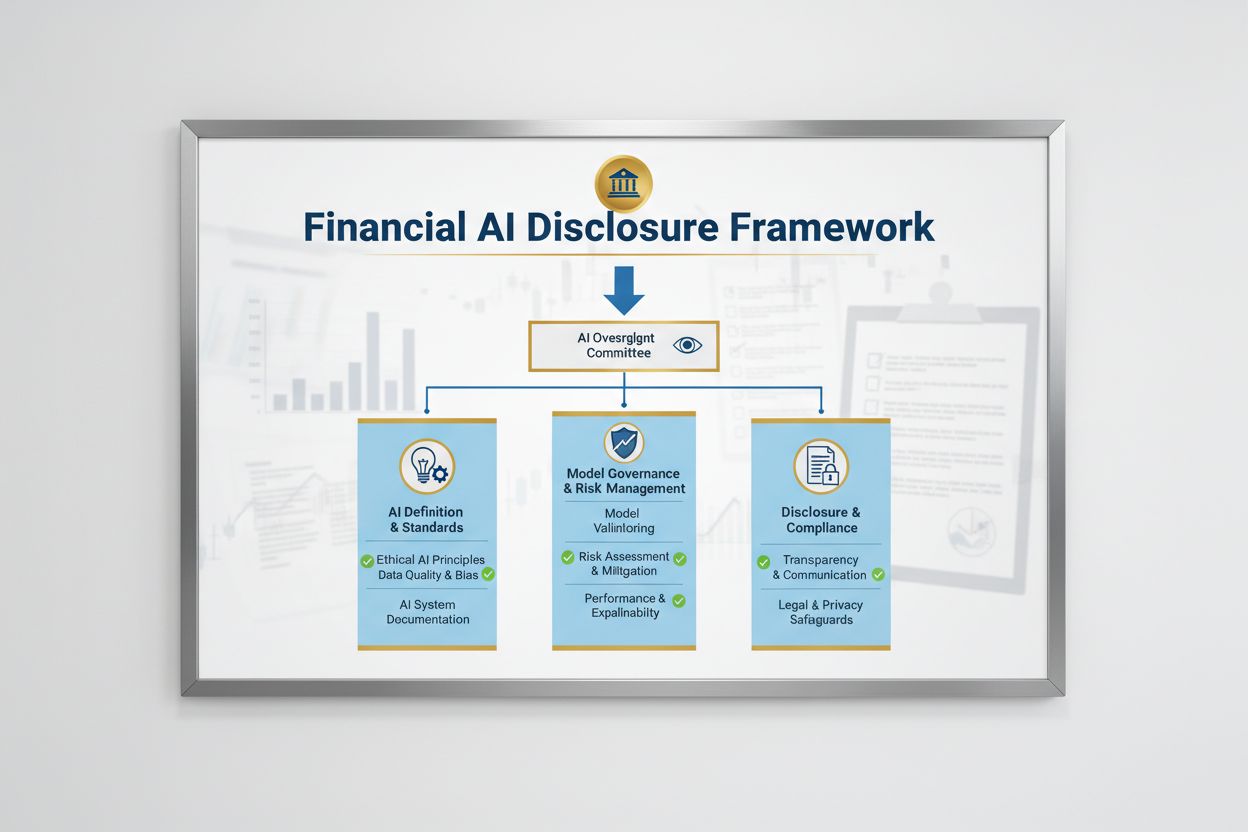

Peisajul de reglementare pentru Dezvăluirea AI în domeniul financiar este definit de mai multe agenții federale care aplică legi existente, neutre din punct de vedere tehnologic, asupra sistemelor AI. Comitetul Consultativ pentru Investitori al SEC a propus un cadru inițial cu trei piloni cheie: (1) obligarea emitenților să definească ce înțeleg prin „Inteligență Artificială”, (2) dezvăluirea mecanismelor de supraveghere la nivelul consiliului pentru implementarea AI și (3) raportarea implementărilor materiale de AI și a efectelor acestora asupra operațiunilor interne și produselor orientate către consumator. Dincolo de SEC, CFPB, FINRA, OCC și Rezerva Federală au emis toate ghiduri subliniind că legile existente de protecție a consumatorilor—including dreptul la împrumut echitabil, confidențialitatea datelor și legile antifraudă—se aplică sistemelor AI indiferent de tehnologia folosită. Aceste agenții abordează tehnologia într-o manieră neutră, ceea ce înseamnă că obligațiile de conformitate conform Equal Credit Opportunity Act (ECOA), Fair Credit Reporting Act (FCRA), Gramm-Leach-Bliley Act (GLBA) și standardele Unfair or Deceptive Acts or Practices (UDAAP) rămân neschimbate când este implicată AI.

| Autoritate de reglementare | Domeniu de focus | Cerință cheie |

|---|---|---|

| SEC | Dezvăluire către investitori, conflicte de interese | Definirea AI, dezvăluirea supravegherii consiliului, raportarea implementărilor materiale |

| CFPB | Împrumut echitabil, protecția consumatorului | Asigurarea conformității modelelor AI cu ECOA, furnizarea notificărilor pentru decizii adverse |

| FINRA | Operațiuni broker-dealer, comunicare cu clienții | Stabilirea politicilor de guvernanță AI, supravegherea utilizării AI în toate funcțiile |

| OCC/Rezerva Federală/FDIC | Guvernanța modelelor bancare, risc operațional | Validarea modelelor AI, documentarea controalelor, evaluarea fiabilității |

| FTC | Practici înșelătoare, gestionarea datelor | Monitorizarea afirmațiilor AI, prevenirea utilizării neloiale a datelor |

O Dezvăluire AI eficientă în domeniul financiar necesită o supraveghere clară la nivelul consiliului de administrație privind implementarea inteligenței artificiale și gestionarea riscurilor. Recomandarea IAC a SEC subliniază că investitorii au un interes legitim în a înțelege dacă există linii clare de autoritate privind implementarea AI asupra operațiunilor interne și a liniilor de produse. Instituțiile financiare trebuie să stabilească structuri de guvernanță care să atribuie responsabilitatea pentru supravegherea AI consiliului de administrație sau unei comisii dedicate, asigurând managementul riscurilor AI la cel mai înalt nivel. Acest cadru de guvernanță ar trebui să includă politici și proceduri documentate pentru dezvoltarea, testarea, validarea și implementarea AI, cu raportări periodice către consiliu privind performanța modelelor, riscurile identificate și acțiunile de remediere. Fără o responsabilitate clară la nivelul consiliului, instituțiile financiare riscă să fie supuse controlului din partea autorităților de reglementare și eventuale sancțiuni pentru supravegherea insuficientă a sistemelor AI materiale.

Instituțiile financiare trebuie să dezvăluie separat efectele materiale ale implementării AI asupra operațiunilor interne și asupra produselor orientate către consumator. Pentru operațiunile interne, dezvăluirile trebuie să abordeze impactul AI asupra capitalului uman (precum reduceri de personal sau necesitatea de recalificare), acuratețea raportării financiare, procesele de guvernanță și riscurile de securitate cibernetică. Pentru aspectele orientate către consumator, instituțiile trebuie să dezvăluie investițiile în platforme bazate pe AI, integrarea AI în produse și servicii, impactul reglementărilor generate de utilizarea AI și modul în care AI influențează strategiile de preț sau reperele de afaceri. SEC recomandă integrarea acestor dezvăluiri în elementele existente ale Regulamentului S-K (cum ar fi Items 101, 103, 106 și 303), pe baza materialității, mai degrabă decât crearea unor categorii noi de dezvăluire. Această abordare permite instituțiilor financiare să valorifice cadrele existente de raportare, oferind investitorilor informații clare și comparabile despre rolul AI în operațiunile și direcția strategică a organizației.

Datele de înaltă calitate sunt fundamentale pentru implementarea responsabilă a AI în serviciile financiare, însă multe instituții întâmpină dificultăți cu cadrele de guvernanță a datelor care să răspundă așteptărilor de reglementare. Instituțiile financiare trebuie să se asigure că datele folosite pentru antrenarea, testarea și validarea modelelor AI sunt curate, complete, standardizate și cuprinzătoare, cu documentație clară a surselor, liniei datelor și a eventualelor limitări cunoscute. Protecțiile de securitate a datelor trebuie să prevină „otrăvirea datelor”—manipularea datelor de antrenament pentru a compromite integritatea modelului—și să protejeze împotriva accesului neautorizat sau a dezvăluirii informațiilor sensibile. Gramm-Leach-Bliley Act (GLBA) oferă protecții de bază pentru datele financiare ale consumatorilor, însă mulți reglementatori și apărători ai consumatorilor susțin că aceste protecții sunt insuficiente în contextul AI, mai ales dată fiind extinderea colectării și utilizării datelor pentru antrenarea modelelor. Instituțiile financiare trebuie să abordeze și preocupările privind proprietatea intelectuală, asigurându-se că au autorizația necesară de a folosi datele pentru dezvoltarea AI și că respectă drepturile de proprietate intelectuală ale terților. Implementarea unor cadre robuste de guvernanță a datelor, incluzând principii de minimizare a datelor, controale de acces și audituri regulate, este esențială pentru a demonstra conformitatea cu așteptările de reglementare.

Autoritățile de reglementare au clarificat că modelele AI folosite în deciziile financiare trebuie testate pentru bias și potențiale rezultate discriminatorii, indiferent de acuratețea sau performanța generală a modelului. Problema „cutiei negre”—unde sistemele AI complexe produc rezultate greu sau imposibil de explicat—creează un risc semnificativ de conformitate, mai ales în aplicațiile orientate către consumator, precum acordarea de credite, stabilirea prețurilor și detectarea fraudelor. Instituțiile financiare trebuie să implementeze procese pentru detectarea și reducerea bias-ului pe tot parcursul ciclului de viață al modelului, inclusiv testarea pentru bias în faza de dezvoltare, validare și monitorizare continuă. Conformitatea cu legislația privind împrumutul echitabil presupune ca instituțiile să poată explica motivele specifice ale deciziilor nefavorabile (de exemplu, refuz de credit) și să demonstreze că modelele AI nu au un impact disproporționat asupra grupurilor protejate. Testarea pentru „alternative mai puțin discriminatorii”—metode care ating aceleași obiective de business reducând în același timp bias-ul—este din ce în ce mai așteptată de reglementatori. Multe instituții adoptă tehnici de AI explicabilă (xAI), precum analiza importanței caracteristicilor și arbori de decizie, pentru a crește transparența și responsabilitatea în deciziile bazate pe AI.

Instituțiile financiare care utilizează AI în aplicații orientate către consumator trebuie să respecte legile existente privind protecția consumatorului, inclusiv cerințele pentru notificări în caz de decizii adverse, dezvăluiri privind confidențialitatea datelor și tratament echitabil. Când un sistem AI este folosit pentru a lua sau influența semnificativ decizii despre credit, asigurări sau alte produse financiare, consumatorii au dreptul să înțeleagă de ce li s-a refuzat sau li s-au oferit condiții mai puțin favorabile. CFPB a subliniat că creditorii supuși Equal Credit Opportunity Act (ECOA) nu au voie să folosească modele „cutie neagră” când nu pot furniza motive specifice și exacte pentru deciziile adverse. De asemenea, standardul Unfair or Deceptive Acts or Practices (UDAAP) se aplică sistemelor bazate pe AI care pot dăuna consumatorilor prin colectarea netransparentă a datelor, încălcarea confidențialității sau orientarea către produse nepotrivite. Instituțiile financiare trebuie să se asigure că sistemele AI folosite în relația cu clienții, recomandări de produse și managementul conturilor sunt transparente cu privire la utilizarea AI și oferă dezvăluiri clare privind modul în care datele consumatorilor sunt colectate, utilizate și protejate.

Majoritatea instituțiilor financiare se bazează pe furnizori terți pentru dezvoltarea, implementarea sau întreținerea sistemelor AI, ceea ce generează obligații importante de management al riscului de la terți (TPRM). Ghidul Interagenții privind Relațiile cu Terții al agențiilor bancare federale subliniază că instituțiile financiare rămân responsabile pentru performanța și conformitatea sistemelor AI dezvoltate de terți, chiar dacă nu au dezvoltat ele însele modelul. Un TPRM eficient pentru AI necesită due diligence riguros înainte de a contracta un furnizor, incluzând evaluarea practicilor de guvernanță a datelor ale furnizorului, proceselor de validare a modelelor și capacitatea de a oferi transparență asupra operațiunilor modelului. Instituțiile financiare trebuie de asemenea să monitorizeze riscul de concentrare—impactul sistemic potențial dacă un număr mic de furnizori AI întâmpină probleme sau eșecuri. Riscurile din lanțul de aprovizionare, incluzând fiabilitatea surselor de date și stabilitatea infrastructurii terților, trebuie evaluate și documentate. Contractele cu furnizorii AI trebuie să includă cerințe clare privind securitatea datelor, monitorizarea performanței modelului, raportarea incidentelor și posibilitatea de audit sau testare a sistemului AI. Instituțiile financiare mai mici, în special, pot întâmpina dificultăți din lipsa expertizei tehnice necesare pentru evaluarea sistemelor AI complexe, ceea ce creează nevoia unor standarde industriale sau programe de certificare pentru facilitarea evaluării furnizorilor.

Instituțiile financiare care operează la nivel transfrontalier se confruntă cu o rețea din ce în ce mai complexă de reglementări AI, Legea AI a Uniunii Europene reprezentând cel mai cuprinzător cadru de reglementare de până acum. Legea UE privind AI clasifică sistemele AI folosite la scorarea creditului, prevenirea fraudelor și combaterea spălării banilor drept „cu risc ridicat”, necesitând documentație extinsă, testare de bias, supraveghere umană și evaluări de conformitate. OECD și G7 au emis, de asemenea, principii și recomandări pentru guvernanța responsabilă a AI în servicii financiare, subliniind transparența, echitatea, responsabilitatea și supravegherea umană. Multe dintre aceste standarde internaționale au efect extraterritorial, ceea ce înseamnă că instituțiile financiare care deservesc clienți din UE, Marea Britanie sau alte jurisdicții reglementate pot fi nevoite să respecte aceste standarde chiar dacă au sediul în altă parte. Eforturile de armonizare a reglementărilor sunt în desfășurare, însă rămân diferențe semnificative între jurisdicții, ceea ce creează provocări de conformitate pentru instituțiile financiare globale. Alinierea proactivă la cele mai ridicate standarde internaționale—precum Legea UE privind AI și principiile OECD—poate ajuta instituțiile să se pregătească pentru evoluțiile viitoare și să reducă riscul de sancțiuni în mai multe jurisdicții.

Instituțiile financiare ar trebui să implementeze practici cuprinzătoare de documentare și guvernanță pentru a demonstra conformitatea cu așteptările privind Dezvăluirea AI în domeniul financiar. Cele mai importante practici includ:

Prin adoptarea acestor practici, instituțiile financiare pot reduce riscul de reglementare, construi încrederea părților interesate și se pot poziționa ca lideri în implementarea responsabilă a AI în industria serviciilor financiare.

Dezvăluirea AI în domeniul financiar se referă la cerințele de reglementare pentru ca instituțiile financiare să își dezvăluie transparent utilizarea inteligenței artificiale în procesele de luare a deciziilor, managementul riscurilor și aplicațiile orientate către client. Aceasta acoperă așteptările SEC, CFPB, FINRA și ale altor autorități de reglementare privind documentarea guvernanței AI, performanței modelelor și impactului asupra consumatorilor și piețelor. Comitetul Consultativ pentru Investitori al SEC a recomandat în decembrie 2024 ca instituțiile financiare să definească utilizarea AI, să dezvăluie mecanismele de supraveghere la nivelul consiliului și să raporteze implementările materiale de AI.

Instituțiile financiare trebuie să dezvăluie utilizarea AI pentru a proteja investitorii, consumatorii și integritatea pieței. Autoritățile de reglementare au constatat că doar 40% dintre companiile din S&P 500 oferă dezvăluiri legate de AI, ceea ce creează inconsistență și lacune de informații pentru investitori. Cerințele de dezvăluire asigură că părțile interesate înțeleg modul în care AI influențează deciziile financiare, managementul riscurilor și rezultatele pentru consumatori. De asemenea, legile existente de protecție a consumatorilor—including dreptul la împrumut echitabil și legislația privind confidențialitatea datelor—se aplică sistemelor AI, făcând dezvăluirea esențială pentru conformitate.

Comitetul Consultativ pentru Investitori al SEC a recomandat trei piloni cheie pentru dezvăluirea AI: (1) obligarea emitenților să definească ce înțeleg prin 'Inteligență Artificială', (2) dezvăluirea mecanismelor de supraveghere la nivelul consiliului pentru implementarea AI și (3) raportarea implementărilor materiale de AI și a efectelor acestora asupra operațiunilor interne și asupra produselor orientate către consumator. Aceste recomandări sunt concepute pentru a oferi investitorilor informații clare și comparabile despre modul în care AI influențează operațiunile și direcția strategică a instituțiilor financiare.

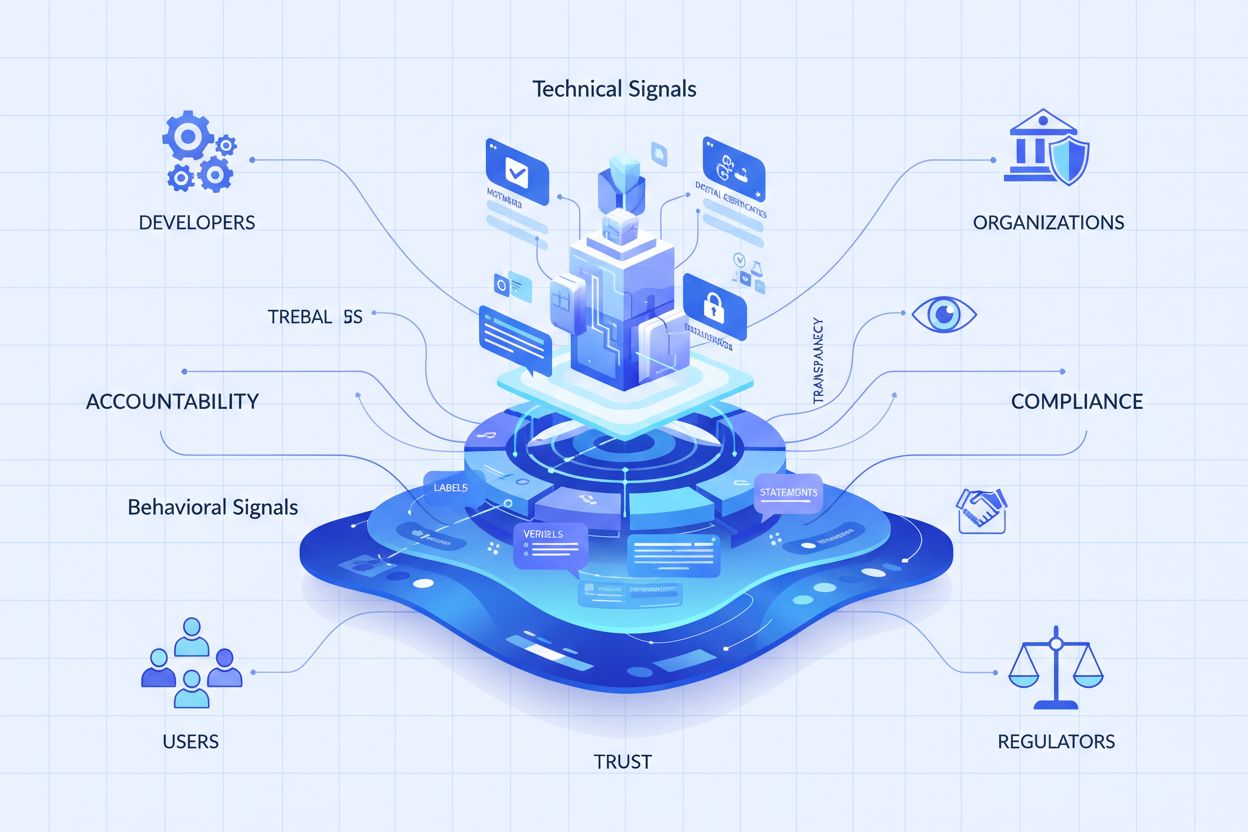

Dezvăluirea AI în domeniul financiar se concentrează specific pe cerințele de reglementare pentru comunicarea transparentă privind utilizarea AI către părțile externe (investitori, autorități de reglementare, consumatori), în timp ce guvernanța AI generală se referă la procesele și controalele interne pentru gestionarea sistemelor AI. Dezvăluirea reprezintă componenta externă a guvernanței AI, asigurând că părțile interesate au acces la informații materiale despre implementarea, riscurile și impactul AI. Ambele sunt esențiale pentru implementarea responsabilă a AI în serviciile financiare.

Dezvăluirile privind implementarea AI trebuie să abordeze atât operațiunile interne, cât și impactul asupra consumatorilor. Pentru operațiunile interne, instituțiile ar trebui să dezvăluie impactul asupra capitalului uman, raportării financiare, guvernanței și riscurilor de securitate cibernetică. Pentru produsele orientate către consumator, dezvăluirile ar trebui să acopere investițiile în platforme bazate pe AI, integrarea AI în produse, impactul reglementărilor și modul în care AI influențează prețurile sau strategiile de afaceri. Dezvăluirile trebuie integrate în elementele de dezvăluire existente (cum ar fi Regulamentul S-K al SEC) pe baza materialității.

Legile privind împrumutul echitabil, inclusiv Equal Credit Opportunity Act (ECOA) și Fair Credit Reporting Act (FCRA), se aplică sistemelor AI utilizate la deciziile de credit, indiferent de tehnologie. Instituțiile financiare trebuie să poată explica motivele specifice ale deciziilor nefavorabile (cum ar fi respingerea unui credit) și să demonstreze că modelele lor AI nu au un impact disproporționat asupra claselor protejate. Autoritățile de reglementare se așteaptă ca instituțiile să testeze modelele AI pentru bias, să implementeze 'alternative mai puțin discriminatorii' acolo unde este cazul și să mențină documentație privind testarea și validarea echității.

Majoritatea instituțiilor financiare se bazează pe furnizori terți pentru sisteme AI, ceea ce creează obligații semnificative de management al riscului de la terți (TPRM). Instituțiile financiare rămân responsabile pentru performanța și conformitatea sistemelor AI dezvoltate de terți, chiar și atunci când nu au dezvoltat modelul intern. Un TPRM eficient pentru AI necesită o analiză riguroasă, monitorizare continuă, evaluarea practicilor de guvernanță a datelor ale furnizorului și documentarea performanței modelului. Instituțiile trebuie de asemenea să monitorizeze riscul de concentrare—impactul sistemic potențial dacă un număr mic de furnizori AI întâmpină probleme.

Legea AI a Uniunii Europene reprezintă cel mai cuprinzător cadru de reglementare pentru AI, clasificând sistemele AI financiare drept 'cu risc ridicat' și solicitând documentație extinsă, testare de bias și supraveghere umană. OECD și G7 au emis de asemenea principii pentru o guvernanță responsabilă a AI. Multe dintre aceste standarde internaționale au aplicabilitate extraterritorială, ceea ce înseamnă că instituțiile financiare care deservesc clienți din jurisdicții reglementate pot fi nevoite să respecte acele standarde. Alinierea proactivă la standardele internaționale poate ajuta instituțiile să se pregătească pentru evoluțiile viitoare și să reducă riscul de sancțiuni.

Urmărește modul în care instituția ta financiară este menționată în răspunsurile AI generate de GPT-uri, Perplexity și Google AI Overviews. Asigură-te că brandul tău menține vizibilitatea și acuratețea în conținutul financiar generat de AI.

Monitorizează modul în care brandul tău financiar apare în răspunsurile generate de AI. Află cerințele de conformitate, strategiile de vizibilitate și tehnicile...

Învață cele mai bune practici esențiale pentru transparență și divulgare AI. Descoperă metode comportamentale, verbale și tehnice de divulgare pentru a construi...

Află cum pot instituțiile financiare să optimizeze pentru motoarele de căutare AI și să asigure vizibilitatea în răspunsurile generate de AI. Descoperă strategi...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.