Licencování obsahu pro AI

Zjistěte více o licenčních smlouvách pro obsah AI, které upravují, jak umělá inteligence používá chráněný obsah. Prozkoumejte typy licencí, klíčové součásti, pl...

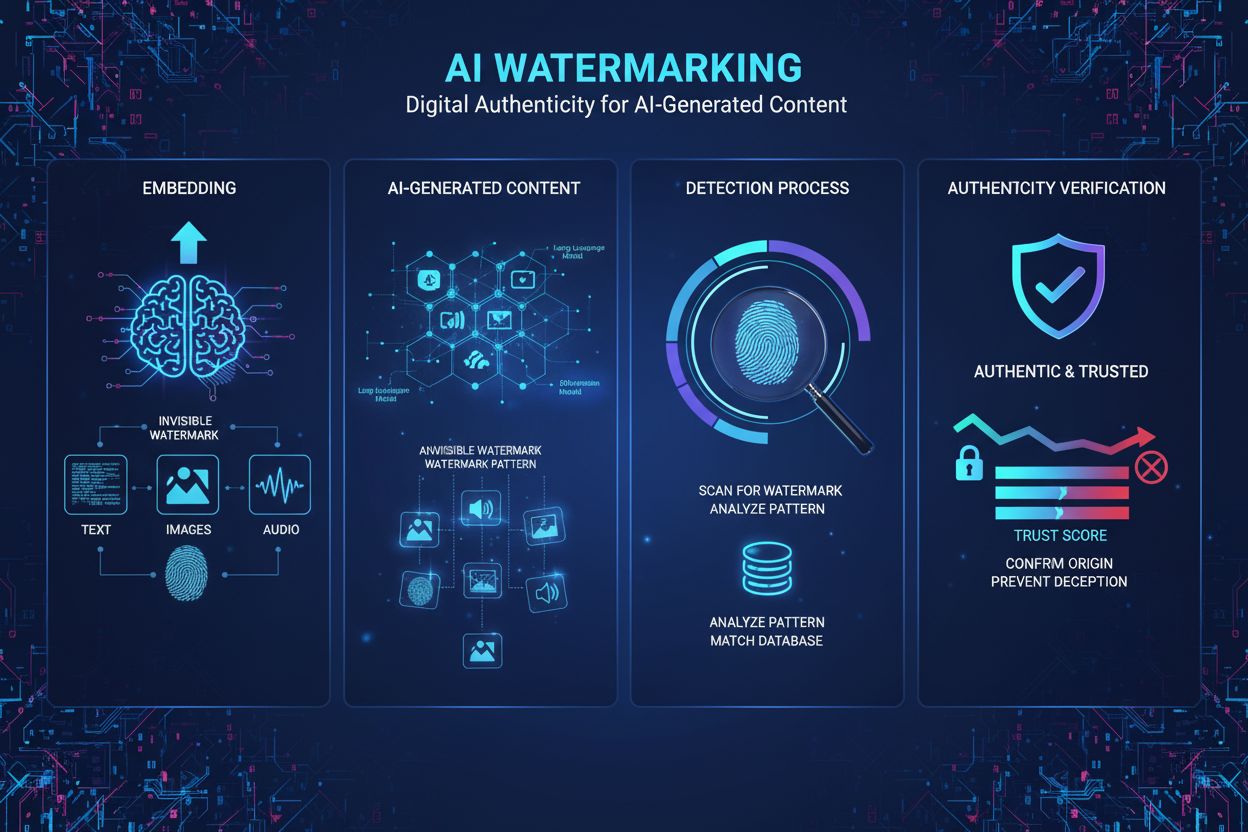

Vodoznakování AI obsahu je proces vkládání neviditelných nebo viditelných digitálních značek do AI-generovaného textu, obrázků, audia nebo videa za účelem identifikace a ověření, že daný obsah byl vytvořen strojem. Tyto vodoznaky slouží jako digitální otisky prstů, které umožňují detekci, ověření a sledování AI-generovaného materiálu napříč platformami a aplikacemi.

Vodoznakování AI obsahu je proces vkládání neviditelných nebo viditelných digitálních značek do AI-generovaného textu, obrázků, audia nebo videa za účelem identifikace a ověření, že daný obsah byl vytvořen strojem. Tyto vodoznaky slouží jako digitální otisky prstů, které umožňují detekci, ověření a sledování AI-generovaného materiálu napříč platformami a aplikacemi.

Vodoznakování AI obsahu označuje proces vkládání digitálních značek, vzorů nebo podpisů do AI-generovaného materiálu za účelem identifikace, ověření a sledování jeho původu. Tyto vodoznaky fungují jako digitální otisky prstů, které odlišují strojově generovaný obsah od lidské tvorby napříč textem, obrázky, audiem i videem. Hlavním cílem vodoznakování AI obsahu je zajistit transparentnost původu obsahu, bojovat proti dezinformacím, chránit duševní vlastnictví a podporovat odpovědnost v rychle se rozvíjejícím prostředí generativní umělé inteligence. Na rozdíl od tradičních vodoznaků viditelných na fyzických dokumentech nebo obrázcích využívají moderní techniky vodoznakování AI často neviditelné vzory detekovatelné pouze speciálními algoritmy – tím zachovávají kvalitu obsahu a zároveň poskytují silné ověřovací schopnosti.

Myšlenka vodoznakování vznikla ve fyzickém světě, kde neviditelné značky na bankovkách a dokumentech sloužily jako ochrana proti padělání. S rozšířením digitálních médií výzkumníci přizpůsobili v 90. a 2000. letech techniky vodoznakování pro obrázky, audio i video. Objev sofistikovaných generativních AI modelů jako ChatGPT, DALL-E a Midjourney v letech 2022–2023 však vytvořil naléhavou potřebu standardizovaných metod ověřování AI obsahu. Prudký rozvoj AI schopností, které dokážou produkovat stále realističtější syntetický obsah, přiměl vlády, technologické společnosti i občanskou společnost upřednostnit vodoznakování jako klíčovou ochranu. Podle výzkumu Brookings Institution více než 78 % podniků uznává důležitost nástrojů pro monitorování AI obsahu při řízení rizik syntetických médií. Zákon EU o AI (EU AI Act), formálně přijatý v březnu 2024, se stal prvním významným regulačním rámcem, který ukládá povinnost vodoznakování AI obsahu a vyžaduje, aby poskytovatelé AI systémů označovali svůj výstup jako AI-generovaný. Tento regulační impuls urychlil výzkum a vývoj vodoznakovacích technologií, přičemž firmy jako Google DeepMind, OpenAI a Meta významně investují do robustních vodoznakových řešení.

Vodoznakování AI funguje na základě dvou hlavních technických přístupů: viditelné vodoznakování a neviditelné vodoznakování. Viditelné vodoznaky zahrnují zjevné popisky, loga nebo textové indikátory přidané k obsahu – například pět barevných čtverců, které DALL-E vkládá do generovaných obrázků, nebo úvodní frázi ChatGPT “as a language model trained by OpenAI”. I když je jejich implementace jednoduchá, lze je snadno odstranit základní editací. Neviditelné vodoznakování naopak vkládá jemné vzory, které jsou pro lidské vnímání nepostřehnutelné, ale detekovatelné specializovanými algoritmy. U AI-generovaných obrázků například technika tree-ring watermarking vyvinutá na University of Maryland vkládá vzory do počátečního náhodného šumu před difúzním procesem, což je činí odolnými vůči ořezu, rotaci i filtrování. U AI-generovaného textu je nejperspektivnější metodou statistické vodoznakování, kdy jazykový model jemně upřednostňuje některé tokeny (“zelené tokeny”) a vyhýbá se jiným (“červené tokeny”) podle předchozího kontextu. Tím vzniká statisticky neobvyklé uspořádání slov, které lze s vysokou jistotou detekovat algoritmy. Audio vodoznakování vkládá nepostřehnutelné vzory do frekvencí mimo rozsah lidského sluchu (pod 20 Hz nebo nad 20 000 Hz), obdobně jako u obrázků, ale přizpůsobené akustickým vlastnostem. Technologie SynthID od Google DeepMind představuje moderní vodoznakování propojeným trénováním generovacích a detekčních modelů, což zajišťuje odolnost vůči transformacím při zachování kvality obsahu.

| Metoda vodoznakování | Typ obsahu | Odolnost | Dopad na kvalitu | Vyžaduje přístup k modelu | Detekovatelnost |

|---|---|---|---|---|---|

| Viditelné vodoznakování | Obrázky, video | Velmi nízká | Žádný | Ne | Vysoká (lidsky) |

| Statistické vodoznakování | Text, obrázky | Vysoká | Minimální | Ano | Vysoká (algoritmicky) |

| Strojové učení | Obrázky, audio | Vysoká | Minimální | Ano | Vysoká (algoritmicky) |

| Tree-ring vodoznakování | Obrázky | Velmi vysoká | Žádný | Ano | Vysoká (algoritmicky) |

| Ověřování původu (C2PA) | Všechna média | Střední | Žádný | Ne | Střední (metadata) |

| Dodatečná detekce | Všechna média | Nízká | N/A | Ne | Nízká (nespolehlivá) |

Statistické vodoznakování je nejperspektivnější technikou pro autentizaci AI-generovaného textu, neboť text postrádá rozměrový prostor obrázků či audia pro vkládání vzorů. Během generace dostává jazykový model instrukce upřednostnit určité tokeny na základě kryptografického klíče známého pouze vývojáři modelu. Náhodnost modelu je podle tohoto schématu “zatížena”, což vede k přednostnímu výběru konkrétních slov či frází a vyhýbání se jiným. Detekční protokoly analyzují generovaný text a vypočítávají pravděpodobnost, že zjištěné vzory vznikly náhodně; statisticky nepravděpodobné vzory značí přítomnost vodoznaku. Výzkum University of Maryland a OpenAI prokázal, že tento přístup dosahuje vysoké přesnosti detekce při zachování kvality textu. Statistické vodoznakování textu však čelí omezením: faktické odpovědi s omezenou variabilitou (například matematická řešení či historická fakta) se vodznakuji obtížněji a důkladné přepsání nebo překlad do jiného jazyka výrazně snižuje detekční jistotu. Implementace SynthID Text, nyní dostupná ve frameworku Hugging Face Transformers v4.46.0+, poskytuje produkčně nasaditelné vodoznakování s konfigurovatelnými parametry včetně kryptografických klíčů a délky n-gramů pro optimalizaci mezi odolností a detekovatelností.

AI-generované obrázky umožňují díky vysoké dimenzionalitě vkládání vzorů pokročilejší vodoznakování. Tree-ring watermarking vkládá skryté vzory do počátečního náhodného obrázku před difúzním procesem, čímž vznikají vodoznaky odolné vůči běžným transformacím jako ořez, rozmazání či rotace, aniž by byla snížena kvalita obrázku. Vodoznakování pomocí strojového učení od společností Meta a Google používá neuronové sítě k vkládání a detekci nepostřehnutelných vodoznaků a dosahuje přesnosti nad 96 % u neupravených obrázků při zachování odolnosti vůči útokům na úrovni pixelů. Audio vodoznakování využívá obdobné principy, vkládá však vzory do frekvencí mimo lidské vnímání. AudioSeal od Meta trénuje generátor i detektor společně tak, aby byly vodoznaky odolné vůči přirozeným úpravám audia a přitom zůstala zachována zvuková kvalita. Technologie využívá perceptuální ztrátu pro zajištění nerozlišitelnosti vodoznakovaného audia od originálu a lokalizační ztrátu pro detekci vodoznaku i při perturbacích. Tyto přístupy ukazují, že neviditelné vodoznakování může při správné implementaci dosáhnout jak odolnosti, tak zachování kvality, i když vyžaduje přístup k AI modelu pro vkládání vodoznaku.

Regulační rámec pro vodoznakování AI obsahu se rychle vyvíjí a více jurisdikcí zavádí či navrhuje povinné požadavky na vodoznakování. Zákon EU o AI (EU AI Act), formálně přijatý v březnu 2024, je nejkomplexnějším právním rámcem a ukládá poskytovatelům AI systémů povinnost označovat svůj výstup jako AI-generovaný obsah. Tato regulace platí pro všechny generativní AI systémy nasazené v EU a vytváří právní povinnost vodoznakování. Kalifornský AI Transparency Act (SB 942), účinný od 1. ledna 2026, ukládá povinnost poskytovatelům AI zpřístupnit zdarma a veřejně nástroje na detekci AI obsahu, což v praxi znamená povinnost vodoznakování či ekvivalentní metody ověřování. Americký zákon o národní obraně (NDAA) pro fiskální rok 2024 obsahuje soutěž na hodnocení vodoznakových technologií a nařizuje ministerstvu obrany studovat a pilotně zavádět “průmyslové otevřené technické standardy” pro vkládání informací o původu obsahu do metadat. Exekutivní příkaz Bílého domu k AI pověřuje ministerstvo obchodu USA identifikací a vývojem standardů pro označování AI obsahu. Tyto regulační iniciativy odrážejí rostoucí shodu, že vodoznakování AI je klíčové pro transparentnost, odpovědnost a ochranu spotřebitelů. Implementační výzvy však zůstávají významné, zejména pokud jde o open-source modely, mezinárodní koordinaci a technickou proveditelnost univerzálních standardů vodoznakování.

Navzdory významnému technickému pokroku čelí vodoznakování AI řadě omezení, která brání praktické efektivitě. Odstranění vodoznaku je stále možné různými technikami: parafrázováním textu, ořezáváním či filtrováním obrázků, překladem obsahu do jiných jazyků nebo použitím adversariálních perturbací. Výzkum Duke University prokázal útoky na detektory vodoznaků založených na strojovém učení, což ukazuje, že i pokročilé metody lze obejít odhodlanými útočníky. Problém ne-univerzálnosti je dalším zásadním omezením – detektory vodoznaků jsou specifické pro konkrétní model, takže uživatelé musí ověřovat původ obsahu u každé AI společnosti zvlášť. Bez centralizovaného registru a standardizovaných detekčních protokolů je ověřování AI původu neefektivní a roztříštěné. Falešně pozitivní výsledky detekce vodoznaků, zejména u textu, zůstávají problémem; algoritmy mohou chybně označit lidský obsah jako AI-generovaný nebo naopak nedetekovat vodoznak po drobných úpravách. Kompatibilita s open-source modely je výzvou z hlediska správy, protože vodoznaky lze odstranit editací kódu. Zhoršení kvality nastává, když algoritmy vodoznakování uměle omezují výstupy modelu, aby vkládaly detekovatelné vzory, což může snížit kvalitu obsahu nebo omezit flexibilitu generace u faktických či striktě strukturovaných úloh. Dopady na soukromí – zejména pokud vodoznaky obsahují identifikační údaje uživatele – vyžadují pečlivé politické zvažování. Navíc jistota detekce výrazně klesá s délkou obsahu; kratší texty i silně modifikovaný obsah mají nižší detekční jistotu, což omezuje užitečnost vodoznakování v některých aplikacích.

Budoucnost vodoznakování AI závisí na pokračujících technických inovacích, harmonizaci regulací a vybudování důvěryhodné infrastruktury pro detekci a ověřování vodoznaků. Výzkumníci zkoumají veřejně detekovatelné vodoznaky, které si zachovají odolnost i při zveřejnění detekčních metod, což by umožnilo decentralizované ověřování bez nutnosti důvěřovat třetím stranám. Standardizační úsilí organizací jako ICANN nebo průmyslových konsorcií by mohlo zavést univerzální protokoly vodoznakování a snížit fragmentaci, umožnit efektivní detekci napříč platformami. Integrace se standardy ověřování původu jako C2PA může přinést vrstvené ověřování kombinující vodoznaky s metadaty sledujícími původ. Vývoj vodoznaků odolných vůči překladu a parafrázování je aktivní výzkumnou oblastí s potenciálem pro vícejazyčnou autentizaci obsahu. Ověřovací systémy založené na blockchainu mohou vytvořit neměnné záznamy o detekci vodoznaků a původu, čímž zvýší důvěru v autentizační výsledky. S dalším rozvojem generativní AI musí techniky vodoznakování držet krok, aby byly účinné i proti sofistikovaným pokusům o obcházení. Regulační impulz daný zákonem EU o AI a kalifornskou legislativou pravděpodobně urychlí globální přijetí standardů vodoznakování a vytvoří tržní pobídky pro robustní technická řešení. Realistická očekávání však uznávají, že vodoznakování bude hlavně řídit správu AI obsahu z populárních komerčních modelů a zůstane omezené v situacích, kde je potřeba okamžitá detekce. Integrace monitorovacích platforem AI obsahu, jako je AmICited, s infrastrukturou vodoznakování umožní organizacím sledovat přisuzování značky napříč AI systémy a zajistit správné uznání při citování jejich domén v AI odpovědích. Budoucí vývoj pravděpodobně zdůrazní spolupráci člověka a AI při autentizaci obsahu, kdy se automatická detekce vodoznaků spojí s lidským ověřováním v klíčových oblastech, jako je žurnalistika, právní řízení a akademická integrita.

Viditelné vodoznaky jsou snadno rozpoznatelné lidmi, například loga nebo textové popisky přidané k obrázkům či audio stopám, ale je jednoduché je odstranit nebo zfalšovat. Neviditelné vodoznaky vkládají jemné vzory, které jsou pro lidské vnímání nepostřehnutelné, ale detekovatelné specializovanými algoritmy, což je činí výrazně odolnějšími proti manipulaci a pokusům o odstranění. Neviditelné vodoznaky se obecně upřednostňují pro autentizaci AI obsahu, protože zachovávají kvalitu obsahu a zároveň poskytují silnější ochranu proti obcházení.

Statistické vodoznakování pro text funguje tak, že jemně ovlivňuje výběr tokenů jazykovým modelem během generování. Vývojář modelu 'zatíží kostky' pomocí kryptografického schématu, díky čemuž model upřednostňuje určité 'zelené tokeny' a vyhýbá se 'červeným tokenům' na základě předchozího kontextu. Detekční algoritmy pak analyzují text, aby zjistily, zda se upřednostňované tokeny vyskytují s neobvykle vysokou statistickou četností, což značí přítomnost vodoznaku. Tento přístup zachovává kvalitu textu a zároveň vkládá detekovatelný otisk.

Klíčové výzvy zahrnují snadné odstranění vodoznaku drobnými úpravami nebo transformacemi, absenci univerzální detekce napříč různými AI modely a obtížnost vodoznakování textu ve srovnání s obrázky nebo audiem. Vodoznakování navíc vyžaduje spolupráci vývojářů AI modelů, není kompatibilní s open-source modely a může zhoršit kvalitu obsahu, pokud není pečlivě implementováno. Významnou technickou překážkou zůstávají i falešně pozitivní a negativní výsledky detekce.

Zákon EU o umělé inteligenci (EU AI Act), formálně přijatý v březnu 2024, požaduje, aby poskytovatelé AI systémů označovali svůj výstup jako AI-generovaný obsah. Kalifornský zákon o transparentnosti AI (SB 942), účinný od 1. ledna 2026, ukládá povinnost poskytovatelům AI zpřístupnit zdarma a veřejně nástroje pro detekci obsahu. Americký zákon o národní obraně (NDAA) pro fiskální rok 2024 obsahuje ustanovení pro vyhodnocení vodoznakovacích technologií a vývoj průmyslových standardů pro ověřování původu obsahu.

Vodoznakování vkládá identifikační vzory přímo do samotného AI-generovaného obsahu, čímž vytváří trvalý digitální otisk, který přetrvá i při kopírování nebo úpravách obsahu. Ověřování původu obsahu, jako je standard C2PA, ukládá metadata o původu a historii úprav zvlášť do metadat souboru. Vodoznakování je odolnější proti obcházení, ale vyžaduje spolupráci vývojářů modelů, zatímco ověřování původu se snáze implementuje, ale lze ho odstranit zkopírováním obsahu bez metadat.

SynthID je technologie společnosti Google DeepMind, která vodoznakuje a identifikuje AI-generovaný obsah vkládáním digitálních vodoznaků přímo do obrázků, audia, textu a videa. U textu používá SynthID procesor logitů, který rozšiřuje generovací pipeline modelu tak, aby zakódoval informace o vodoznaku bez výrazného ovlivnění kvality. Technologie využívá strojové učení k vkládání i detekci vodoznaků, čímž zvyšuje odolnost proti běžným útokům a zároveň zachovává věrnost obsahu.

Ano, motivovaní aktéři mohou vodoznaky odstranit nebo obejít různými technikami, včetně parafrázování textu, ořezávání či filtrování obrázků nebo překladu obsahu do jiných jazyků. Odstranění sofistikovaných vodoznaků však vyžaduje technické znalosti a povědomí o použitém vodoznakovacím schématu. Statistické vodoznaky jsou odolnější než tradiční přístupy, ale výzkum prokázal útoky i na pokročilé vodoznakování, což naznačuje, že žádná metoda vodoznakování není zcela spolehlivá.

Začněte sledovat, jak AI chatboti zmiňují vaši značku na ChatGPT, Perplexity a dalších platformách. Získejte užitečné informace pro zlepšení vaší AI prezence.

Zjistěte více o licenčních smlouvách pro obsah AI, které upravují, jak umělá inteligence používá chráněný obsah. Prozkoumejte typy licencí, klíčové součásti, pl...

Naučte se osvědčené techniky, jak zlidštit AI-generovaný obsah pro lepší citace v AI generátorech odpovědí. Zvýšíte autentičnost, zlepšíte viditelnost ve výsled...

Zjistěte, co je uzemnění obsahu, jak předchází halucinacím AI a proč je nezbytné pro důvěryhodné AI systémy. Objevte techniky, nástroje a osvědčené postupy pro ...

Souhlas s cookies

Používáme cookies ke zlepšení vašeho prohlížení a analýze naší návštěvnosti. See our privacy policy.