Sådan Fejlsøger du AI Crawlingproblemer: Komplet Guide til Problemløsning

Fejlsøg AI-crawlingproblemer med serverlogs, identifikation af user agents og tekniske rettelser. Overvåg ChatGPT-, Perplexity-, Claude-crawlere og løs adgangsp...

Tekniske problemer der forhindrer AI-crawlere i at få adgang til eller korrekt indeksere indhold. Disse fejl opstår, når kunstig intelligens-drevne systemer ikke kan hente, fortolke eller forstå webstedsindhold på grund af tekniske barrierer som JavaScript-afhængigheder, manglende strukturerede data, robots.txt-restriktioner eller serverkonfigurationsproblemer. I modsætning til traditionelle søgemaskine-crawlfejl kan AI-crawlfejl forhindre sprogmodeller og AI-assistenter i nøjagtigt at repræsentere dit indhold i deres systemer.

Tekniske problemer der forhindrer AI-crawlere i at få adgang til eller korrekt indeksere indhold. Disse fejl opstår, når kunstig intelligens-drevne systemer ikke kan hente, fortolke eller forstå webstedsindhold på grund af tekniske barrierer som JavaScript-afhængigheder, manglende strukturerede data, robots.txt-restriktioner eller serverkonfigurationsproblemer. I modsætning til traditionelle søgemaskine-crawlfejl kan AI-crawlfejl forhindre sprogmodeller og AI-assistenter i nøjagtigt at repræsentere dit indhold i deres systemer.

AI-crawlfejl opstår, når kunstig intelligens-drevne crawlere fejler i korrekt adgang, hentning eller fortolkning af indhold fra websteder under deres indekseringsprocesser. Disse fejl repræsenterer en kritisk kløft mellem, hvad dit websted viser til menneskelige besøgende, og hvad AI-systemer faktisk kan forstå og udnytte til træning, hentning eller analyseformål. I modsætning til traditionelle søgemaskine-crawlfejl der primært påvirker synlighed i søgeresultater, kan AI-crawlfejl forhindre sprogmodeller, AI-assistenter og indholdsaggregationsplatforme i nøjagtigt at repræsentere dit indhold i deres systemer.

AI-crawlere fungerer fundamentalt anderledes end traditionelle søgemaskinecrawlere som Googlebot, hvilket kræver forskellige tekniske tilgange for at sikre korrekt indholdstilgængelighed. Mens søgemaskiner har investeret kraftigt i JavaScript-renderingskapaciteter og kan udføre dynamisk indhold, henter og analyserer de fleste AI-crawlere det rå HTML-svar uden at rendere JavaScript, hvilket betyder, at de kun ser, hvad der leveres i det indledende serversvar.

| Karakteristik | Søgemaskinecrawlere | AI-crawlere |

|---|---|---|

| JavaScript-rendering | Fuld renderingskapacitet | Begrænset eller ingen rendering |

| Crawlfrekvens | Periodisk, baseret på autoritet | Ofte hyppigere |

| Robots.txt-overholdelse | Streng overholdelse | Variabel (nogle omgår) |

| User-Agent-gennemsigtighed | Tydeligt identificeret | Nogle gange stealth/sløret |

| Indholdsfortolkning | Søgeords- og linkbaseret | Semantisk forståelse påkrævet |

| Påkrævet svartype | Renderet HTML | Rå HTML eller API-adgang |

AI-crawlfejl manifesterer sig i flere forskellige kategorier, hver kræver forskellige diagnostiske og afhjælpende tilgange. De mest udbredte fejl inkluderer:

JavaScript-rendering repræsenterer en af de mest betydningsfulde barrierer mellem websteder og AI-crawlere, da langt størstedelen af AI-systemer ikke kan udføre klient-side-kode for at afsløre dynamisk genereret indhold. Når dit websted er afhængigt af JavaScript-frameworks som React, Vue eller Angular til at populere indhold efter den indledende sideindlæsning, modtager AI-crawlere en tom eller minimal HTML-skal der ikke indeholder noget faktisk indhold at analysere.

Robots.txt-filen fungerer som den primære mekanisme til at kommunikere crawlpræferencer til automatiserede systemer, men dens effektivitet varierer betydeligt på tværs af forskellige AI-crawlere med forskellige etiske standarder og forretningsmodeller. Traditionelle søgemaskiner som Google respekterer robots.txt-direktiver og vil ikke crawle indhold eksplicit blokeret af disse regler. Dog er AI-crawlerlandskabet mere fragmenteret: nogle AI-virksomheder som OpenAI har forpligtet sig til at respektere robots.txt og giver mekanismer for indholdsskabere til at fravælge indsamling af træningsdata, mens andre anvender stealth-crawlere der bevidst omgår robots.txt-restriktioner.

Strukturerede data og semantisk markup er blevet stadig mere kritiske for AI-systemforståelse, da disse elementer giver eksplicit kontekst der hjælper AI-crawlere med at forstå indholdsbetydning, relationer og entitetsinformation langt mere effektivt end rå tekst alene. Når du implementerer Schema.org-markup, JSON-LD strukturerede data eller andre semantiske formater, skaber du i bund og grund et maskinlæsbart lag der beskriver, hvad dit indhold handler om, hvem der skabte det, hvornår det blev publiceret, og hvordan det relaterer til andre entiteter og koncepter.

Ud over JavaScript og robots.txt kan adskillige tekniske infrastrukturproblemer forhindre AI-crawlere i succesfuldt at få adgang til og behandle dit webstedsindhold. Server-side-problemer som fejlkonfigurerede SSL-certifikater, udløbne HTTPS-certifikater eller forkerte HTTP-headerkonfigurationer kan få crawlere til helt at opgive anmodninger. Rate limiting og IP-blokeringsmekanismer designet til at forhindre misbrug kan utilsigtet blokere legitime AI-crawlere.

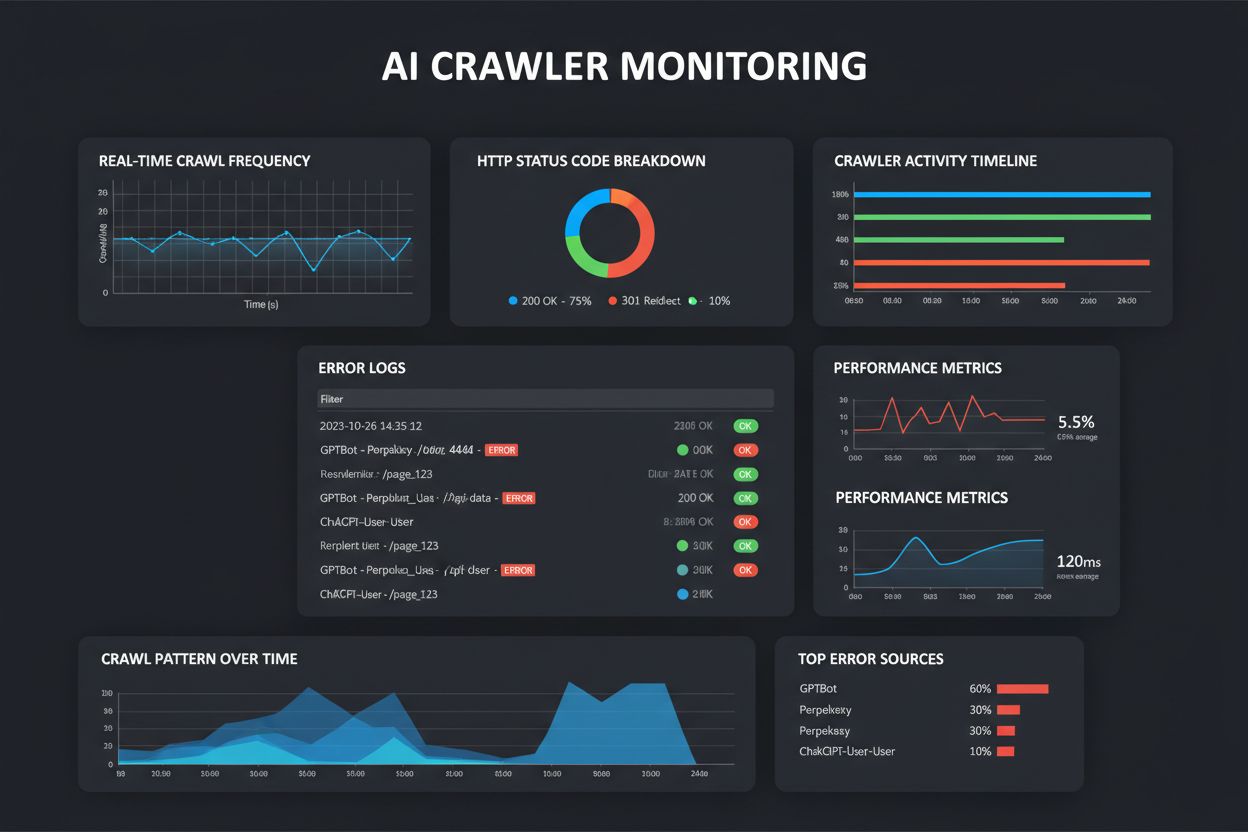

Detektering af AI-crawlfejl kræver en flerlagstilgang til overvågning der går ud over traditionel søgemaskine-crawlfejlrapportering, da de fleste webstedsanalyse- og SEO-værktøjer fokuserer udelukkende på søgemaskinecrawlere frem for AI-systemer. Serverloganalyse giver det grundlæggende lag, der giver dig mulighed for at identificere, hvilke AI-crawlere der får adgang til dit websted, hvor ofte de crawler, hvilket indhold de anmoder om, og hvilke HTTP-statuskoder de modtager som svar. Værktøjer som AmICited.com giver specialiseret overvågning specifikt designet til AI-crawlersporing og fejldetektering.

Løsning af AI-crawlfejl kræver en omfattende strategi der adresserer både den tekniske infrastruktur og indholdsleverings-mekanismerne på dit websted. Start med at auditere dit websteds crawlbarhed ved at teste sider med JavaScript deaktiveret for at identificere indhold der er utilgængeligt for ikke-renderende crawlere, prioriter derefter konvertering af JavaScript-afhængigt indhold til server-side rendering eller levering af alternative indholdsleveringsmetoder. Implementer omfattende Schema.org struktureret data-markup på tværs af alle indholdstyper, sikrende at AI-systemer kan forstå indholdskontekst, forfatterskab, publiceringsdatoer og entitetsrelationer uden udelukkende at stole på naturlig sprogbehandling.

Spor hvordan AI-crawlere som ChatGPT, Perplexity og andre AI-systemer får adgang til dit indhold. Identificer crawlfejl før de påvirker din AI-synlighed og brandcitationer.

Fejlsøg AI-crawlingproblemer med serverlogs, identifikation af user agents og tekniske rettelser. Overvåg ChatGPT-, Perplexity-, Claude-crawlere og løs adgangsp...

Lær hvordan du tillader AI-bots som GPTBot, PerplexityBot og ClaudeBot at crawle dit website. Konfigurer robots.txt, opsæt llms.txt og optimer for AI-synlighed....

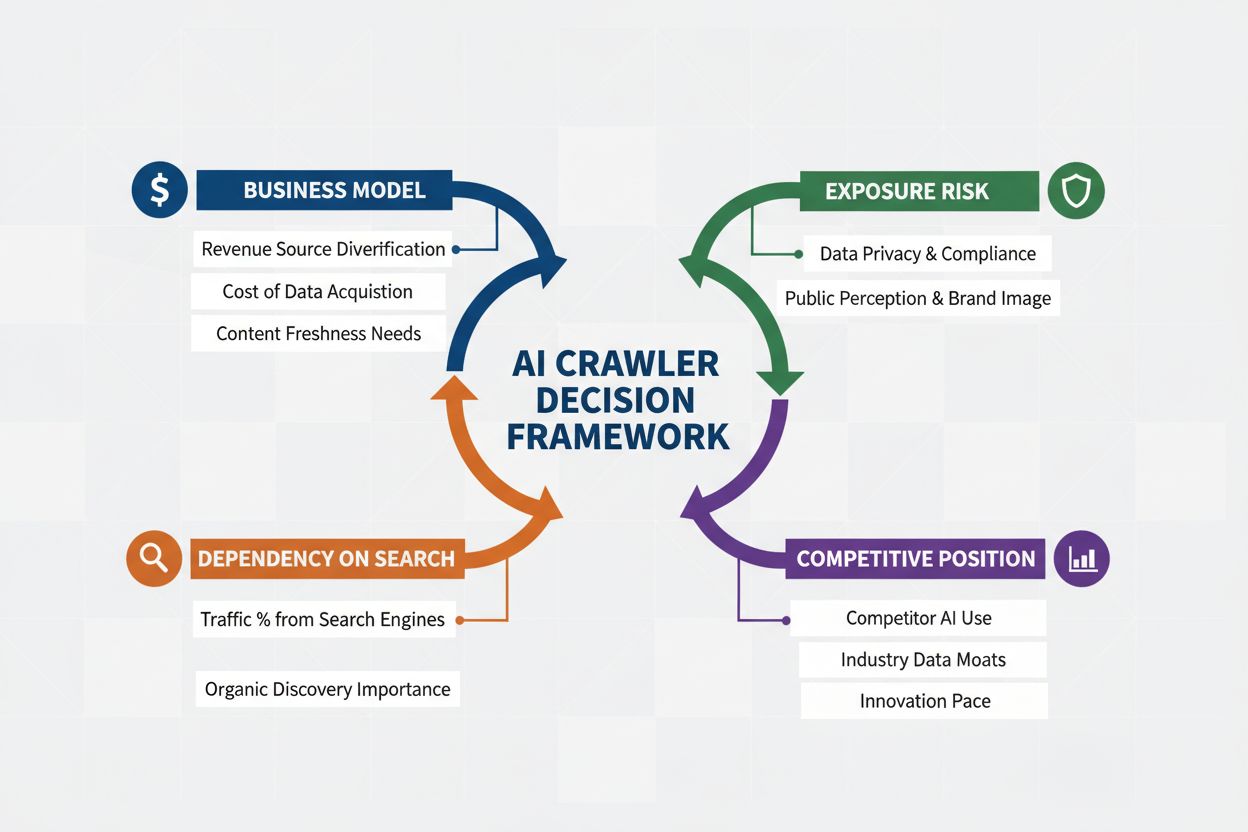

Lær at træffe strategiske beslutninger om blokering af AI-crawlere. Vurder indholdstype, trafikkilder, indtægtsmodeller og konkurrenceposition med vores omfatte...

Cookie Samtykke

Vi bruger cookies til at forbedre din browsingoplevelse og analysere vores trafik. See our privacy policy.