Jak reagować na nieprawidłowe wzmianki AI o Twojej marce

Poznaj skuteczne strategie identyfikowania, monitorowania i korygowania nieprawidłowych informacji o Twojej marce w odpowiedziach generowanych przez AI takich j...

Problemy techniczne uniemożliwiające botom AI dostęp do treści lub ich prawidłowe zaindeksowanie. Błędy te występują, gdy systemy oparte na sztucznej inteligencji nie mogą pobrać, zinterpretować lub zrozumieć zawartości strony z powodu barier technicznych, takich jak zależności od JavaScript, brak danych strukturalnych, restrykcje robots.txt lub problemy z konfiguracją serwera. W przeciwieństwie do tradycyjnych błędów indeksowania przez wyszukiwarki, błędy AI mogą uniemożliwić modelom językowym i asystentom AI właściwe odzwierciedlenie Twoich treści w ich systemach.

Problemy techniczne uniemożliwiające botom AI dostęp do treści lub ich prawidłowe zaindeksowanie. Błędy te występują, gdy systemy oparte na sztucznej inteligencji nie mogą pobrać, zinterpretować lub zrozumieć zawartości strony z powodu barier technicznych, takich jak zależności od JavaScript, brak danych strukturalnych, restrykcje robots.txt lub problemy z konfiguracją serwera. W przeciwieństwie do tradycyjnych błędów indeksowania przez wyszukiwarki, błędy AI mogą uniemożliwić modelom językowym i asystentom AI właściwe odzwierciedlenie Twoich treści w ich systemach.

Błędy indeksowania AI pojawiają się, gdy boty oparte na sztucznej inteligencji nie są w stanie prawidłowo uzyskać dostępu, pobrać lub zinterpretować treści ze stron internetowych podczas procesu indeksowania. Stanowią one istotną lukę między tym, co Twoja witryna prezentuje użytkownikom, a tym, co systemy AI są w stanie rzeczywiście zrozumieć i wykorzystać do uczenia, wyszukiwania czy analizy. W przeciwieństwie do tradycyjnych błędów indeksowania wyszukiwarek, które wpływają głównie na widoczność w wynikach wyszukiwania, błędy AI mogą uniemożliwić modelom językowym, asystentom AI i platformom agregującym treści poprawne przedstawienie Twoich zasobów w ich systemach. Konsekwencje mogą obejmować zarówno błędne przedstawienie marki w odpowiedziach generowanych przez AI, jak i całkowite wykluczenie z zestawów treningowych czy systemów wyszukiwania. Zrozumienie i usunięcie tych błędów jest kluczowe dla utrzymania obecności cyfrowej w coraz bardziej zdominowanym przez AI ekosystemie informacji.

Boty AI działają zasadniczo inaczej niż tradycyjne boty wyszukiwarek, takie jak Googlebot, wymagając odmiennych podejść technicznych, by zapewnić prawidłowy dostęp do treści. Podczas gdy wyszukiwarki inwestują w zaawansowane możliwości renderowania JavaScriptu i radzą sobie z dynamiczną zawartością, większość botów AI pobiera i analizuje surową odpowiedź HTML bez renderowania JavaScriptu, widząc wyłącznie to, co zostanie dostarczone w początkowej odpowiedzi serwera. Powoduje to poważny podział techniczny: strona może poprawnie renderować się pod Googlebotem, ale być całkowicie niedostępna dla systemów AI, które nie wykonują kodu po stronie klienta. Dodatkowo boty AI często pracują w innych częstotliwościach i według odmiennych wzorców user-agentów, a niektóre – jak te wykorzystywane przez Perplexity – stosują techniki ukrytego indeksowania omijające tradycyjne ograniczenia robots.txt, podczas gdy inne, jak bot OpenAI, przestrzegają etycznych praktyk indeksowania. Tabela poniżej ilustruje kluczowe różnice:

| Cechy | Boty wyszukiwarek | Boty AI |

|---|---|---|

| Renderowanie JavaScript | Pełne możliwości renderowania | Ograniczone lub brak renderowania |

| Częstotliwość indeksowania | Okresowa, zależna od autorytetu | Często wyższa częstotliwość |

| Przestrzeganie robots.txt | Ścisłe przestrzeganie | Zmienna (niektóre omijają) |

| Transparentność user-agenta | Wyraźnie identyfikowane | Czasem ukryte/zamaskowane |

| Interpretacja treści | Na podstawie słów kluczowych i linków | Wymagana interpretacja semantyczna |

| Typ odpowiedzi | Renderowany HTML | Surowy HTML lub dostęp przez API |

Błędy indeksowania AI występują w kilku kategoriach, z których każda wymaga osobnej diagnozy i działań naprawczych. Najczęściej spotykane błędy to:

Renderowanie JavaScriptu stanowi jedną z największych barier między stronami internetowymi a botami AI, ponieważ zdecydowana większość systemów AI nie wykonuje kodu po stronie klienta, aby zobaczyć dynamicznie generowaną zawartość. Jeśli Twoja strona opiera się na frameworkach takich jak React, Vue czy Angular i uzupełnia treść po załadowaniu strony, boty AI odbierają pustą lub niemal pustą ramkę HTML, bez wartościowych treści do analizy. To poważny problem z dostępnością: strona może prezentować się świetnie i działać bez zarzutu dla użytkowników, podczas gdy systemy AI widzą wyłącznie kod JavaScript, a nie efekt końcowy. Różnica jest kluczowa, ponieważ boty AI analizują surową odpowiedź HTTP – to, co serwer zwraca przed przetworzeniem w przeglądarce – zamiast finalnego DOM widocznego dla użytkownika. Aby rozwiązać ten problem, wdrażaj renderowanie po stronie serwera (SSR), generowanie statycznych stron (SSG), korzystaj z usług dynamicznego renderowania lub zapewnij alternatywne metody dostarczania treści, np. API dostępne dla botów AI.

Plik robots.txt to podstawowy sposób komunikowania preferencji indeksowania systemom automatycznym, lecz jego skuteczność wśród różnych botów AI – o odmiennych standardach etycznych i modelach biznesowych – jest bardzo zróżnicowana. Tradycyjne wyszukiwarki, jak Google, respektują dyrektywy robots.txt i nie indeksują treści wyraźnie zablokowanych, przez co ten plik jest narzędziem skutecznym w kontroli dostępu wyszukiwarek. Krajobraz botów AI jest jednak bardziej rozproszony: niektóre firmy, np. OpenAI, deklarują przestrzeganie robots.txt i umożliwiają twórcom treści rezygnację z włączania ich w zestawy treningowe, inne zaś stosują ukryte boty celowo omijające ograniczenia robots.txt. To powoduje, że właściciele stron nie mogą polegać wyłącznie na robots.txt, jeśli chcą skutecznie ograniczyć dostęp botów AI, zwłaszcza w kontekście zabezpieczenia treści przed użyciem w danych treningowych AI. Najskuteczniejsze podejście to połączenie zasad robots.txt z dodatkowymi środkami technicznymi, takimi jak narzędzia monitorujące, wdrożenie reguł user-agent dla znanych botów AI i korzystanie z platform typu AmICited.com, które pozwalają śledzić i weryfikować zachowanie botów względem zadeklarowanych polityk.

Dane strukturalne i znaczniki semantyczne nabierają kluczowego znaczenia dla zrozumienia treści przez systemy AI, ponieważ dostarczają im jednoznacznego kontekstu pozwalającego dużo skuteczniej interpretować treść, powiązania i informacje o encjach niż sam tekst. Wdrażając oznaczenia Schema.org, dane strukturalne w JSON-LD lub inne formaty semantyczne, tworzysz warstwę czytelną dla maszyn, która opisuje, o czym jest dana treść, kto ją stworzył, kiedy została opublikowana i jak się odnosi do innych podmiotów czy zagadnień. Systemy AI w dużym stopniu opierają się na tych informacjach, by trafnie prezentować treści, generować bardziej adekwatne odpowiedzi i rozpoznawać autorytet źródła. Przykładowo artykuł newsowy z odpowiednim schema typu NewsArticle pozwala AI zidentyfikować datę publikacji, autora, tytuł i treść z dużą pewnością, podczas gdy te same treści bez znaczników wymagają domyślania się tych informacji na podstawie analizy języka naturalnego, co jest znacznie bardziej podatne na błędy. Brak danych strukturalnych zmusza boty AI do zgadywania, co często prowadzi do błędnych interpretacji, nieprawidłowego przypisania lub nierozpoznania kluczowych rozróżnień treści. Wdrażanie kompleksowych oznaczeń Schema.org dla wszystkich typów treści – niezależnie czy są to artykuły, produkty, organizacje czy wydarzenia – znacząco poprawia sposób, w jaki AI interpretuje i wykorzystuje Twoje zasoby.

Oprócz kwestii JavaScript i robots.txt, liczne problemy infrastrukturalne mogą uniemożliwić botom AI skuteczny dostęp i przetwarzanie zawartości Twojej strony. Problemy po stronie serwera, takie jak błędnie skonfigurowane certyfikaty SSL, wygasłe certyfikaty HTTPS czy nieprawidłowe nagłówki HTTP, mogą powodować porzucenie żądania przez boty, szczególnie te, które stawiają wyższe wymagania bezpieczeństwa niż tradycyjne przeglądarki. Mechanizmy limitowania zapytań lub blokady IP wdrożone w celu ochrony przed nadużyciami mogą nieumyślnie blokować legalne boty AI, zwłaszcza jeśli systemy bezpieczeństwa nie rozpoznają user-agenta lub zakresu IP danego bota. Nieprawidłowe nagłówki Content-Type, brak lub błędne deklaracje kodowania znaków oraz niepoprawny HTML mogą powodować błędną interpretację lub nieprawidłowe parsowanie treści przez boty AI. Ponadto zbyt agresywne strategie cachowania, które serwują identyczną treść niezależnie od user-agenta, mogą uniemożliwić botom otrzymanie właściwej wersji treści, a niewydolność serwera (przekroczenia czasu, powolne odpowiedzi) może przekroczyć limity czasu botów AI.

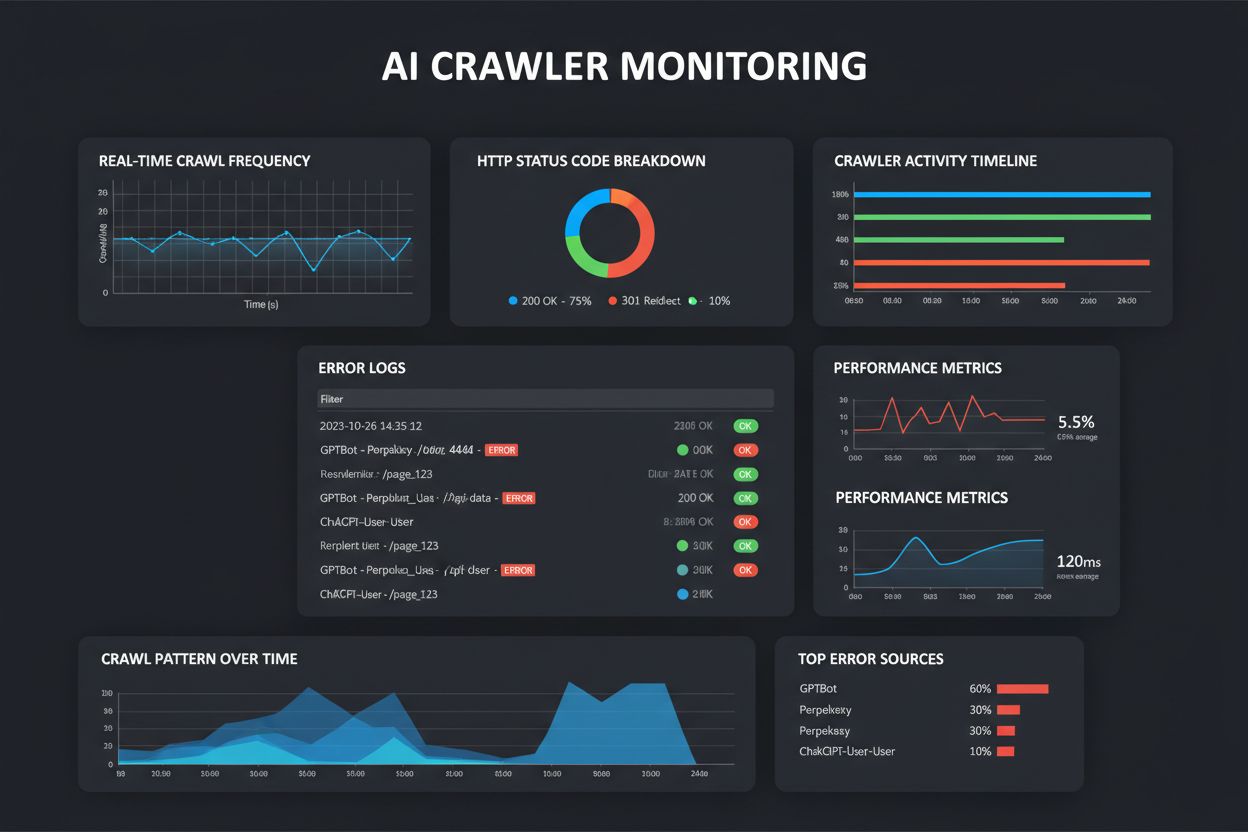

Wykrywanie błędów indeksowania AI wymaga wielowarstwowego monitoringu wykraczającego poza tradycyjne raportowanie błędów indeksowania wyszukiwarek, ponieważ większość narzędzi analitycznych i SEO koncentruje się wyłącznie na botach wyszukiwarek, a nie na systemach AI. Analiza logów serwera to podstawa – pozwala zidentyfikować, które boty AI odwiedzają stronę, z jaką częstotliwością, jakie treści pobierają i jakie kody HTTP otrzymują w odpowiedzi. Analizując user-agenty w logach dostępowych, możesz rozpoznać konkretne boty AI, takie jak GPTBot, bot Perplexity czy inne systemy AI, oraz prześledzić ich wzorce indeksowania i skuteczność. Narzędzia typu AmICited.com oferują specjalistyczny monitoring zaprojektowany właśnie do śledzenia aktywności botów AI i wykrywania błędów, dając wgląd w to, jak różne systemy AI uzyskują dostęp i interpretują Twoje treści. Dodatkowo możesz przeprowadzać testy manualne, symulując zachowanie botów AI – wyłączając JavaScript w przeglądarce, pobierając strony przez curl lub wget jako surowy HTML i analizując, jakie treści są faktycznie dostępne dla botów nierenderujących. Monitorowanie obecności Twoich treści w odpowiedziach generowanych przez AI oraz wynikach wyszukiwania systemów takich jak ChatGPT, Perplexity czy Claude pozwala zweryfikować, czy treści są prawidłowo indeksowane i prezentowane, co daje praktyczną ocenę stanu indeksowalności.

Usuwanie błędów indeksowania AI wymaga kompleksowego podejścia obejmującego zarówno infrastrukturę techniczną, jak i mechanizmy dostarczania treści. Zacznij od audytu indeksowalności – testuj strony z wyłączonym JavaScriptem, by zidentyfikować treści niedostępne dla botów nierenderujących, a następnie priorytetowo przenieś takie treści na renderowanie po stronie serwera lub zapewnij alternatywne metody dostarczania. Wdróż pełne oznaczenia Schema.org dla wszystkich typów treści, tak by systemy AI mogły zrozumieć kontekst, autorstwo, daty publikacji i powiązania encji bez polegania wyłącznie na przetwarzaniu języka naturalnego. Przejrzyj i zoptymalizuj robots.txt, by wyraźnie zezwalać na dostęp botom AI, którym chcesz udostępnić treści, jednocześnie blokując te, którym nie chcesz – pamiętaj jednak o ograniczeniach tej metody wobec botów nieprzestrzegających zasad. Zapewnij solidną infrastrukturę techniczną: weryfikuj ważność certyfikatów SSL, konfiguruj prawidłowo nagłówki HTTP, stosuj właściwe deklaracje Content-Type i kodowania znaków oraz dbaj o wydajność serwera. Monitoruj faktyczną obecność swoich treści w systemach AI i korzystaj z narzędzi takich jak AmICited.com, by śledzić dostęp botów AI i wykrywać błędy na bieżąco. Ustal regularny harmonogram monitoringu błędów: analizuj logi serwera pod kątem aktywności botów AI, sprawdzaj kody odpowiedzi i wzorce, by szybko wykrywać nowe problemy, zanim wpłyną one na widoczność treści w AI. Na koniec, śledź rozwój standardów i najlepszych praktyk dotyczących botów AI, bo krajobraz ten dynamicznie się zmienia – pojawiają się nowe boty, aktualizowane są wytyczne etyczne i wymagania techniczne.

Śledź, jak boty AI takie jak ChatGPT, Perplexity i inne systemy AI uzyskują dostęp do Twoich treści. Wykrywaj błędy indeksowania, zanim wpłyną na widoczność Twojej marki w AI.

Poznaj skuteczne strategie identyfikowania, monitorowania i korygowania nieprawidłowych informacji o Twojej marce w odpowiedziach generowanych przez AI takich j...

Poznaj kluczowe błędy, które niszczą widoczność Twojej marki w wyszukiwaniu AI. Dowiedz się, jak zła struktura treści, brak oznaczeń schema i inne błędy GEO uni...

Dyskusja społeczności na temat kluczowej różnicy między indeksowaniem w wyszukiwarkach a cytowaniem przez AI. Prawdziwe spostrzeżenia od SEOwców uczących się, d...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.