Visuele zoekopdrachten en AI: Afbeeldingen optimaliseren voor AI-ontdekking

Ontdek hoe visuele zoekopdrachten en AI de manier waarop afbeeldingen worden gevonden transformeren. Optimaliseer je afbeeldingen voor Google Lens, AI Overviews...

Ontdek hoe Google Lens visuele zoekopdrachten transformeert met jaarlijks 100+ miljard zoekopdrachten. Leer optimalisatiestrategieën om ervoor te zorgen dat jouw merk verschijnt in visuele ontdekkingsresultaten en koopgerichte bezoekers aantrekt.

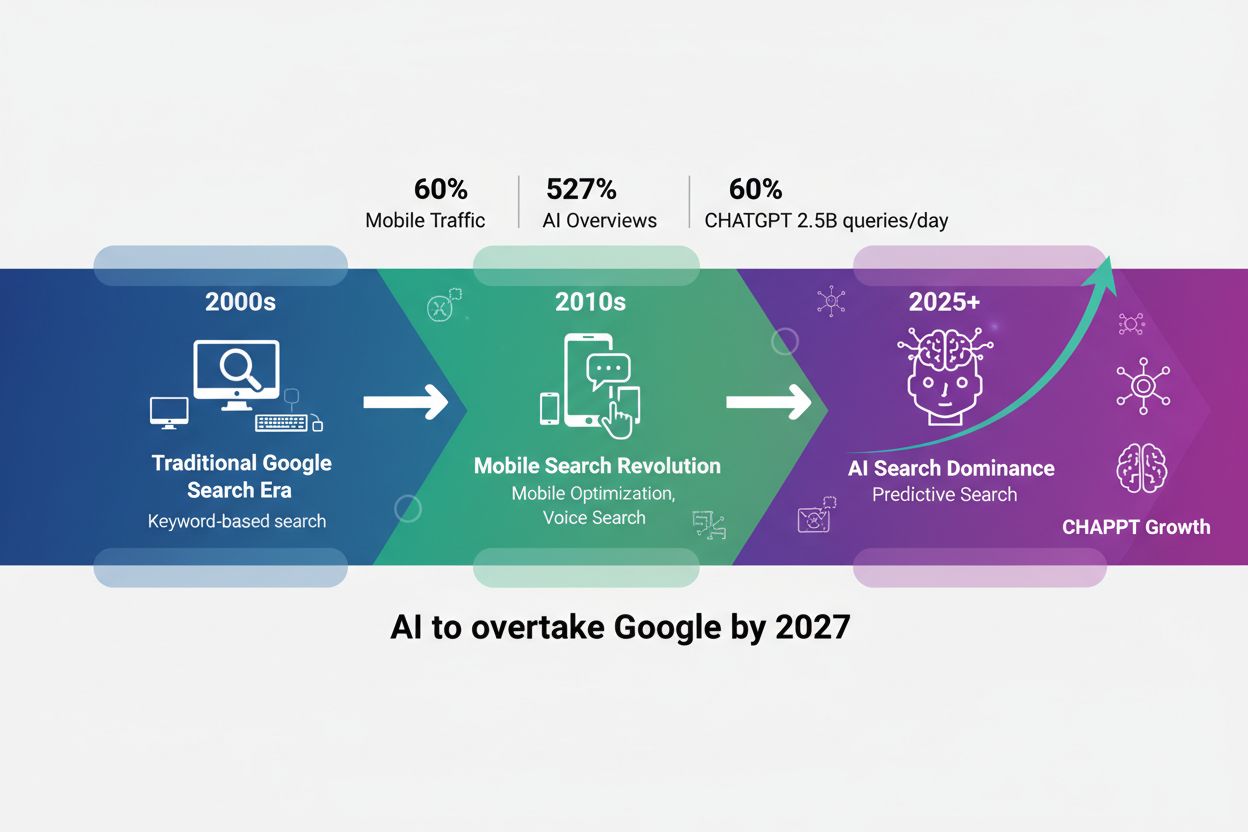

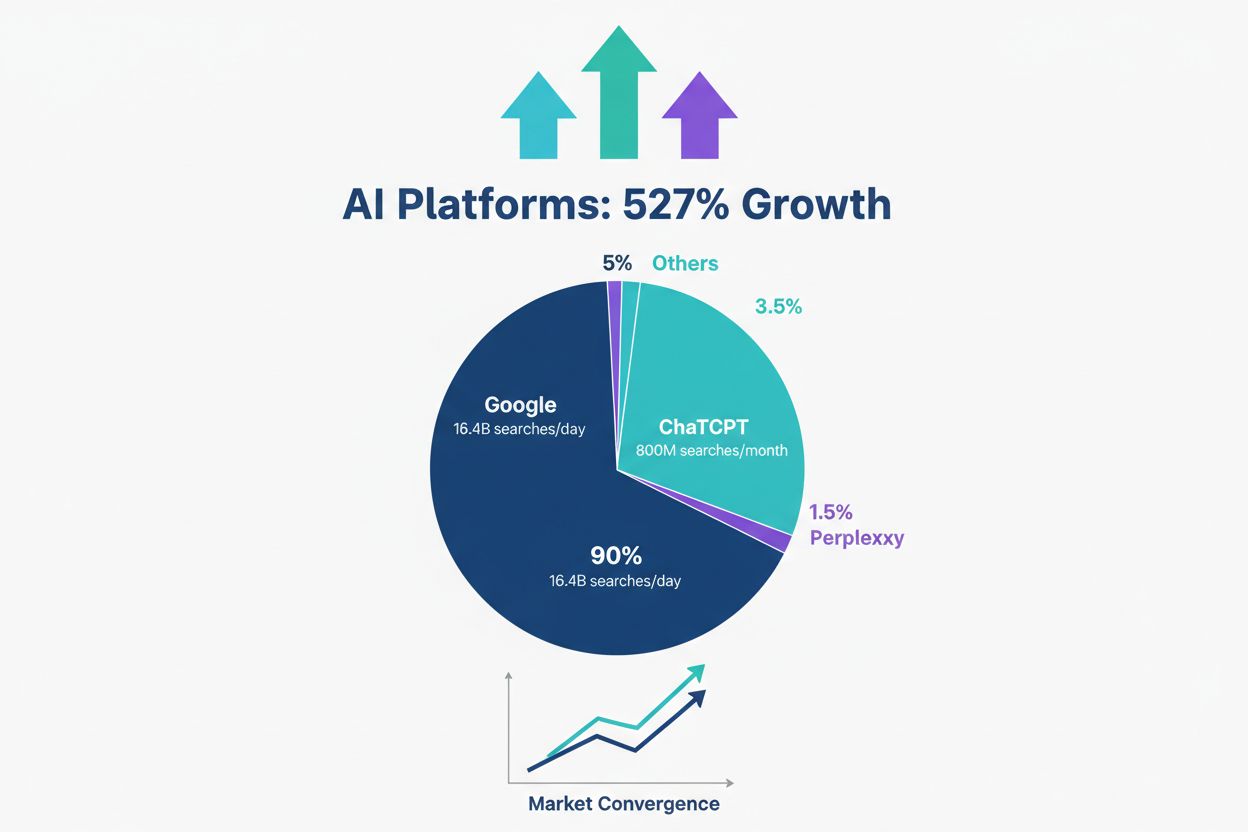

Visuele zoekopdrachten hebben fundamenteel veranderd hoe mensen online informatie ontdekken, waarbij de verschuiving plaatsvindt van tekstgebaseerde zoekopdrachten naar camera-eerst interacties. Google Lens, de toonaangevende visuele zoektechnologie van het bedrijf, is nu goed voor bijna 20 miljard visuele zoekopdrachten per maand, met in 2024 alleen al meer dan 100 miljard visuele zoekopdrachten via Lens en Circle to Search. Deze explosieve groei weerspiegelt een bredere gedragsverandering bij consumenten: mensen geven er steeds vaker de voorkeur aan hun camera ergens op te richten waarover ze meer willen weten, in plaats van een omschrijving te typen.

Het bereik van het platform is verbluffend: 1,5 miljard mensen gebruiken Google Lens nu maandelijks, waarbij jongere gebruikers van 18-24 jaar de hoogste betrokkenheid tonen. Wat dit bijzonder relevant maakt voor merken is dat één op de vijf van deze visuele zoekopdrachten—ongeveer 20 miljard zoekopdrachten—directe koopintentie heeft. Dit zijn geen vrijblijvende zoekopdrachten uit nieuwsgierigheid; het zijn potentiële klanten die actief op zoek zijn om iets te kopen dat ze in het echt hebben gezien.

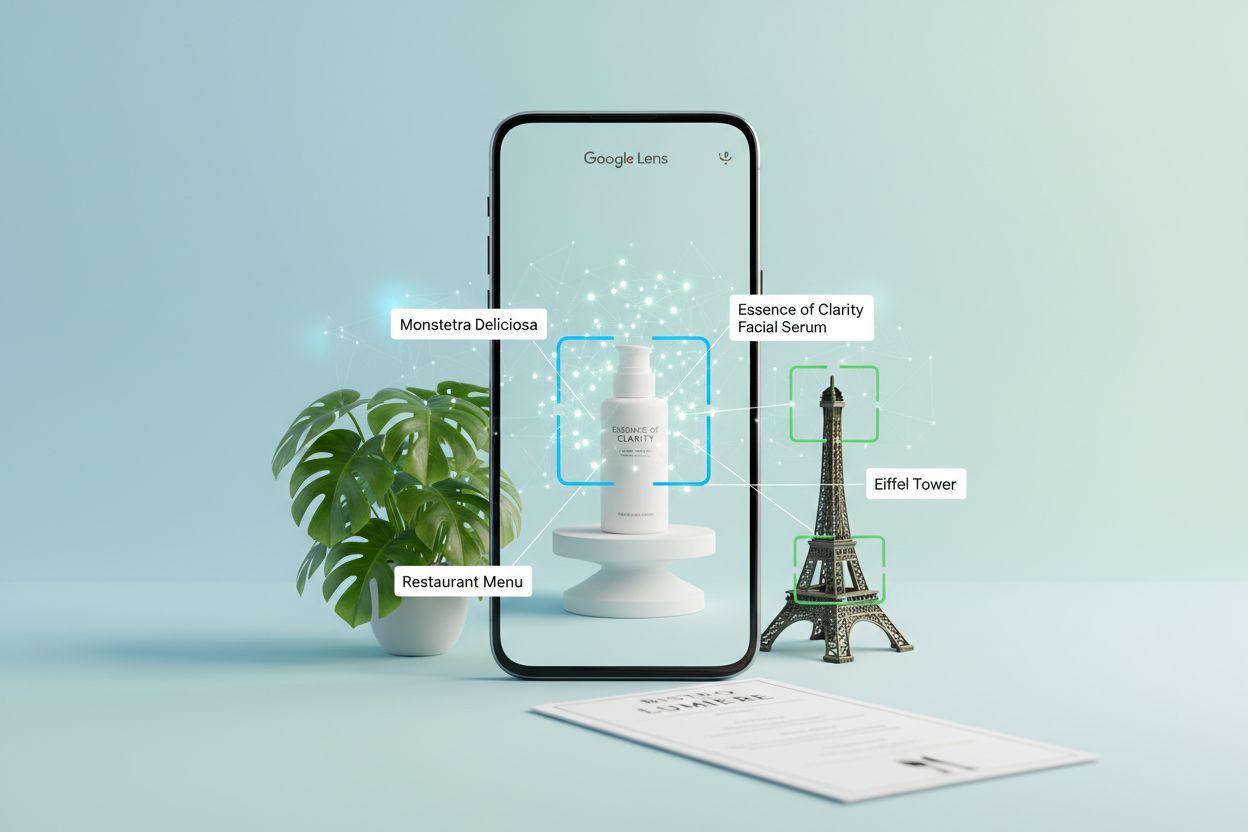

In de kern vertrouwt Google Lens op drie onderling verbonden AI-technologieën om visuele zoekopdrachten te begrijpen en te beantwoorden. Convolutionele Neurale Netwerken (CNN’s) vormen de basis; zij analyseren pixelpatronen om objecten, scènes en visuele relaties met opmerkelijke nauwkeurigheid te herkennen. Deze deep learning-modellen zijn getraind op miljarden gelabelde afbeeldingen, waardoor ze alles kunnen herkennen van gewone huishoudelijke voorwerpen tot zeldzame plantensoorten.

Optische Tekenherkenning (OCR) verwerkt tekstdetectie en -uittreksel, waardoor Lens menu’s, borden, documenten en handgeschreven notities kan lezen. Wanneer je je camera richt op een menukaart in een vreemde taal of op een straatnaambord, zet OCR de visuele tekst om in digitale data die verwerkt en vertaald kan worden. Natuurlijke taalverwerking (NLP) interpreteert deze tekst vervolgens contextueel; het begrijpt niet alleen welke woorden aanwezig zijn, maar ook wat ze betekenen in relatie tot je zoekopdracht.

De echte kracht zit in multimodale AI—het vermogen om meerdere soorten input tegelijk te verwerken. Je kunt nu je camera op een product richten, er een gesproken vraag over stellen en een AI-gestuurd antwoord ontvangen dat visueel begrip combineert met conversatiecontext. Deze integratie zorgt voor een zoekervaring die natuurlijk en intuïtief aanvoelt.

| Functie | Traditionele Tekstzoekopdracht | Google Lens |

|---|---|---|

| Invoermethode | Getypte zoekwoorden | Afbeelding, video of spraak |

| Herkenningsvermogen | Alleen zoekwoorden | Objecten, tekst, context, relaties |

| Reactiesnelheid | Seconden | Direct |

| Contextbegrip | Beperkt tot zoektekst | Volledig visuele context |

| Realtime mogelijkheid | Nee | Ja, met live camera |

| Nauwkeurigheid voor visuele items | Laag (moeilijk te beschrijven) | Hoog (direct visueel matchen) |

De praktische toepassingen van Google Lens gaan veel verder dan simpelweg nieuwsgierigheid bevredigen. Bij winkelen fotograferen gebruikers producten die ze zien in winkels, op sociale media of in video’s, waarna ze direct kunnen vinden waar ze het kunnen kopen en prijzen vergelijken bij verschillende retailers. Een klant ziet bijvoorbeeld een meubelstuk bij een vriend thuis, maakt er een foto van en ontdekt het exacte product dat direct te koop is—zonder het moment te verlaten.

Onderwijs is een andere krachtige toepassing, vooral in ontwikkelingslanden. Studenten fotograferen tekstboekopgaven of lesmateriaal in het Engels en gebruiken Lens om ze naar hun moedertaal te vertalen, waarna ze huiswerkhulp en uitleg krijgen. Dit democratiseert de toegang tot educatieve bronnen over taalbarrières heen.

Reizen en ontdekken maken gebruik van Lens om bezienswaardigheden te identificeren, restaurants te vinden en culturele kennis op te doen. Toeristen fotograferen onbekende architectuur of borden en krijgen direct historische context en informatie. Natuurliefhebbers identificeren planten, dieren en insecten tijdens buitenactiviteiten, waardoor spontane waarnemingen leermomenten worden.

Productonderzoek en vergelijking is naadloos geworden. Iemand ziet een handtas die ze mooi vindt, fotografeert deze, en Lens toont niet alleen het exacte product, maar ook vergelijkbare items in verschillende prijsklassen bij winkels in de buurt. Deze mogelijkheid heeft het aankoopproces fundamenteel veranderd door de drempel tussen ontdekking en aankoop weg te nemen.

De kans is enorm: 20 miljard visuele zoekopdrachten met koopintentie per jaar vormen een gigantisch kanaal dat de meeste merken volledig negeren. Terwijl concurrenten zich richten op AI-overzicht-posities—een drukbezet speelveld gedomineerd door grote uitgevers en gevestigde retailers—blijft visuele zoekopdracht relatief onontgonnen terrein waar nu first-mover voordelen te behalen zijn.

Merken die optimaliseren voor visuele ontdekking verkrijgen een concurrentievoordeel dat traditionele SEO overstijgt. Wanneer je product verschijnt in de resultaten van Google Lens, concurreer je niet op zoekwoorden of contentkwaliteit, maar op visuele relevantie en context. Een meubelwinkel waarvan producten verschijnen in Lens-zoekopdrachten als “nachtkastje queen slaapkamer” bereikt klanten op het exacte moment dat ze klaar zijn om te kopen, nog voordat ze een zoekmachine bezoeken.

De conversie-implicaties zijn groot. Gebruikers van visuele zoekopdrachten weten al wat ze willen—ze zijn niet aan het oriënteren of onderzoeken, ze willen kopen. Dit verkeer met sterke koopintentie converteert veel beter dan traditioneel zoekverkeer. Daarnaast vermindert visuele zoekopdracht frictie voorafgaand aan aankoop: klanten zien precies hoe een product eruitziet in context, begrijpen de schaal ten opzichte van bekende objecten en nemen met vertrouwen aankoopbeslissingen.

Het concurrentietijdvoordeel is reëel. De meeste bureaus en merken beseffen nog niet dat visuele zoekopdracht een apart kanaal is. De bedrijven die nu beginnen met optimalisatie voor visuele zoekopdracht, bouwen voorsprong en marktaandeel op terwijl concurrenten vasthouden aan ouderwetse zoekmethoden.

Optimaliseren voor visuele ontdekking vereist een fundamenteel andere aanpak dan traditionele afbeelding-SEO. Dit zijn de essentiële strategieën:

Al deze elementen dragen bij aan hoe Google Lens je visuele content begrijpt en rangschikt. Hoe meer context je biedt, hoe groter de kans dat je producten verschijnen in relevante visuele zoekopdrachten.

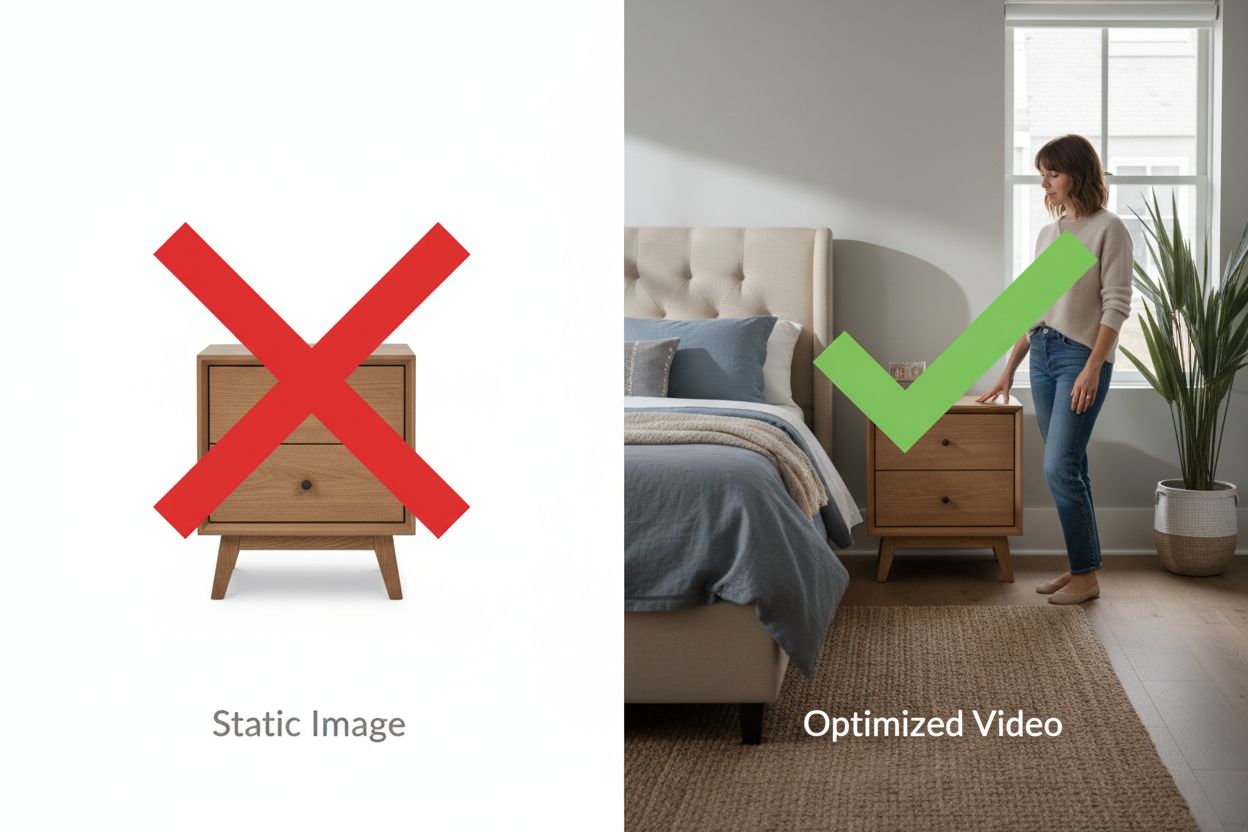

Statische afbeeldingen zijn het minimale vereiste voor visuele zoekoptimalisatie; video is je concurrentievoordeel. Google Lens haalt informatie uit videoframes, wat betekent dat een productdemonstratie van 30 seconden tientallen vindbare momenten kan opleveren die statische fotografie niet kan bieden.

Video toont schaal op manieren die foto’s niet kunnen. Wanneer je een nachtkastje laat zien naast een queen-size bed met een persoon erbij, kan Lens de exacte afmetingen afleiden via ruimtelijke relaties. Wanneer je een product in gebruik demonstreert—een waterdichte tas die een regenbui doorstaat, een zit-sta-bureau met dubbele monitoren, een tent die zware regen trotseert—bied je bewijs dat verder gaat dan claims.

Het conversie-effect is aantoonbaar. Webshops die productvideo’s toevoegen, zien een toename in conversieratio van 20-40% omdat klanten zich een beter beeld kunnen vormen van het product in hun eigen omgeving. Dezezelfde video’s worden vindbaar in Google Lens-zoekopdrachten en trekken verkeer aan uit een geheel nieuw kanaal.

De technische vereisten zijn eenvoudig: video’s van 15-45 seconden waarin producten vanuit meerdere hoeken en met duidelijke schaalcontext worden getoond, direct geüpload op je website (niet als YouTube-embed voor productpagina’s), met beschrijvende bestandsnamen en schema-markering. Je hebt geen Hollywoodproductiekwaliteit nodig; authentieke smartphonebeelden met echte context presteren vaak beter dan steriele studiovideo’s, omdat de context waardevoller is dan de productiewaarde.

Optimalisatie voor visuele zoekopdracht vereist een strategische aanpak. Begin met het beoordelen van je huidige visuele middelen in het gedeelte Afbeeldingen van Google Search Console—de meeste merken ontdekken dat ze duizenden vertoningen krijgen maar weinig klikken, wat wijst op een enorme optimalisatiemogelijkheid.

Identificeer je top 50 producten op basis van verkeer en omzet en bekijk hun huidige visuele content. Welke producten hebben meerdere hoeken? Welke hebben video’s? Welke missen lifestylefotografie? Deze audit laat zien waar je optimalisatie-inspanningen het meeste rendement opleveren. Maak een content-roadmap waarbij je prioriteit geeft aan producten met het hoogste zoekvolume en commerciële intentie.

Het implementatietraject duurt 60-90 dagen. In week 1-2 ligt de focus op planning en prioritering. In week 3-4 creëer je content—productvideo’s maken, lifestylefotografie schieten en demonstratiecontent ontwikkelen. In week 5-6 volgt de technische optimalisatie: bestanden hernoemen, alt-teksten schrijven, schema-markering implementeren en content uploaden. In week 7-8 monitor en optimaliseer je, waarbij je kijkt welke producten en contenttypes het meeste visueel zoekverkeer genereren.

Monitor het prestatieoverzicht in Google Search Console, gefilterd op zoektype “Afbeeldingen”, om de voortgang te volgen. Reken op 30-60 dagen voordat er wezenlijke verkeersstijgingen zichtbaar worden, aangezien Google tijd nodig heeft om je nieuwe visuele content opnieuw te crawlen en te indexeren. Meet conversies uit afbeeldingszoekverkeer specifiek met UTM-parameters of kanaalgroepering in Google Analytics om het rendement inzichtelijk te maken.

Het toekomstpad van Google voor visuele zoekopdrachten ontwikkelt zich in spannende richtingen. Search Live, dat in 2025 wordt uitgerold, maakt realtime conversaties met Search mogelijk—je kunt je camera richten op een schilderij en vragen “Welke stijl is dit?” en vervolgens “Welke beroemde kunstenaars zijn er in die stijl?” voor een naadloze, conversatiegerichte visuele zoekervaring.

Multimodale AI-mogelijkheden blijven zich ontwikkelen, waardoor Lens steeds complexere visuele zoekopdrachten kan begrijpen. In plaats van alleen objecten te herkennen, begrijpt Lens nu relaties, contexten en genuanceerde vragen over wat je ziet. Uitbreiding van Circle to Search brengt gebaren-gebaseerde visuele zoekopdracht naar meer apparaten en platformen, waardoor visuele ontdekking nog toegankelijker wordt.

Integratie binnen het Google-ecosysteem vergroot de mogelijkheden. Google Lens is nu ingebouwd in Chrome desktop, wat betekent dat visuele zoekopdracht beschikbaar is waar en wanneer inspiratie toeslaat. Naarmate deze mogelijkheden wereldwijd en op meer platformen uitbreiden, wordt het concurrentievoordeel van vroege optimalisatie alleen maar groter.

De merken die nu voorbereiden—hun visuele content optimaliseren, demonstratievideo’s maken en correcte schema-markering implementeren—zullen domineren in visuele zoekresultaten naarmate het kanaal explosief groeit. De vraag is niet óf visuele zoekopdracht belangrijk wordt voor je bedrijf; het is of jij zichtbaar bent wanneer klanten visueel zoeken naar wat jij verkoopt.

Google Lens is de visuele zoektechnologie van Google die AI gebruikt om objecten, tekst en scènes te herkennen op basis van afbeeldingen of video. Het maakt gebruik van convolutionele neurale netwerken (CNN's) voor objectherkenning, optische tekenherkenning (OCR) voor tekstdetectie en natuurlijke taalverwerking (NLP) om context te begrijpen. Gebruikers kunnen hun camera op iets richten en er vragen over stellen, waarna ze direct AI-gestuurde antwoorden en gerelateerde informatie ontvangen.

Traditionele afbeeldingzoekopdrachten vertrouwen op zoekwoorden en metadata om visueel vergelijkbare afbeeldingen te vinden. Google Lens begrijpt de daadwerkelijke inhoud van afbeeldingen—objecten, relaties, context en betekenis—waardoor het producten en informatie kan matchen op basis van visuele gelijkenis in plaats van tekstbeschrijvingen. Dit maakt het veel effectiever voor het vinden van items die moeilijk in woorden te beschrijven zijn, zoals meubels, mode of bezienswaardigheden.

Google Lens verwerkt jaarlijks meer dan 100 miljard visuele zoekopdrachten, waarvan 20 miljard een directe koopintentie hebben. Gebruikers die visueel zoeken zijn actief op zoek om iets te kopen dat ze hebben gezien, waardoor dit verkeer zeer waardevol is. Optimaliseren voor visuele ontdekking bereikt klanten op het moment van intentie, nog voordat ze een zoekopdracht typen, wat leidt tot hogere conversieratio's dan traditioneel zoekverkeer.

Google Lens vereist het openen van de app en het maken van een foto of het uploaden van een afbeelding. Circle to Search is een gebarenfunctie op Android-apparaten waarmee je objecten direct op je scherm kunt omcirkelen, aantikken of markeren zonder van app te wisselen. Beide gebruiken dezelfde onderliggende visuele zoektechnologie, maar Circle to Search biedt een snellere, naadlozere ervaring voor gebruikers die al content op hun telefoon bekijken.

Optimaliseer voor Google Lens door meerdere producthoeken te tonen, referenties met bekende afmetingen (bedden, deuren, mensen) toe te voegen voor schaalcontext, beschrijvende alt-teksten te schrijven, Product- en Video-schema markering te implementeren, lifestylefotografie te maken die het product in de praktijk toont, seizoensproducten online te houden met uitverkocht-indicatoren, en beschrijvende bestandsnamen te gebruiken. Elk element helpt Google Lens jouw visuele content beter te begrijpen.

Video is een gamechanger voor visuele zoekopdrachten omdat Google Lens informatie haalt uit videoframes, waarmee uit één video meerdere vindbare momenten ontstaan. Video's tonen schaal, functionaliteit en gebruik in de praktijk op manieren waarop statische afbeeldingen dat niet kunnen. Producten met demonstratievideo's zien 20-40% hogere conversieratio's en verschijnen vaker in visuele zoekresultaten, waardoor video essentieel is voor concurrentievoordeel.

Reken op 30-60 dagen voordat er aanzienlijke verkeersstijgingen zichtbaar zijn in het gedeelte Afbeeldingen van Google Search Console. Google heeft tijd nodig om je nieuwe visuele content opnieuw te crawlen en te indexeren. Echter, binnen 30 dagen zou je al meer vertoningen moeten zien, wat aangeeft dat Google je geoptimaliseerde content vindt en indexeert. Conversieverbeteringen volgen doorgaans binnen 60-90 dagen naarmate het verkeer toeneemt.

Ja, je kunt visueel zoekverkeer meten in Google Analytics door te filteren op 'Afbeeldingen' als zoektype in het prestatieoverzicht van Google Search Console. Voor meer gedetailleerde conversiemeting kun je UTM-parameters gebruiken op productpagina's of een aangepaste kanaalgroepering maken voor afbeeldingzoekverkeer. Monitor statistieken zoals doorklikratio, conversieratio en gemiddelde bestelwaarde specifiek voor afbeeldingzoekverkeer om het rendement van je optimalisatie-inspanningen te meten.

AmICited volgt hoe Google Lens, Circle to Search en andere AI-tools je merk vermelden in visuele ontdekkingsresultaten. Krijg inzichten in je AI-zichtbaarheid en optimaliseer je visuele contentstrategie.

Ontdek hoe visuele zoekopdrachten en AI de manier waarop afbeeldingen worden gevonden transformeren. Optimaliseer je afbeeldingen voor Google Lens, AI Overviews...

Ontdek hoe AI-zoekopdrachten SEO transformeren. Leer de belangrijkste verschillen tussen AI-platformen zoals ChatGPT en traditioneel Google zoeken, en hoe je je...

Ontdek hoe AI-zoekplatforms zoals ChatGPT en Perplexity het zoeklandschap hervormen. Ontdek wanneer AI het conversievolume van Google kan evenaren en wat dit be...

Cookie Toestemming

We gebruiken cookies om uw browse-ervaring te verbeteren en ons verkeer te analyseren. See our privacy policy.