Como Construir Autoridade de Domínio para Motores de Busca por IA

Aprenda a construir autoridade de domínio reconhecida por motores de busca por IA. Descubra estratégias para otimização de entidades, citações, autoridade tópic...

Avaliação por IA da confiabilidade de conteúdos com base nas credenciais do autor, citações e verificação. A avaliação de credibilidade da fonte analisa sistematicamente múltiplas dimensões, incluindo a experiência do autor, reputação do publicador, padrões de citação e resultados de checagem de fatos, para determinar se as fontes de informação merecem inclusão em pesquisas, bases de conhecimento ou resumos gerados por IA. Esse processo automatizado permite que plataformas ampliem a avaliação de credibilidade para milhões de fontes, mantendo a consistência que revisores humanos sozinhos não conseguiriam alcançar.

Avaliação por IA da confiabilidade de conteúdos com base nas credenciais do autor, citações e verificação. A avaliação de credibilidade da fonte analisa sistematicamente múltiplas dimensões, incluindo a experiência do autor, reputação do publicador, padrões de citação e resultados de checagem de fatos, para determinar se as fontes de informação merecem inclusão em pesquisas, bases de conhecimento ou resumos gerados por IA. Esse processo automatizado permite que plataformas ampliem a avaliação de credibilidade para milhões de fontes, mantendo a consistência que revisores humanos sozinhos não conseguiriam alcançar.

Avaliação de credibilidade da fonte é a análise sistemática de fontes de informação para determinar sua confiabilidade, fidedignidade e autoridade no fornecimento de informações precisas. No contexto de sistemas baseados em IA, a avaliação de credibilidade envolve a análise de múltiplas dimensões de uma fonte para estabelecer se seu conteúdo merece ser incluído em pesquisas, citações ou bases de conhecimento. A avaliação de credibilidade por IA opera examinando credenciais do autor—incluindo formação educacional, experiência profissional e expertise no tema—junto aos padrões de citação que indicam com que frequência e de forma positiva outras fontes autoritativas fazem referência ao trabalho. O processo avalia mecanismos de verificação como status de revisão por pares, afiliação institucional e reputação do veículo de publicação para estabelecer uma linha de base de confiança. Sinais de credibilidade são indicadores mensuráveis que sistemas de IA detectam e ponderam, indo de marcadores explícitos como qualificações do autor até sinais implícitos derivados de análise textual e padrões de metadados. Sistemas modernos de IA reconhecem que a credibilidade é multidimensional; uma fonte pode ser altamente confiável em um domínio e carecer de autoridade em outro, exigindo avaliação sensível ao contexto. O processo de avaliação tornou-se cada vez mais crítico à medida que o volume de informação explode e a desinformação se espalha rapidamente nas plataformas digitais. A avaliação automatizada de credibilidade permite que plataformas escalem a avaliação para milhões de fontes, mantendo uma consistência que revisores humanos sozinhos não podem alcançar. Entender como esses sistemas funcionam ajuda criadores de conteúdo, pesquisadores e publicadores a otimizar suas fontes para reconhecimento de credibilidade, além de ajudar consumidores a tomar decisões informadas sobre a confiabilidade das informações.

Sistemas de IA avaliam a credibilidade de fontes por meio de uma sofisticada análise de múltiplos sinais que combina processamento de linguagem natural, modelos de aprendizado de máquina e avaliação de dados estruturados. A detecção de sinais de credibilidade identifica marcadores específicos no texto, metadados e padrões de rede que se correlacionam com informações confiáveis; esses sinais são ponderados conforme seu valor preditivo para precisão. A análise de PLN examina padrões linguísticos, densidade de citações, especificidade de afirmações e grau de certeza da linguagem para avaliar se o conteúdo demonstra rigor de pesquisa ou exibe características comuns a fontes não confiáveis. Modelos de aprendizado de máquina treinados com grandes bases de dados de fontes verificadas como credíveis e não credíveis aprendem a reconhecer padrões complexos que humanos podem não perceber, permitindo avaliação em tempo real em larga escala. A integração com checagem de fatos cruza afirmações com bancos de dados verificados e fatos estabelecidos, sinalizando contradições ou alegações sem suporte que reduzem a pontuação de credibilidade. Esses sistemas empregam métodos de ensemble que combinam múltiplas abordagens de avaliação, reconhecendo que nenhum sinal isolado prevê perfeitamente a credibilidade. A tabela a seguir ilustra as principais categorias de sinais que sistemas de IA analisam:

| Tipo de Sinal | O que Mede | Exemplos |

|---|---|---|

| Sinais Acadêmicos | Status de revisão por pares, veículo de publicação, afiliação | Fator de impacto de periódico, ranking de conferência, reputação universitária |

| Sinais Textuais | Qualidade da escrita, densidade de citações, especificidade, padrões de linguagem | Citações adequadas, terminologia técnica, afirmações baseadas em evidências |

| Sinais de Metadados | Credenciais do autor, data de publicação, frequência de atualização, histórico da fonte | Diplomas do autor, cronologia de publicação, histórico de revisões |

| Sinais Sociais | Contagem de citações, padrões de compartilhamento, endossos de especialistas, engajamento da comunidade | Citações no Google Scholar, menções em redes acadêmicas, recomendações de pares |

| Sinais de Verificação | Resultados de checagem de fatos, corroboração de afirmações, transparência da fonte | Verificação no Snopes, confirmações independentes, divulgação de metodologia |

| Sinais Estruturais | Organização do conteúdo, clareza metodológica, divulgação de conflitos de interesse | Seções claras, métodos transparentes, transparência sobre fontes de financiamento |

Os fatores de credibilidade mais influentes que sistemas de IA avaliam incluem múltiplas dimensões interconectadas que, em conjunto, estabelecem a confiabilidade da fonte. Reputação do autor serve como marcador fundamental, com especialistas reconhecidos em sua área tendo muito mais peso do que colaboradores desconhecidos. Reputação do publicador amplia a avaliação para o contexto institucional, reconhecendo que fontes publicadas em periódicos revisados por pares ou editoras acadêmicas estabelecidas demonstram credibilidade superior. Padrões de citação revelam como a comunidade acadêmica mais ampla interagiu com a fonte; trabalhos muito citados em veículos respeitados indicam validação da qualidade da pesquisa pela comunidade. Atualidade importa de forma contextual—publicações recentes demonstram conhecimento atual, enquanto obras fundamentais mais antigas mantêm credibilidade pelo impacto histórico e relevância contínua. Algoritmos de detecção de viés examinam se as fontes divulgam potenciais conflitos de interesse, fontes de financiamento ou posições ideológicas que possam influenciar suas conclusões. Sinais de engajamento da comunidade acadêmica e profissional, incluindo citações e discussões entre pares, fornecem validação externa de credibilidade. Os fatores a seguir representam os elementos mais críticos que sistemas de IA priorizam:

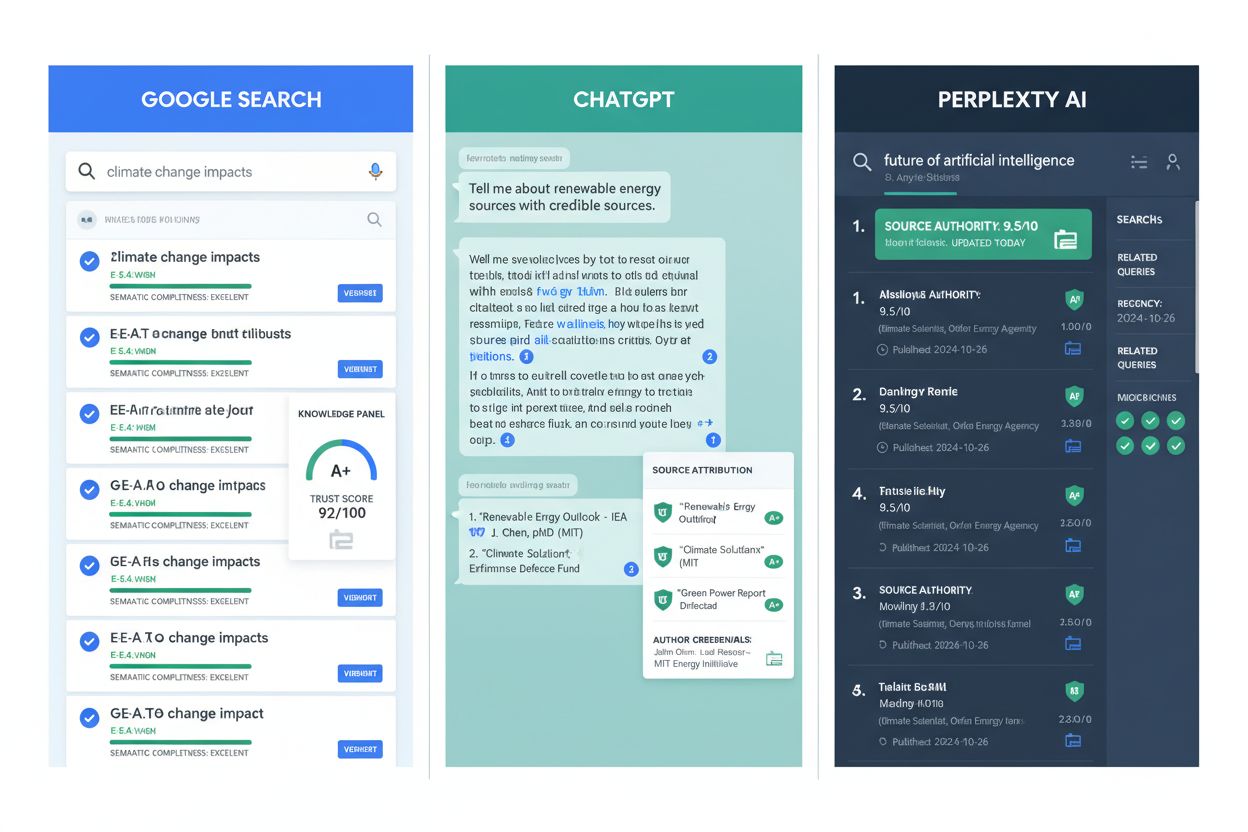

A avaliação de credibilidade por IA tornou-se parte fundamental de grandes plataformas de informação e da infraestrutura de pesquisa. Google AI Overviews utiliza sinais de credibilidade para determinar quais fontes aparecem em resumos gerados por IA, priorizando conteúdos de publicadores estabelecidos e especialistas verificados. ChatGPT e modelos de linguagem semelhantes aplicam avaliação de credibilidade durante o treinamento para ponderar as fontes adequadamente, embora enfrentem desafios para avaliar em tempo real afirmações novas. Perplexity AI incorpora explicitamente a credibilidade da fonte em sua metodologia de citação, exibindo a reputação da fonte junto aos resultados para ajudar o usuário a avaliar a qualidade da informação. Na pesquisa acadêmica, ferramentas de avaliação de credibilidade ajudam pesquisadores a identificar fontes de alta qualidade com mais eficiência, reduzindo o tempo de revisão de literatura e melhorando a base da pesquisa. Iniciativas de preservação de conteúdo usam avaliação de credibilidade para priorizar o arquivamento de fontes autoritativas, garantindo que pesquisadores futuros possam acessar informações históricas confiáveis. O AmICited.com atua como solução de monitoramento que rastreia como fontes são citadas e avaliadas em diferentes plataformas, ajudando publicadores a entender seu status de credibilidade e identificar oportunidades de melhoria. Organizações de checagem de fatos utilizam avaliação automatizada de credibilidade para priorizar reivindicações para verificação manual, focando o esforço humano em desinformação de alto impacto. Instituições de ensino utilizam cada vez mais ferramentas de avaliação de credibilidade para ensinar estudantes sobre avaliação de fontes, tornando explícitos e mensuráveis os critérios que antes eram implícitos. Essas aplicações demonstram que a avaliação de credibilidade passou de um arcabouço teórico para uma infraestrutura prática de suporte à qualidade da informação nos ecossistemas digitais.

Apesar dos avanços significativos, a avaliação automatizada de credibilidade enfrenta limitações substanciais que exigem supervisão humana e julgamento contextual. O viés dos sinais de engajamento apresenta um desafio fundamental: fontes populares podem receber pontuações altas com base em sinais sociais, mesmo contendo informações imprecisas, já que métricas de engajamento nem sempre se correlacionam com precisão. Falsos positivos e negativos ocorrem quando algoritmos de credibilidade classificam incorretamente fontes—especialistas estabelecidos em áreas emergentes podem não ter histórico de citações suficiente, enquanto criadores prolíficos de desinformação desenvolvem sinais sofisticados que enganam sistemas automatizados. Táticas evolutivas de desinformação exploram deliberadamente sistemas de avaliação imitando fontes legítimas, criando credenciais falsas e fabricando citações para enganar sistemas automatizados. Variação de credibilidade por domínio significa que uma fonte pode ser confiável em um campo e carecer de autoridade em outro, mas sistemas às vezes aplicam pontuações uniformes em diferentes áreas. Dinâmica temporal complica a avaliação: fontes confiáveis no momento de publicação podem ficar desatualizadas ou desacreditadas com surgimento de novas evidências, exigindo reavaliação contínua em vez de pontuação estática. Viés cultural e linguístico nos dados de treinamento pode fazer com que sistemas de avaliação de credibilidade subvalorizem fontes de regiões não anglófonas ou comunidades sub-representadas, perpetuando hierarquias informacionais. Desafios de transparência surgem porque muitos algoritmos de avaliação funcionam como caixas-pretas, dificultando para fontes entenderem como melhorar seus sinais de credibilidade ou para usuários compreenderem por que certas fontes receberam determinadas pontuações. Essas limitações reforçam que a avaliação automatizada de credibilidade deve complementar, e não substituir, a avaliação crítica humana.

Criadores de conteúdo e publicadores podem melhorar significativamente seus sinais de credibilidade ao implementar práticas baseadas em evidências que estejam alinhadas com a forma como sistemas de IA avaliam a confiabilidade. Implemente os princípios E-E-A-T—demonstrando Experiência, Especialização, Autoridade e Confiabilidade—exibindo claramente as credenciais dos autores, afiliações profissionais e qualificações relevantes nas páginas de conteúdo. Boas práticas de citação fortalecem a credibilidade ao vincular a fontes de alta qualidade, utilizar formatos consistentes de citação e garantir que todas as afirmações estejam referenciadas com evidências verificáveis; isso sinaliza que o conteúdo está fundamentado em conhecimento estabelecido, e não em especulação. Transparência metodológica ajuda sistemas de IA a reconhecer práticas rigorosas de pesquisa; explique claramente fontes de dados, métodos de pesquisa, limitações e potenciais conflitos de interesse. Mantenha perfis de autores com informações biográficas detalhadas, histórico de publicações e credenciais profissionais que sistemas de IA possam verificar e avaliar. Atualize conteúdos regularmente para demonstrar compromisso com a precisão; informações desatualizadas reduzem pontuações de credibilidade, enquanto revisões frequentes sinalizam monitoramento de novos avanços no campo. Divulgue explicitamente fontes de financiamento e afiliações, já que a transparência sobre potenciais vieses aumenta a credibilidade—sistemas de IA reconhecem que conflitos divulgados são menos problemáticos do que ocultos. Construa autoridade de citação publicando em veículos respeitados, buscando revisão por pares e conquistando citações de outras fontes credíveis; isso cria ciclos positivos onde credibilidade gera mais credibilidade. Engaje-se com a comunidade profissional por meio de conferências, colaborações e discussões entre pares, pois esses sinais de engajamento validam expertise e aumentam a visibilidade diante de sistemas de avaliação de credibilidade. Implemente marcação de dados estruturados usando schema.org e padrões semelhantes para ajudar sistemas de IA a extrair e verificar automaticamente informações de autores, datas de publicação e outros sinais de credibilidade.

A evolução da avaliação de credibilidade da fonte irá incorporar cada vez mais a avaliação multimodal que analisa texto, imagens, vídeo e áudio conjuntamente para detectar desinformação sofisticada que explora análises de modalidade única. Sistemas de verificação em tempo real serão integrados a plataformas de criação de conteúdo, fornecendo feedback imediato de credibilidade à medida que os criadores publicam, permitindo correção antes que a desinformação se espalhe. Rastreamento de credibilidade baseado em blockchain pode possibilitar registros imutáveis do histórico da fonte, citações e correções, criando uma proveniência transparente de credibilidade que sistemas de IA podem avaliar com mais confiança. Avaliação personalizada de credibilidade irá além da pontuação única para todos, avaliando fontes conforme a experiência e necessidades individuais do usuário, reconhecendo que credibilidade é parcialmente subjetiva e dependente do contexto. Integração com grafos de conhecimento permitirá que sistemas de IA avaliem fontes não só isoladamente, mas dentro de redes de informações relacionadas, identificando fontes que contradizem o conhecimento estabelecido ou preenchem lacunas importantes. Sistemas de IA explicáveis para credibilidade tornar-se-ão padrão, fornecendo explicações transparentes de por que fontes receberam determinadas pontuações, permitindo que criadores melhorem e usuários compreendam o raciocínio das avaliações. Sistemas de aprendizado contínuo adaptar-se-ão em tempo real a novas táticas de desinformação, atualizando modelos de avaliação de credibilidade à medida que novas técnicas de manipulação surgem, em vez de depender apenas de dados de treinamento estáticos. Rastreamento de credibilidade entre plataformas criará perfis unificados de credibilidade que acompanham as fontes pela internet, dificultando que agentes mal-intencionados mantenham diferentes reputações em diferentes plataformas. Esses avanços tornarão a avaliação de credibilidade cada vez mais sofisticada, transparente e integrada à infraestrutura informacional da qual bilhões de pessoas dependem diariamente.

A avaliação de credibilidade da fonte é a análise sistemática de fontes de informação para determinar sua confiabilidade e fidedignidade. Sistemas de IA analisam múltiplas dimensões, incluindo credenciais do autor, reputação do publicador, padrões de citação e resultados de checagem de fatos, para estabelecer se as fontes merecem inclusão em pesquisas, bases de conhecimento ou resumos gerados por IA. Esse processo automatizado permite que plataformas avaliem milhões de fontes de forma consistente.

Sistemas de IA detectam sinais de credibilidade por meio de processamento de linguagem natural, modelos de aprendizado de máquina e análise de dados estruturados. Eles examinam sinais acadêmicos (status de revisão por pares, afiliação institucional), sinais textuais (densidade de citações, especificidade de afirmações), sinais de metadados (credenciais do autor, datas de publicação), sinais sociais (contagem de citações, endossos de especialistas) e sinais de verificação (resultados de checagem de fatos, corroboração de afirmações). Esses sinais são ponderados conforme seu valor preditivo para precisão.

Os fatores de credibilidade mais críticos incluem reputação e experiência do autor, reputação do publicador, quantidade e qualidade das citações, atualidade e temporalidade, divulgação de vieses e conflitos, sinais de engajamento da comunidade profissional, verificação da fonte por checagem de fatos, integração ao conhecimento de base, associação do criador a instituições respeitadas e frequência de atualização. Esses fatores, em conjunto, estabelecem a confiabilidade e credibilidade da fonte.

Publicadores podem melhorar a credibilidade implementando os princípios E-E-A-T (Experiência, Especialização, Autoridade, Confiabilidade), utilizando boas práticas de citação, mantendo metodologia transparente, exibindo perfis detalhados de autores com credenciais, atualizando conteúdos regularmente, divulgando fontes de financiamento e afiliações, desenvolvendo autoridade de citação através de revisão por pares, engajando a comunidade profissional e implementando marcação de dados estruturados para ajudar sistemas de IA a extrair informações de credibilidade.

A avaliação automatizada de credibilidade enfrenta desafios como viés de sinais de engajamento (fontes populares podem receber pontuações altas mesmo sendo imprecisas), falsos positivos e negativos, táticas de desinformação que imitam fontes legítimas, variação de credibilidade por domínio, dinâmica temporal conforme fontes ficam desatualizadas, viés cultural e linguístico nos dados de treinamento e desafios de transparência com algoritmos caixa-preta. Essas limitações indicam que a avaliação automatizada deve complementar, e não substituir, a avaliação crítica humana.

O Google AI Overviews prioriza fontes de publicadores estabelecidos e especialistas verificados para resumos gerados por IA. O ChatGPT pondera fontes durante o treinamento com base em sinais de credibilidade. O Perplexity exibe explicitamente a reputação da fonte junto aos resultados de busca. O AmICited.com monitora como fontes são citadas em todas as principais plataformas de IA, ajudando publicadores a entender seu status de credibilidade e identificar oportunidades de melhoria.

Os desenvolvimentos futuros incluem avaliação multimodal analisando texto, imagens, vídeo e áudio em conjunto; sistemas de verificação em tempo real fornecendo feedback imediato de credibilidade; rastreamento de credibilidade baseado em blockchain; avaliação personalizada de credibilidade conforme a experiência do usuário; integração com grafos de conhecimento; sistemas de IA explicáveis fornecendo justificativas transparentes para pontuação; sistemas de aprendizado contínuo adaptando-se a novas táticas de desinformação; e rastreamento de credibilidade entre plataformas criando perfis unificados.

A avaliação de credibilidade da fonte é fundamental pois determina quais fontes aparecem em resumos gerados por IA, influenciam os dados de treinamento de IA e moldam as informações que bilhões de pessoas acessam. Avaliações precisas ajudam a evitar a disseminação de desinformação, garantem que sistemas de IA forneçam informações confiáveis, sustentam a qualidade da pesquisa acadêmica e mantêm a confiança em sistemas de informação baseados em IA. À medida que a IA se torna mais influente na descoberta de informações, a avaliação de credibilidade torna-se cada vez mais importante.

Acompanhe como suas fontes são citadas e avaliadas no Google AI Overviews, ChatGPT, Perplexity e Gemini. O AmICited.com ajuda você a entender seu status de credibilidade e identificar oportunidades de melhoria.

Aprenda a construir autoridade de domínio reconhecida por motores de busca por IA. Descubra estratégias para otimização de entidades, citações, autoridade tópic...

Descubra quais fontes os motores de IA mais citam. Saiba como ChatGPT, Google AI Overviews e Perplexity avaliam a credibilidade das fontes e entenda padrões de ...

Descubra como motores de IA como ChatGPT, Perplexity e Google IA avaliam a confiabilidade das fontes. Saiba sobre E-E-A-T, autoridade de domínio, frequência de ...

Consentimento de Cookies

Usamos cookies para melhorar sua experiência de navegação e analisar nosso tráfego. See our privacy policy.