ClaudeBot 详解:Anthropic 的爬虫及其与您内容的关系

了解 ClaudeBot 的工作原理、它与 Claude-Web 和 Claude-SearchBot 的区别,以及如何通过 robots.txt 配置管理 Anthropic 的网络爬虫在您网站上的行为。...

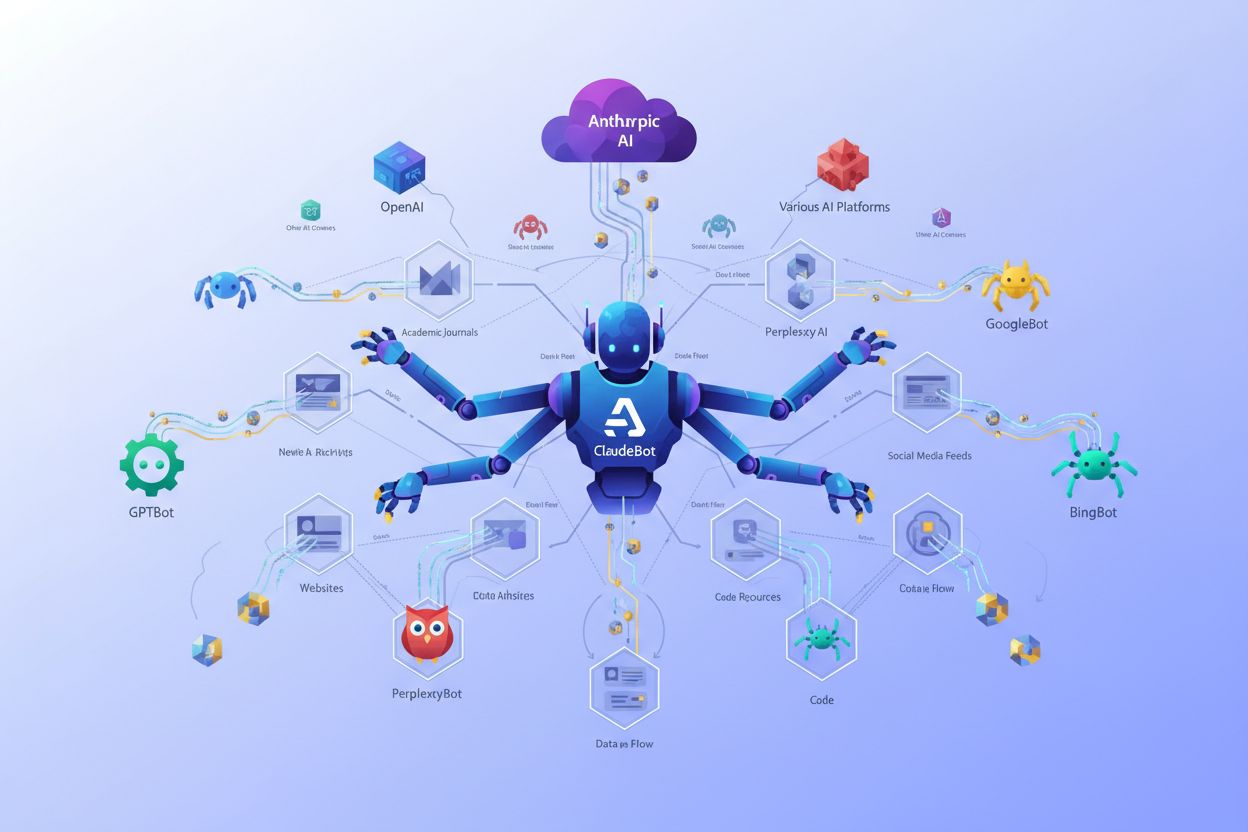

ClaudeBot 是 Anthropic 的网页爬虫,用于收集 Claude AI 模型的训练数据。它系统性地爬取公开可访问的网站,为机器学习模型的训练收集内容。网站所有者可以通过 robots.txt 配置控制 ClaudeBot 的访问权限。该爬虫遵守标准的 robots.txt 指令,允许网站选择阻止或允许其访问。

ClaudeBot 是 Anthropic 的网页爬虫,用于收集 Claude AI 模型的训练数据。它系统性地爬取公开可访问的网站,为机器学习模型的训练收集内容。网站所有者可以通过 robots.txt 配置控制 ClaudeBot 的访问权限。该爬虫遵守标准的 robots.txt 指令,允许网站选择阻止或允许其访问。

ClaudeBot 是由 Anthropic 运营的 网页爬虫,用于下载其大型语言模型(LLM)的训练数据,这些模型为 Claude 等 AI 产品提供支持。这个 AI 数据抓取工具 会系统性地爬取网站,专门为机器学习模型训练收集内容,这与传统搜索引擎爬虫为检索目的索引内容不同。ClaudeBot 可通过其用户代理字符串识别,并可通过 robots.txt 配置进行阻止或允许,让网站所有者能够控制其内容是否被用于 Anthropic AI 模型的训练。

ClaudeBot 通过系统性的网站发现方式运行,包括从已索引网站跟踪链接、处理网站地图,以及使用公开网站列表中的种子 URL。该爬虫下载网站内容,纳入用于训练 Claude 语言模型的数据集,仅收集无需身份验证的公开页面数据。与以检索为优先级的搜索引擎爬虫不同,ClaudeBot 的抓取模式通常是不透明的,Anthropic 很少披露具体的网站选择标准、抓取频率或对不同内容类型的优先级。

下表对比了 ClaudeBot 与其他 Anthropic 爬虫:

| Bot 名称 | 主要用途 | 用户代理 | 范围 |

|---|---|---|---|

| ClaudeBot | 聊天引用抓取与训练数据 | ClaudeBot/1.0 | 用于模型训练的常规网页抓取 |

| anthropic-ai | 大规模模型训练数据收集 | anthropic-ai | 大规模训练数据集整理 |

| Claude-Web | Claude 功能定向网页抓取 | Claude-Web | 网页搜索与实时信息 |

ClaudeBot 的运行方式类似于其他主流 AI 训练爬虫,如 GPTBot(OpenAI)和 PerplexityBot(Perplexity),但在范围与方法上有明显区别。GPTBot 专注于 OpenAI 的训练需求,PerplexityBot 服务于搜索与训练双重目的,而 ClaudeBot 则特定针对 Claude 的模型训练内容。根据 Dark Visitors 数据,全球排名前 1,000 的网站中约有 18% 正在主动阻止 ClaudeBot,显示出版方对其数据收集行为存在较大关注。关键区别在于各公司内容收集的优先级——Anthropic 更注重系统化、广泛的训练数据抓取,而以搜索为主的爬虫则在索引和引流之间取得平衡。

网站所有者可以通过监控服务器日志中的独特 用户代理字符串 来识别 ClaudeBot 访问:Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko; compatible; ClaudeBot/1.0; +claudebot@anthropic.com)。ClaudeBot 访问通常来自美国的 IP 段,可通过服务器日志分析或专用监控工具进行追踪。部署代理分析平台可以实时查看 ClaudeBot 的访问情况,帮助网站所有者衡量抓取频率与模式。

以下是 ClaudeBot 在服务器日志中的示例:

203.0.113.45 - - [03/Jan/2025:09:15:32 +0000] "GET /blog/article-title HTTP/1.1" 200 5432 "-" "Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko; compatible; ClaudeBot/1.0; +claudebot@anthropic.com)"

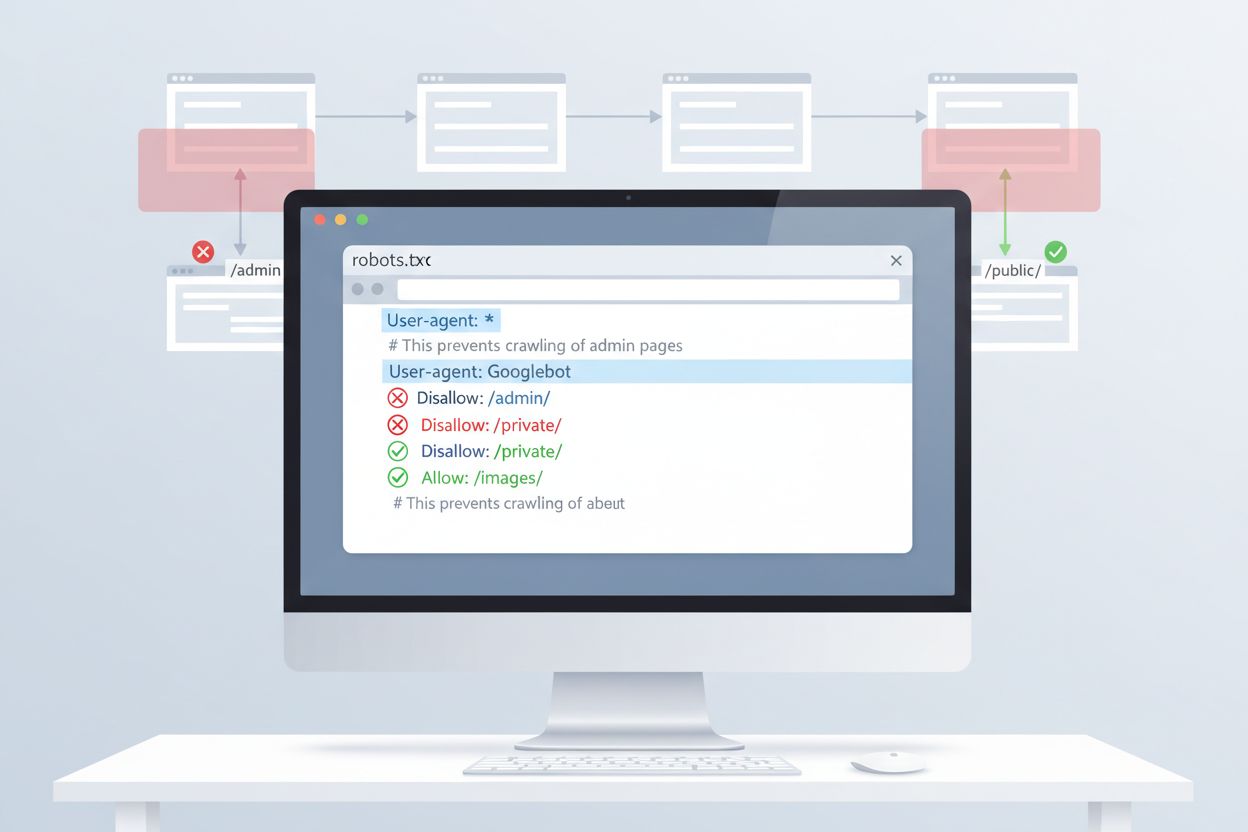

控制 ClaudeBot 访问最直接的方法是通过你网站根目录下的 robots.txt 配置。此文件告知爬虫哪些站点内容可被访问,Anthropic 的 ClaudeBot 遵守这些指令。若要完全阻止 ClaudeBot 活动,在 robots.txt 文件中添加以下规则:

User-agent: ClaudeBot

Disallow: /

如需更有选择性地阻止 ClaudeBot 访问特定目录,同时允许其他内容被抓取,可使用:

User-agent: ClaudeBot

Disallow: /private/

Disallow: /admin/

Allow: /public/

如果你希望同时阻止所有 Anthropic 爬虫(包括 anthropic-ai 和 Claude-Web),请为每个爬虫添加单独规则:

User-agent: ClaudeBot

Disallow: /

User-agent: anthropic-ai

Disallow: /

User-agent: Claude-Web

Disallow: /

虽然 robots.txt 是第一道防线,但它依赖爬虫自愿遵守。对于需要更强制性防护的发布者,还可采用以下方法:

这些方法比 robots.txt 配置更需技术能力,但能对不遵守规则的爬虫提供更强制的拦截。

阻止 ClaudeBot 对传统 SEO 排名直接影响极小,因为训练爬虫不会参与搜索引擎索引——Google、Bing 等搜索引擎使用独立的爬虫(Googlebot、Bingbot)运行。但阻止 ClaudeBot 可能会减少你内容在 Claude AI 生成回复中的出现频率,未来或影响通过 AI 搜索和聊天界面被发现的机会。是否阻止 ClaudeBot,需结合自身内容变现模式权衡:如果你主要依赖网站直接流量和广告展示,阻止 ClaudeBot 可防止你的内容被吸入训练数据集,减少潜在访客流失。相反,允许 ClaudeBot 可能提升你在 Claude 回复中的可见度,为 AI 聊天用户带来引荐流量。

有效管理 ClaudeBot 需要持续监控和测试你的配置。可使用 Google Search Console 的 robots.txt 测试工具、Merkle 的 robots.txt 测试平台,或 Dark Visitors 等专业工具,验证你的阻止规则是否生效。定期检查服务器日志,确认 ClaudeBot 是否遵守 robots.txt,并监控抓取模式变化。由于 AI 爬虫生态快速演变,新爬虫不断出现,建议每季度检查一次 robots.txt 配置,以应对新爬虫,确保内容保护策略合规。在正式部署前务必测试配置,避免误阻合法搜索引擎或其他重要爬虫。

追踪 ClaudeBot 及其他 AI 爬虫对你内容的访问。洞察哪些 AI 系统在引用你的品牌以及你的内容如何被用于 AI 生成的回复中。

了解 ClaudeBot 的工作原理、它与 Claude-Web 和 Claude-SearchBot 的区别,以及如何通过 robots.txt 配置管理 Anthropic 的网络爬虫在您网站上的行为。...

Claude 是由 Anthropic 推出的先进 AI 助手,基于宪法式 AI 技术。了解 Claude 的工作原理、核心功能、安全机制,以及它与 ChatGPT 等其他 AI 模型的对比。...

社区讨论专门针对Claude AI的优化。关于Claude与ChatGPT有何不同以及哪些策略适用于Anthropic AI助手的真实见解。

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.