ClaudeBot forklart: Anthropics crawler og ditt innhold

Lær hvordan ClaudeBot fungerer, hvordan den skiller seg fra Claude-Web og Claude-SearchBot, og hvordan du kan styre Anthropics nett-crawlers på din nettside med...

ClaudeBot er Anthropics nettrobot som brukes til å samle inn treningsdata for Claude AI-modeller. Den gjennomsøker systematisk offentlig tilgjengelige nettsider for å samle innhold til maskinlæringsmodelltrening. Nettstedeiere kan kontrollere ClaudeBots tilgang gjennom robots.txt-konfigurasjon. Roboten respekterer standard robots.txt-direktiver, slik at nettsteder kan blokkere eller tillate besøk.

ClaudeBot er Anthropics nettrobot som brukes til å samle inn treningsdata for Claude AI-modeller. Den gjennomsøker systematisk offentlig tilgjengelige nettsider for å samle innhold til maskinlæringsmodelltrening. Nettstedeiere kan kontrollere ClaudeBots tilgang gjennom robots.txt-konfigurasjon. Roboten respekterer standard robots.txt-direktiver, slik at nettsteder kan blokkere eller tillate besøk.

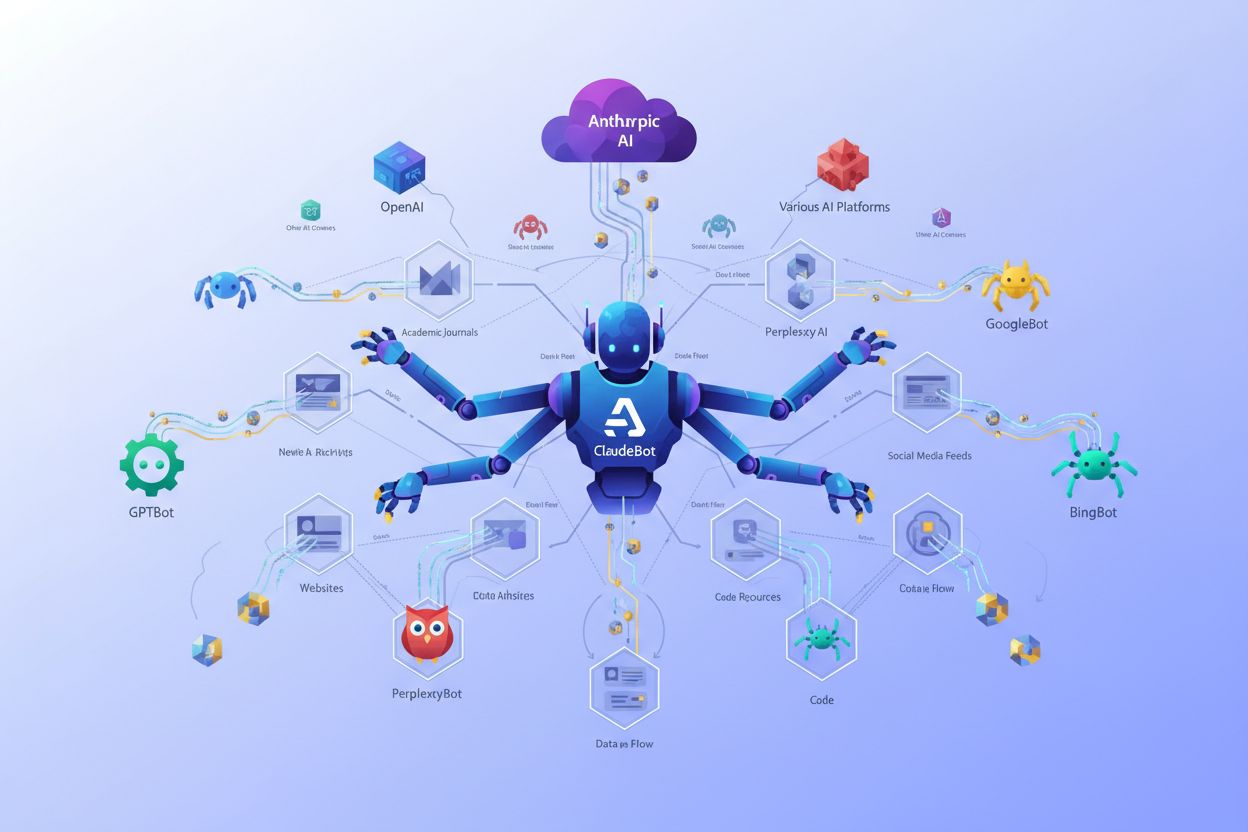

ClaudeBot er en nettcrawler som drives av Anthropic for å laste ned treningsdata til sine store språkmodeller (LLM-er) som driver AI-produkter som Claude. Denne AI-datasamleren gjennomsøker systematisk nettsteder for å samle innhold spesielt til maskinlæringsmodelltrening, noe som skiller den fra tradisjonelle søkemotorroboter som indekserer innhold for oppslag. ClaudeBot kan identifiseres via sin user agent-streng og kan blokkeres eller tillates gjennom robots.txt-konfigurasjon, slik at nettstedseiere kan kontrollere om innholdet deres brukes til å trene Anthropics AI-modeller.

ClaudeBot opererer gjennom systematiske nettoppdagelsesmetoder, inkludert å følge lenker fra indekserte sider, behandle sitemaps og bruke start-URL-er fra offentlige nettsidelister. Roboten laster ned nettstedinnhold for å inkludere i datasett brukt til å trene Claudes språkmodeller, og samler inn data fra offentlig tilgjengelige sider uten å kreve autentisering. I motsetning til søkemotorroboter som prioriterer indeksering for oppslag, er ClaudeBots crawling-mønstre vanligvis uklare, og Anthropic oppgir sjelden spesifikke utvalgskriterier, crawl-frekvens eller prioriteringer for ulike innholdstyper.

Tabellen under sammenligner ClaudeBot med andre Anthropic-roboter:

| Botnavn | Formål | User Agent | Omfang |

|---|---|---|---|

| ClaudeBot | Chat-sitering og treningsdata | ClaudeBot/1.0 | Generell nettgjennomsøking for modelltrening |

| anthropic-ai | Innsamling av store mengder treningsdata | anthropic-ai | Storskala treningsdatasett-kompilering |

| Claude-Web | Nettfokusert crawling for Claude-funksjoner | Claude-Web | Nettsøk og sanntidsinformasjon |

ClaudeBot opererer på lignende måte som andre store AI-treningsroboter som GPTBot (OpenAI) og PerplexityBot (Perplexity), men med tydelige forskjeller i omfang og metode. Mens GPTBot fokuserer på OpenAIs treningsbehov og PerplexityBot tjener både søk og trening, retter ClaudeBot seg spesielt mot innhold for Claudes modelltrening. Ifølge Dark Visitors-data blokkerer omtrent 18 % av verdens 1 000 største nettsteder aktivt ClaudeBot, noe som viser betydelig bekymring blant utgivere rundt datainnsamlingspraksisen. Hovedforskjellen ligger i hvordan hvert selskap prioriterer innsamling av innhold—Anthropics tilnærming vektlegger systematisk, bredbasert crawling for treningsdata, mens søkefokuserte roboter balanserer indeksering med henvisningstrafikk.

Nettstedeiere kan identifisere ClaudeBot-besøk ved å overvåke serverlogger for den karakteristiske user agent-strengen: Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko; compatible; ClaudeBot/1.0; +claudebot@anthropic.com). ClaudeBot kommer vanligvis fra amerikanske IP-områder, og besøk kan spores via serverlogganalyse eller dedikerte overvåkingsverktøy. Å sette opp agentanalyse-plattformer gir sanntidsinnsikt i ClaudeBot-besøk, slik at du kan måle crawl-frekvens og mønstre.

Her er et eksempel på hvordan ClaudeBot vises i serverlogger:

203.0.113.45 - - [03/Jan/2025:09:15:32 +0000] "GET /blog/article-title HTTP/1.1" 200 5432 "-" "Mozilla/5.0 AppleWebKit/537.36 (KHTML, like Gecko; compatible; ClaudeBot/1.0; +claudebot@anthropic.com)"

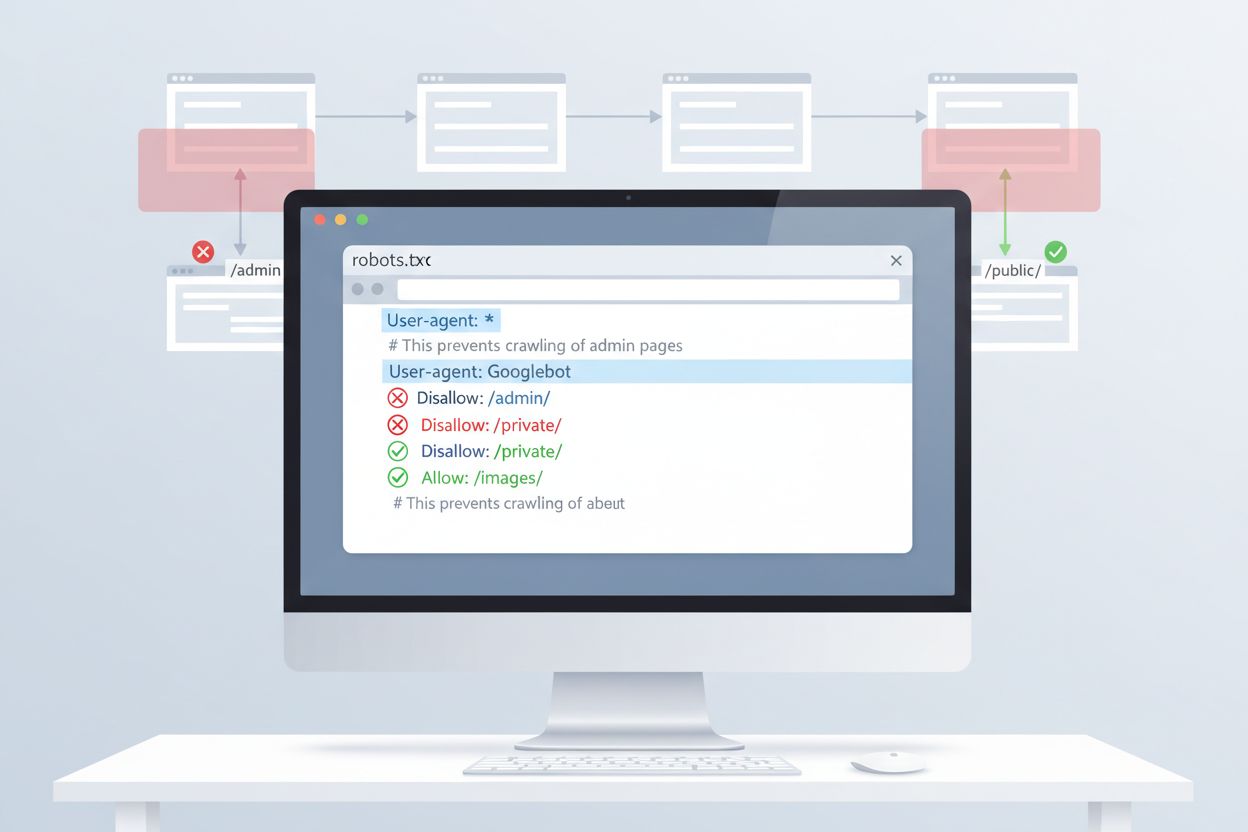

Den enkleste metoden for å kontrollere tilgang fra ClaudeBot er via robots.txt-konfigurasjon i rotmappen på nettstedet ditt. Denne filen instruerer roboter om hvilke deler av nettstedet de kan få tilgang til, og Anthropics ClaudeBot respekterer disse direktivene. For å blokkere all ClaudeBot-aktivitet, legg til følgende regler i robots.txt-filen din:

User-agent: ClaudeBot

Disallow: /

For mer selektiv blokkering som hindrer ClaudeBot i å få tilgang til bestemte kataloger, men tillater annet innhold å bli crawlet, bruk:

User-agent: ClaudeBot

Disallow: /private/

Disallow: /admin/

Allow: /public/

Hvis du vil blokkere alle Anthropic-roboter (inkludert anthropic-ai og Claude-Web), legg til egne regler for hver:

User-agent: ClaudeBot

Disallow: /

User-agent: anthropic-ai

Disallow: /

User-agent: Claude-Web

Disallow: /

Selv om robots.txt gir det første forsvarslinjen, bygger den på frivillig etterlevelse. For utgivere som krever sterkere håndheving, finnes flere tilleggsmetoder:

Disse metodene krever mer teknisk kompetanse enn robots.txt, men gir sterkere håndheving mot roboter som ikke overholder reglene.

Å blokkere ClaudeBot har minimal direkte innvirkning på tradisjonelle SEO-rangeringer siden treningsroboter ikke bidrar til søkemotorindeksering—Google, Bing og andre søkemotorer bruker egne roboter (Googlebot, Bingbot) som opererer uavhengig. Men blokkering av ClaudeBot kan redusere synligheten til innholdet ditt i AI-genererte svar fra Claude, noe som potensielt kan påvirke fremtidig synlighet via AI-søk og chatgrensesnitt. Det strategiske valget om å blokkere eller tillate ClaudeBot avhenger av din modell for inntektsgenerering: Hvis inntekten din er avhengig av direkte nettrafikk og annonsevisninger, hindrer blokkering at innholdet ditt havner i treningsdatasett som kan redusere besøkstallene. På den annen side kan tillatelse til ClaudeBot øke synligheten din i Claudes svar, og potensielt gi trafikk fra AI-chatbrukere.

Effektiv håndtering av ClaudeBot krever kontinuerlig overvåking og testing av konfigurasjonen din. Bruk verktøy som Google Search Console sin robots.txt-tester, Merkles robots.txt-testing, eller spesialiserte plattformer som Dark Visitors for å forsikre deg om at blokkeringen fungerer som forventet. Gå jevnlig gjennom serverloggene for å bekrefte at ClaudeBot respekterer robots.txt-direktivene dine og overvåk eventuelle endringer i crawling-mønstre. Siden landskapet for AI-roboter utvikler seg raskt med nye roboter som stadig oppdages, sikrer kvartalsvise gjennomganger av robots.txt-konfigurasjonen at du adresserer nye roboter og opprettholder beskyttelse av innholdet ditt. Test konfigurasjonen før du ruller den ut for å unngå utilsiktet blokkering av legitime søkemotorer eller andre viktige roboter.

Følg med på ClaudeBot og andre AI-roboter som besøker innholdet ditt. Få innsikt i hvilke AI-systemer som siterer merkevaren din og hvordan innholdet ditt brukes i AI-genererte svar.

Lær hvordan ClaudeBot fungerer, hvordan den skiller seg fra Claude-Web og Claude-SearchBot, og hvordan du kan styre Anthropics nett-crawlers på din nettside med...

Lær hva CCBot er, hvordan den fungerer, og hvordan du blokkerer den. Forstå dens rolle i AI-trening, overvåkingsverktøy og beste praksis for å beskytte innholde...

Claude er Anthropics avanserte AI-assistent drevet av Konstitusjonell AI. Lær hvordan Claude fungerer, nøkkelfunksjoner, sikkerhetsmekanismer og hvordan den sam...

Informasjonskapselsamtykke

Vi bruker informasjonskapsler for å forbedre din surfeopplevelse og analysere vår trafikk. See our privacy policy.