Cum Structurez Conținutul pentru Citări AI? Ghid Complet pentru 2025

Află cum să structurezi conținutul pentru a fi citat de motoarele de căutare AI precum ChatGPT, Perplexity și Google AI. Strategii experte pentru vizibilitate ș...

Află cum să testezi formatele de conținut pentru citări AI folosind metodologia A/B testing. Descoperă ce formate oferă cea mai mare vizibilitate și cele mai ridicate rate de citare AI pe ChatGPT, Google AI Overviews și Perplexity.

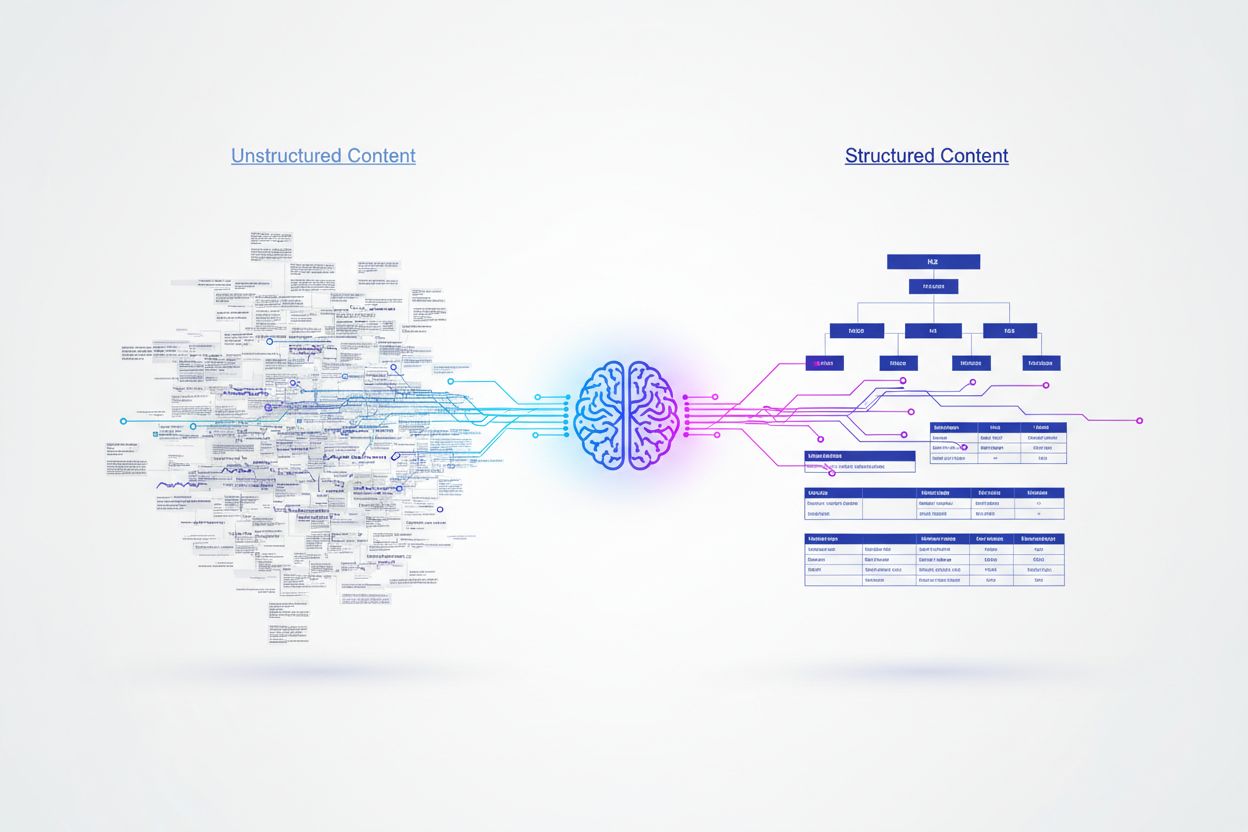

Sistemele de inteligență artificială procesează conținutul fundamental diferit față de cititorii umani, bazându-se pe semnale structurate pentru a înțelege sensul și a extrage informații. În timp ce oamenii pot naviga prin formate creative sau proză densă, modelele AI necesită ierarhii organizaționale clare și marcatori semantici pentru a parcurge și a înțelege eficient valoarea conținutului. Cercetările arată că conținutul structurat cu ierarhii corecte de heading obține rate de citare cu 156% mai mari decât alternativele nestructurate, evidențiind o diferență critică între conținutul prietenos pentru oameni și cel prietenos pentru AI. Această discrepanță există deoarece sistemele AI sunt antrenate pe seturi mari de date unde conținutul bine organizat este de obicei corelat cu surse autoritare și de încredere. Înțelegerea și testarea diferitelor formate de conținut a devenit esențială pentru brandurile care urmăresc vizibilitate în rezultatele de căutare și motoarele de răspuns bazate pe AI.

Diferite platforme AI prezintă preferințe distincte pentru sursele și formatele de conținut, creând un peisaj complex pentru optimizare. Cercetările care analizează 680 de milioane de citări pe platforme majore arată diferențe notabile în modul în care ChatGPT, Google AI Overviews și Perplexity își aleg sursele de informație. Aceste platforme nu citează pur și simplu aceleași surse—ele prioritizează diferite tipuri de conținut în funcție de algoritmii și datele de antrenament proprii. Înțelegerea acestor tipare specifice este crucială pentru dezvoltarea unor strategii de conținut targetate care să maximizeze vizibilitatea pe mai multe sisteme AI.

| Platformă | Sursa cea mai citată | Procent citare | Format preferat |

|---|---|---|---|

| ChatGPT | Wikipedia | 7,8% din totalul citărilor | Baze de cunoștințe autoritare, conținut enciclopedic |

| Google AI Overviews | 2,2% din totalul citărilor | Discuții de comunitate, conținut generat de utilizatori | |

| Perplexity | 6,6% din totalul citărilor | Informații peer-to-peer, perspective comunitare |

Preferința covârșitoare a ChatGPT pentru Wikipedia (reprezentând 47,9% din top 10 surse) arată o tendință spre conținut factual, autoritar, cu credibilitate consacrată. În contrast, atât Google AI Overviews cât și Perplexity au distribuții mai echilibrate, cu Reddit dominând tiparele de citare. Aceasta relevă că Perplexity prioritizează informația generată de comunitate în proporție de 46,7% din sursele de top, în timp ce Google menține o abordare mai diversificată între mai multe tipuri de platforme. Datele arată clar că o strategie universală de conținut nu poate avea succes—brandurile trebuie să-și adapteze abordarea în funcție de platformele AI relevante pentru publicul țintă.

Schema markup reprezintă poate cel mai important factor în probabilitatea de citare AI, implementarea corectă în JSON-LD ducând la rate de citare cu 340% mai mari decât conținutul identic fără date structurate. Această diferență dramatică provine din modul în care motoarele AI interpretează sensul semantic—datele structurate oferă context explicit care elimină ambiguitatea interpretării. Când un motor AI întâlnește schema markup, înțelege instantaneu relațiile între entități, tipurile de conținut și importanța ierarhică, fără a se baza doar pe procesarea limbajului natural.

Cele mai eficiente implementări de schemă includ Article schema pentru postări de blog, FAQ schema pentru secțiuni de întrebări și răspunsuri, HowTo schema pentru conținut instrucțional și Organization schema pentru recunoașterea brandului. Formatul JSON-LD depășește alte formate de date structurate deoarece motoarele AI îl pot analiza independent de conținutul HTML, permițând extragerea mai curată a datelor și reducând complexitatea procesării. Tag-urile semantice HTML precum <header>, <nav>, <main>, <section>, și <article> oferă claritate suplimentară care ajută sistemele AI să înțeleagă structura și ierarhia conținutului mai eficient decât marcajul de bază.

A/B testing-ul oferă cea mai fiabilă metodologie pentru a determina care formate de conținut generează cele mai mari rate de citare AI în nișa ta specifică. În loc să te bazezi pe bune practici generale, experimentele controlate îți permit să măsori impactul real al schimbărilor de format asupra audienței și vizibilității în AI. Procesul necesită planificare atentă pentru a izola variabilele și a asigura validitate statistică, dar insight-urile obținute justifică investiția.

Urmează acest framework sistematic de testare A/B:

Semnificația statistică necesită atenție la dimensiunea eșantionului și durata testului. În aplicațiile AI cu date rare sau distribuții long-tail, colectarea rapidă a observațiilor suficiente poate fi o provocare. Majoritatea experților recomandă teste de cel puțin 2-4 săptămâni pentru a ține cont de variațiile temporale și a obține rezultate fiabile.

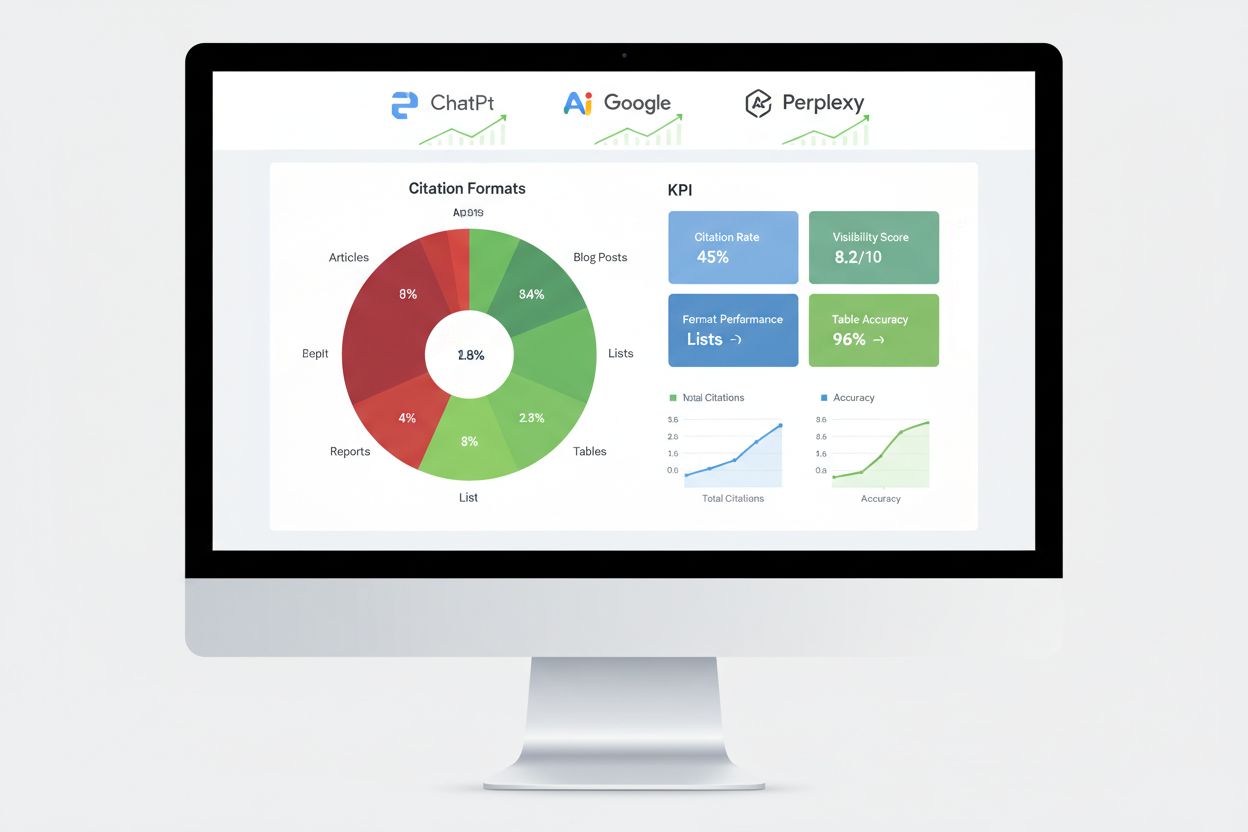

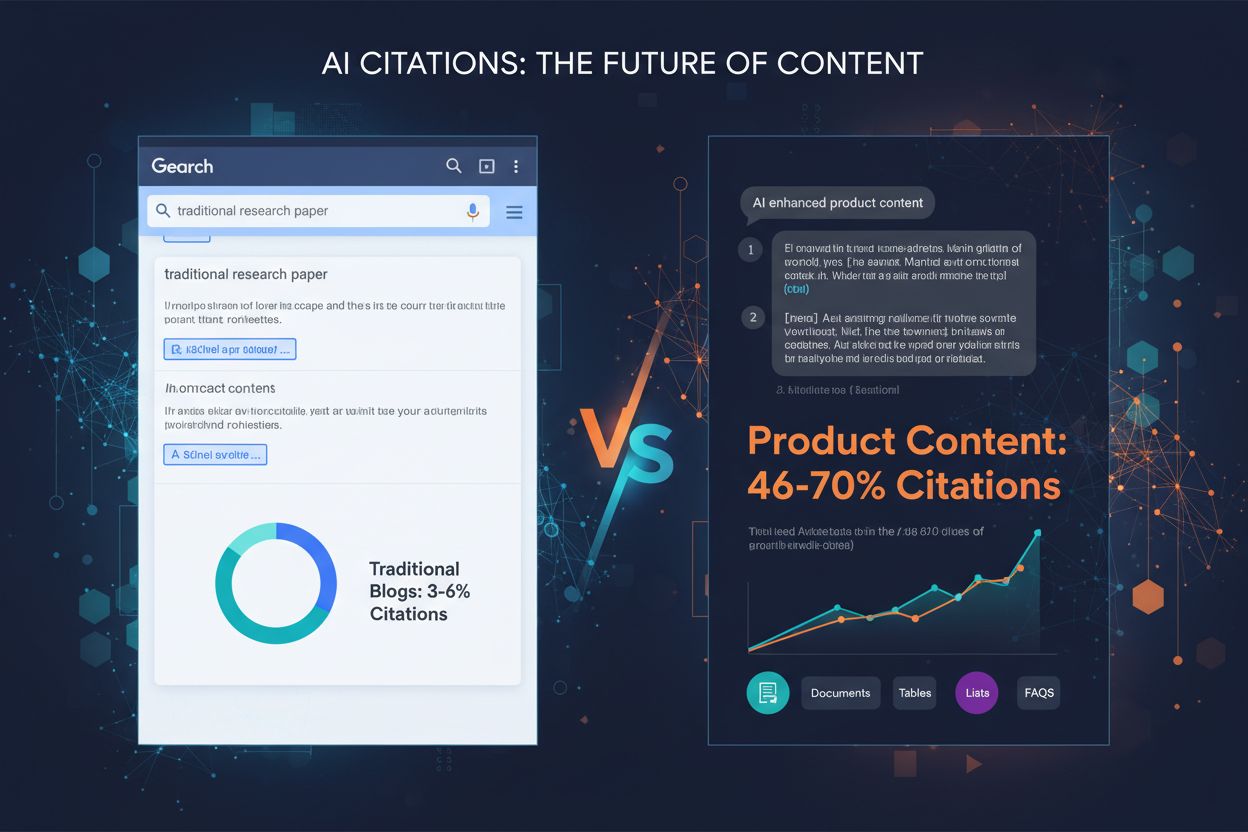

Cercetările pe mii de citări AI dezvăluie ierarhii clare de performanță între diferite formate de conținut. Conținutul bazat pe liste primește cu 68% mai multe citări AI decât alternativele axate pe paragrafe, în principal pentru că listele oferă unități discrete și ușor de analizat pe care motoarele AI le pot extrage și sintetiza rapid. La generarea răspunsurilor, platformele AI pot face referire la elemente specifice din listă fără a restructura sau parafraza propoziții complexe, ceea ce face ca listele să fie extrem de valoroase pentru citare.

Tabelele demonstrează performanță excepțională cu până la 96% acuratețe în analiza AI, depășind semnificativ descrierile în proză ale aceleiași informații. Conținutul tabelar permite sistemelor AI să extragă rapid date specifice fără procesare textuală complexă, făcând tabelele deosebit de valoroase pentru informații factuale, comparative sau statistice. Formatele de tip întrebare și răspuns obțin o vizibilitate AI cu 45% mai mare comparativ cu paragrafele tradiționale pe aceleași subiecte, deoarece conținutul Q&A reflectă modul în care utilizatorii interacționează cu platformele AI și modul în care acestea generează răspunsuri.

Formatele de comparație (X vs Y) performează excelent deoarece oferă structuri binare, ușor de rezumat, care se aliniază cu modul în care AI dezvoltă subiecte din întrebări. Studiile de caz îmbină narațiunea cu date, fiind persuasive pentru cititori și interpretabile de AI prin structura problemă-soluție-rezultate. Cercetarea originală și insight-urile experților primesc tratament preferențial deoarece oferă date proprii, indisponibile în altă parte, adăugând semnale de credibilitate recunoscute și recompensate de AI. Insight-ul cheie este că niciun format nu funcționează universal—cea mai bună abordare combină strategic mai multe formate în funcție de tipul de conținut și platformele AI țintite.

Implementarea schema markup implică înțelegerea tipurilor disponibile și alegerea celor mai relevante pentru conținutul tău. Pentru bloguri și articole, Article schema oferă metadate cuprinzătoare, inclusiv autor, dată de publicare și structură de conținut. FAQ schema funcționează excepțional pentru secțiuni Q&A, etichetând explicit întrebările și răspunsurile pentru ca sistemele AI să le extragă fiabil. HowTo schema este benefică pentru conținut instrucțional, definind pași secvențiali, iar Product schema ajută site-urile e-commerce să comunice specificații și prețuri.

{

"@context": "https://schema.org",

"@type": "FAQPage",

"mainEntity": [

{

"@type": "Question",

"name": "Care este cel mai bun format de conținut pentru citări AI?",

"acceptedAnswer": {

"@type": "Answer",

"text": "Cel mai bun format de conținut depinde de platformă și public, dar formatele structurate precum listele, tabelele și secțiunile Q&A obțin constant rate mai mari de citare AI. Listele primesc cu 68% mai multe citări decât paragrafele, iar tabelele ating o acuratețe de analiză de 96%."

}

}

]

}

Implementarea necesită atenție la acuratețea sintaxei—schema markup invalid poate chiar dăuna șanselor de citare AI în loc să le îmbunătățească. Folosește Google Rich Results Test sau instrumentele de validare Schema.org pentru a verifica marcajul înainte de publicare. Menține ierarhii de structurare consistente cu H2 pentru secțiunile principale, H3 pentru subpuncte și paragrafe scurte (50-75 cuvinte maxim) axate pe un singur concept. Adaugă rezumate TL;DR la începutul sau sfârșitul secțiunilor pentru a oferi AI fragmente gata de utilizat ca răspunsuri independente.

Măsurarea performanței în motoarele AI necesită metrici diferite față de SEO-ul tradițional, concentrându-se pe monitorizarea citărilor, rate de includere în răspunsuri și mențiuni în knowledge graph, nu pe poziții de ranking. Monitorizarea citărilor pe platformele majore oferă cea mai directă perspectivă asupra succesului testelor de format, arătând ce conținut este efectiv referențiat de sisteme AI. Instrumente precum AmICited urmăresc modul în care platformele AI citează brandul tău pe ChatGPT, Google AI Overviews, Perplexity și alte motoare de răspuns, oferind vizibilitate asupra tiparelor și trendurilor de citare.

Abordările esențiale de măsurare includ urmărirea ratei de captare a featured snippet-urilor, care indică conținutul considerat de AI drept valoros pentru răspunsuri directe. Aparițiile în knowledge panel semnalează că AI recunoaște brandul tău ca entitate autoritară demnă de panouri dedicate. Includerile în rezultatele voice search arată dacă apari în răspunsuri conversaționale AI, iar ratele de răspuns ale motoarelor generative măsoară cât de des AI face referire la conținutul tău la interogări utilizator. Testarea A/B a diferitelor abordări de format oferă cele mai fiabile date de performanță, izolând fiecare variabilă pentru a identifica factorii de impact. Stabilește metrici de bază înainte de schimbări, apoi monitorizează performanța săptămânal pentru a identifica trenduri și anomalii care pot indica variante de format de succes sau nereușite.

Multe organizații care fac testări de format cad în capcane previzibile ce compromit rezultatele și conduc la concluzii greșite. Dimensiunile insuficiente ale eșantionului reprezintă cea mai comună eroare—testarea cu prea puține citări sau interacțiuni duce la rezultate statistic nesemnificative care pot părea relevante, dar reflectă variații aleatorii. Asigură-te că aduni cel puțin 100 de citări pe variație înainte de a trage concluzii și folosește calculatoare statistice pentru a determina dimensiunea exactă a eșantionului pentru nivelul tău de încredere și efect.

Variabilele confuzante introduc bias atunci când mai mulți factori se schimbă simultan, făcând imposibilă determinarea cauzei diferenței observate. Menține toate elementele identice, exceptând formatul testat—păstrează aceleași cuvinte cheie, lungime, structură și moment al publicării. Biasul temporal apare când testarea are loc în perioade atipice (sărbători, evenimente majore, schimbări de algoritm) ce pot distorsiona rezultatele. Rulează teste în perioade normale și ține cont de variațiile sezoniere testând cel puțin 2-4 săptămâni. Biasul de selecție apare când grupurile de test diferă în moduri ce influențează rezultatele—asigură alocare aleatorie a conținutului pe variante. Confundarea corelației cu cauzalitatea duce la concluzii false când factori externi coincid accidental cu perioada testului. Ia întotdeauna în calcul explicații alternative pentru schimbările observate și validează rezultatele prin mai multe cicluri de testare înainte de a implementa schimbări permanente.

O companie tech care a testat formate de conținut pentru vizibilitate AI a descoperit că transformarea articolelor de comparație de produs din format paragraf în tabele structurate a crescut citările AI cu 52% în 60 de zile. Tabelele au oferit informație clară, ușor de scanat, pe care AI a putut să o extragă direct, în timp ce proza originală necesita analiză mai complexă. S-au menținut identice lungimea conținutului și optimizarea cuvintelor cheie, izolând formatul ca unic factor variat.

O firmă de servicii financiare a implementat FAQ schema pe conținutul existent, fără să rescrie nimic, adăugând doar markup structurat la secțiunile de întrebări și răspunsuri. Acest lucru a dus la o creștere de 34% a aparițiilor featured snippet și o creștere de 28% a citărilor AI în 45 de zile. Schema markup nu a schimbat conținutul, dar a făcut mult mai ușoară identificarea și extragerea răspunsurilor relevante de către AI. O companie SaaS a realizat testare multivariată pe trei formate simultan—liste, tabele și paragrafe tradiționale—pentru același conținut despre funcții de produs. Rezultatele au arătat că listele au depășit paragrafele cu 68%, iar tabelele au atins cea mai mare acuratețe la analiză AI, dar un volum total de citări mai mic. Aceasta a arătat că eficacitatea formatului variază în funcție de tipul de conținut și platforma AI, confirmând că testarea este esențială, nu doar bunele practici generale. Aceste exemple reale demonstrează că testarea formatului aduce îmbunătățiri măsurabile și semnificative în vizibilitatea AI atunci când este executată corect.

Peisajul testării formatelor de conținut evoluează pe măsură ce sistemele AI devin mai sofisticate și apar noi tehnici de optimizare. Algoritmii multi-armed bandit reprezintă o avansare majoră față de A/B testing-ul tradițional, ajustând dinamic alocarea traficului pe variante în funcție de performanța în timp real, fără a aștepta încheierea perioadelor de testare. Această abordare reduce timpul necesar identificării variantei câștigătoare și maximizează performanța chiar în timpul testării.

Experimentarea adaptivă bazată pe învățare prin întărire permite modelelor AI să învețe și să se adapteze continuu în funcție de experimentele derulate, îmbunătățind performanța în timp real și nu doar în cicluri discrete de testare. Automatizarea AI în testarea A/B folosește AI-ul însuși pentru a automatiza proiectarea experimentelor, analiza rezultatelor și recomandările de optimizare, permițând testarea simultană a mai multor variante fără creșterea proporțională a complexității. Aceste abordări emergente promit cicluri de iterație mai rapide și strategii de optimizare mai sofisticate. Organizațiile care stăpânesc testarea formatelor de conținut acum vor avea avantaje competitive pe măsură ce aceste tehnici avansate devin standard, poziționându-se să valorifice platformele AI emergente și algoritmii de citare în evoluție înainte ca rivalii să-și adapteze strategiile.

Cel mai bun format de conținut depinde de platformă și public, dar formatele structurate precum listele, tabelele și secțiunile Q&A obțin constant rate mai mari de citare AI. Listele primesc cu 68% mai multe citări decât paragrafele, iar tabelele ating o acuratețe de analiză de 96%. Cheia este să testezi diferite formate cu propriul tău conținut pentru a identifica ce funcționează cel mai bine.

Majoritatea experților recomandă rularea testelor cel puțin 2-4 săptămâni pentru a ține cont de variațiile temporale și a asigura rezultate fiabile. Această durată îți permite să aduni suficiente date (de obicei peste 100 de citări per variație) și să iei în considerare variațiile sezoniere sau modificările de algoritm ale platformei care pot distorsiona rezultatele.

Da, poți face teste multivariate pe mai multe formate simultan, dar acest lucru necesită planificare atentă pentru a evita complexitatea interpretării rezultatelor. Începe cu teste A/B simple comparând două formate, apoi treci la testare multivariată după ce înțelegi bazele și ai resurse statistice adecvate.

De obicei ai nevoie de cel puțin 100 de citări sau interacțiuni per variație pentru a obține semnificație statistică. Folosește calculatoare statistice pentru a determina dimensiunea exactă a eșantionului necesară nivelului tău de încredere și mărimii efectului. Eșantioanele mai mari oferă rezultate mai fiabile, dar necesită perioade de testare mai lungi.

Începe prin a identifica cel mai relevant tip de schemă pentru conținutul tău (Article, FAQ, HowTo etc.), apoi folosește formatul JSON-LD pentru implementare. Validează marcajul folosind Google Rich Results Test sau instrumentele de validare Schema.org înainte de publicare. Marcajul de schemă invalid poate chiar dăuna șanselor de citare AI, deci acuratețea este esențială.

Prioritizează în funcție de publicul tău și obiectivele de business. ChatGPT favorizează sursele autoritare precum Wikipedia, Google AI Overviews preferă conținutul comunitar precum Reddit, iar Perplexity pune accent pe informații peer-to-peer. Analizează ce platforme trimit cel mai relevant trafic către site-ul tău și optimizează mai întâi pentru acelea.

Implementează testarea continuă ca parte a strategiei tale de conținut. Începe cu cicluri trimestriale de testare a formatelor, apoi crește frecvența pe măsură ce dezvolți expertiză și stabilești metrici de bază. Testarea regulată te ajută să rămâi în fața schimbărilor de algoritm AI și să descoperi preferințe emergente de formate.

Urmărește îmbunătățirea ratei de citare, ratele de captare a featured snippet-urilor, apariții în knowledge panel și ratele de răspuns ale motoarelor generative. Stabilește metrici de bază înainte de testare, apoi monitorizează performanța săptămânal pentru a identifica trenduri. Un test de succes arată de obicei o îmbunătățire de peste 20% a metricii principale în 4-8 săptămâni.

Urmărește cum platformele AI citează conținutul tău în diferite formate. Descoperă ce structuri de conținut generează cea mai mare vizibilitate AI și optimizează-ți strategia cu date reale.

Află cum să structurezi conținutul pentru a fi citat de motoarele de căutare AI precum ChatGPT, Perplexity și Google AI. Strategii experte pentru vizibilitate ș...

Află adâncimea optimă a conținutului, structura și nivelul de detaliu necesar pentru a fi citat de ChatGPT, Perplexity și Google AI. Descoperă ce face ca un con...

Descoperă ce formate de conținut sunt cel mai des citate de modelele AI. Analizează date din peste 768.000 de citări AI pentru a-ți optimiza strategia de conțin...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.