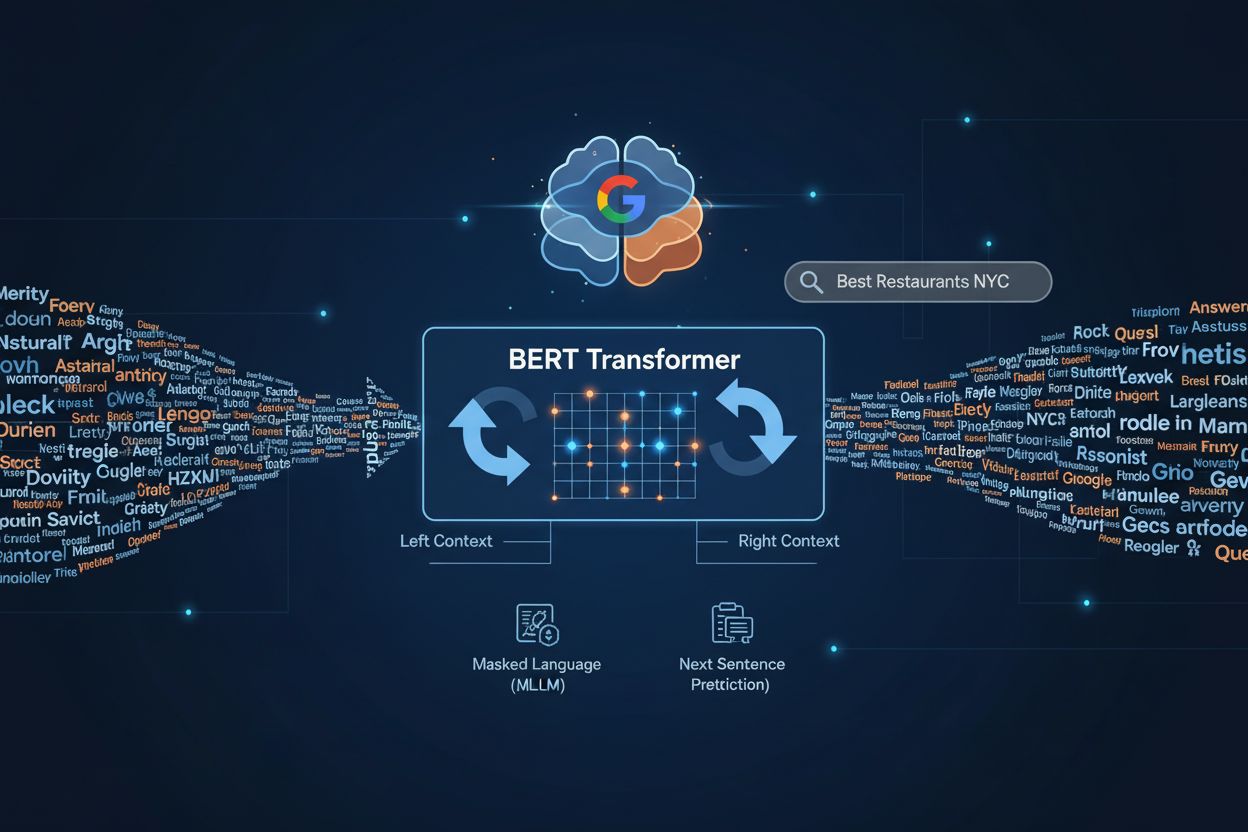

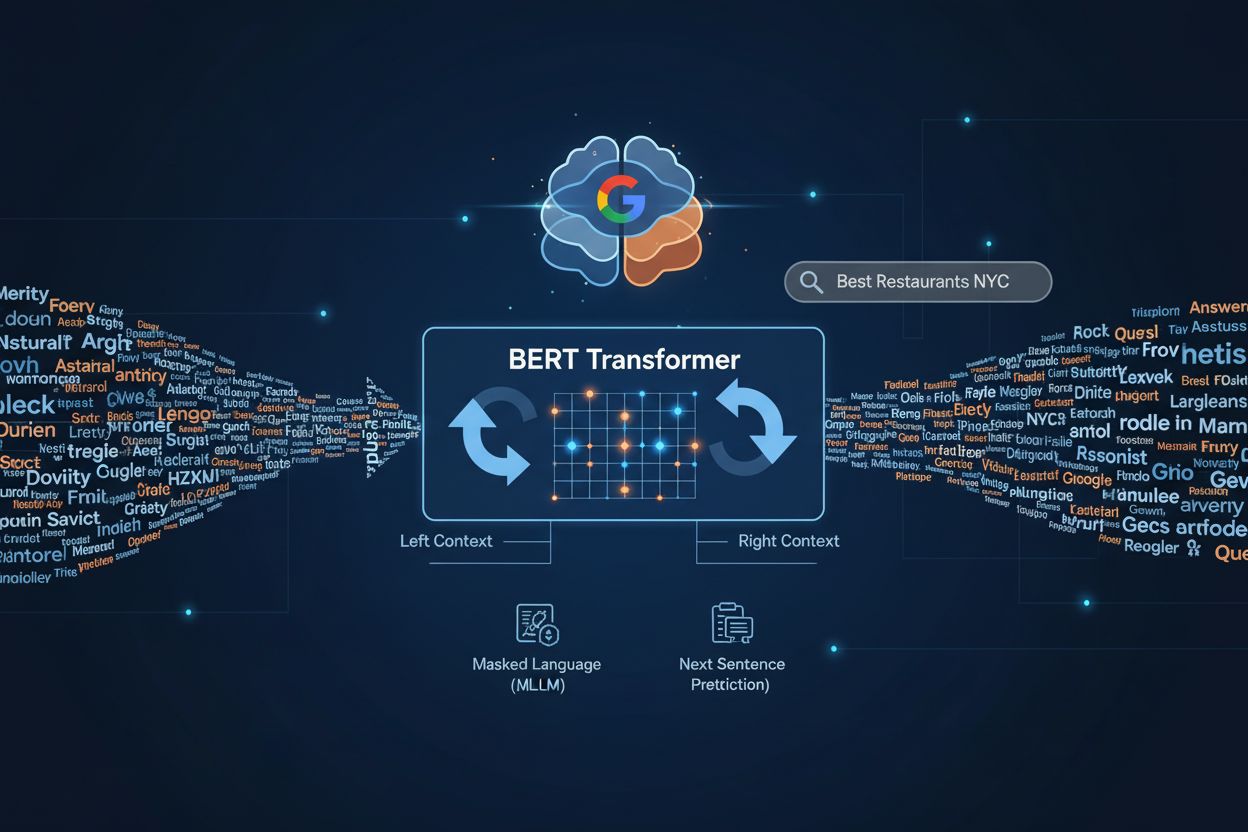

Actualizarea BERT

Află despre Actualizarea BERT a Google, o schimbare majoră a algoritmului din 2019 care folosește transformatoare bidirecționale pentru a îmbunătăți înțelegerea...

Tot citesc informații contradictorii despre BERT.

În 2019, BERT era LUCRUL de înțeles pentru SEO. Procesare a limbajului natural, înțelegerea contextului etc.

Acum toată lumea vorbește despre GPT-4, Claude, Gemini și sunt confuz.

Întrebările mele:

Încerc să trec de zgomot și să înțeleg ce contează cu adevărat pentru optimizarea conținutului acum.

Permite-mi să clarific peisajul tehnic.

Arborele genealogic al modelelor:

Transformer (2017)

├── BERT-style (encodere - înțeleg textul)

│ ├── BERT (Google, 2018)

│ ├── RoBERTa (Meta)

│ ├── MUM (Google, 2021)

│ └── Și altele

└── GPT-style (decodere - generează text)

├── Seria GPT (OpenAI)

├── Claude (Anthropic)

├── Gemini (Google)

└── Și altele

BERT este încă relevant, dar:

Ce contează cu adevărat:

| Tip Căutare | Stil Model Principal | Pe ce să te concentrezi |

|---|---|---|

| Google tradițional | BERT/MUM (encodere) | Potrivire interogare-conținut, intenție |

| AI Overviews | Hibrid | Răspunsuri extrase |

| ChatGPT/Perplexity | GPT-style (decodere) | Conținut cuprinzător, citabil |

Concluzia practică:

„Optimizarea pentru BERT” a însemnat mereu să scrii conținut natural, bogat în context. Asta nu s-a schimbat. Numele modelelor nu contează pentru strategia ta de optimizare.

Exact. „Optimizează pentru BERT” era un mod scurt de a spune:

Toate acestea încă se aplică. Optimizarea e pentru modul în care modelele lingvistice moderne înțeleg textul, nu pentru un model anume.

Principii care funcționează pentru toate modelele:

Acestea ajută BERT să îți înțeleagă conținutul pentru ranking ȘI ajută modelele de tip GPT să-l extragă pentru citări.

Perspectivă SEO asupra evoluției BERT.

Era BERT (2019-2021):

Era MUM/AI (2021-prezent):

Ce s-a schimbat în practică:

Sincer? Nu prea mult pentru strategia de conținut.

Sfaturile au fost mereu:

A funcționat pentru BERT. Funcționează pentru MUM. Funcționează pentru GPT.

Ce ESTE nou:

Stratul de citare/extragere. Modelele de tip GPT trebuie să extragă și să citeze conținutul tău, nu doar să-l potrivească cu interogări.

Asta cere:

Dar fundamentul limbajului natural rămâne la fel.

Perspectivă de strategie de conținut.

Cum le explic eu clienților:

„BERT era despre cum Google înțelege ce vrei să spui. GPT e despre cum AI folosește ce ai scris.”

Diferența practică:

Pentru căutare tradițională (înțelegere BERT/MUM):

Pentru răspunsuri AI (extragere GPT):

Suprapunerea:

Ambele recompensează:

Recomandarea mea:

Nu gândi în termeni de „optimizare pentru BERT vs GPT”. Gândește-te: „Cum creez conținut pe care modelele lingvistice îl pot înțelege (BERT) ȘI extrage/cita (GPT)?”

Răspunsul e același: conținut clar, natural, bine structurat, de expert.

Perspectivă de cercetare despre evoluție.

Unde se află BERT acum:

BERT a fost fundamental – a arătat industriei că înțelegerea bidirecțională a contextului funcționează. Google nu a „înlocuit” BERT; l-a evoluat.

Evoluția:

Pentru Google Search în mod specific:

Google folosește mai multe modele în stack-ul de ranking:

Ce înseamnă asta pentru tine:

Modelul specific nu contează pentru strategia ta. Contează că toate aceste modele:

Optimizează pentru aceste principii, nu pentru nume de modele specifice.

Perspectivă de redactare tehnică.

Ce am schimbat în scris din epoca BERT către era AI:

Accent în era BERT:

Adăugat pentru epoca AI:

Ce a rămas la fel:

Fluxul meu practic:

Principiile BERT sunt fundația. Optimizarea pentru AI e stratul suplimentar.

Perspectivă practică de consultant.

Ce le spun clienților despre BERT:

„Nu te preocupa de BERT în mod specific. Concentrează-te pe aceste principii pe care toate sistemele moderne de căutare le împărtășesc…”

Principii atemporale:

Ce s-a schimbat pentru AI:

Accent suplimentar pe:

Pe scurt:

„Optimizarea pentru BERT” era un termen de marketing pentru „scrie natural și răspunde la întrebări”. Asta încă se aplică. Doar că acum adaugi și optimizare pentru extragerea AI.

Perspectivă din date despre schimbările legate de BERT.

Monitorizarea performanței conținutului în diferite ere:

Am urmărit 1.000 de piese de conținut între 2019-2025:

Era BERT (2019-2021):

Era MUM/AI (2021-2025):

Tiparul:

Scrierea în limbaj natural (principiul BERT) rămâne fundamentală. Dar structura pentru extragere AI aduce un plus.

Implicarea practică:

Nu abandona principiile BERT. Construiește pe ele cu structură prietenoasă AI.

Ce folosim noi:

Am I Cited pentru a urmări ce formate de conținut sunt cel mai des citate de AI. Ajută să identifici ce structură funcționează dincolo de simplul limbaj natural.

Mi-ați clarificat confuzia. Rezumat:

Mai este BERT relevant?

Da, dar ca fundație, nu ca țintă specifică de optimizare. Principiile reprezentate de BERT (limbaj natural, context, intenție) sunt încă cruciale.

Ce s-a schimbat:

Ce fac eu:

Modelul mental:

BERT = Fundație (înțelegere) GPT = Strat deasupra (extragere și citare)

Ambele recompensează aceleași calități de bază. AI doar adaugă cerințe de structură.

Mulțumesc tuturor – mult mai clar acum.

Get personalized help from our team. We'll respond within 24 hours.

Urmărește cum sistemele AI înțeleg și citează conținutul tău. Vezi ce formate de conținut au cele mai bune rezultate în diferite modele lingvistice.

Află despre Actualizarea BERT a Google, o schimbare majoră a algoritmului din 2019 care folosește transformatoare bidirecționale pentru a îmbunătăți înțelegerea...

Discuție în comunitate despre cum funcționează motoarele de căutare AI. Experiențe reale de la marketeri care înțeleg LLM-urile, RAG și căutarea semantică compa...

Discuție comunitară despre GEO vs SEO. Înțelegerea modului de a echilibra optimizarea tradițională pentru motoarele de căutare cu optimizarea pentru căutarea AI...

Consimțământ Cookie

Folosim cookie-uri pentru a vă îmbunătăți experiența de navigare și a analiza traficul nostru. See our privacy policy.