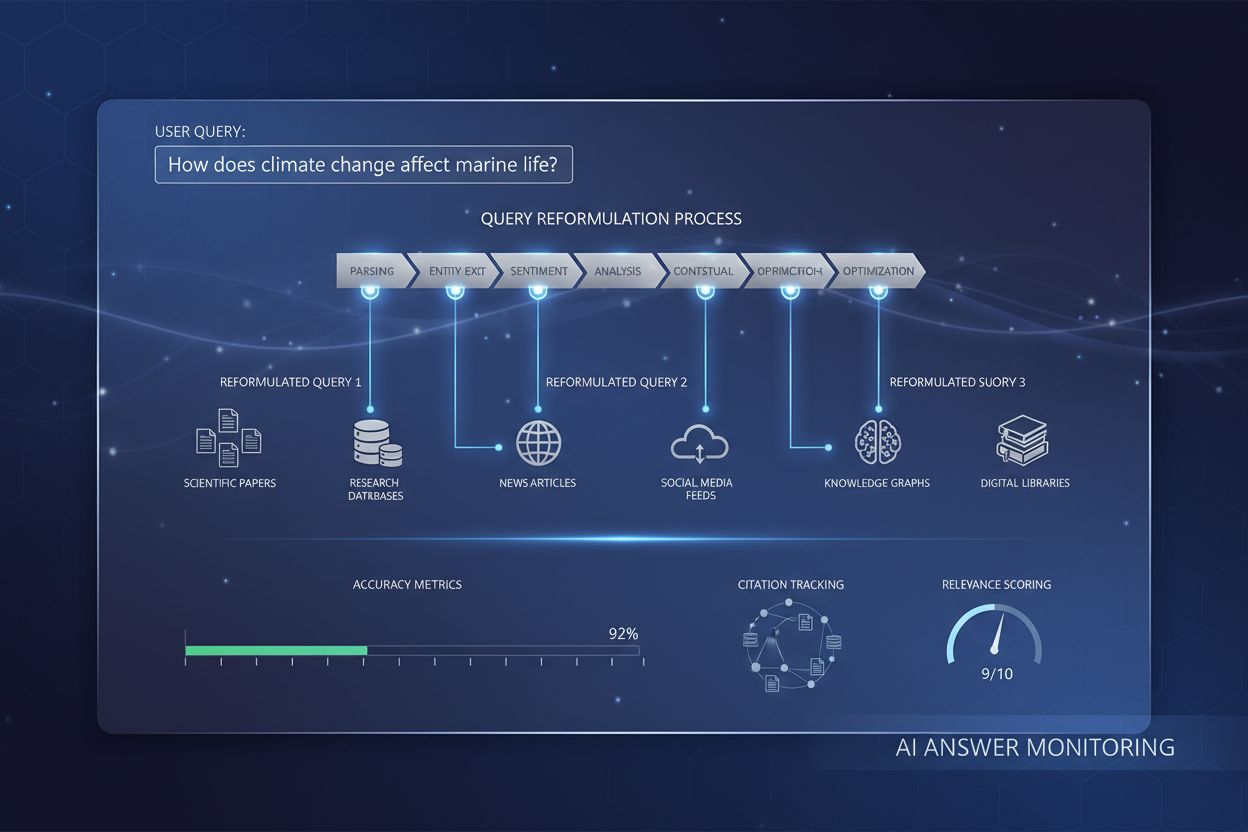

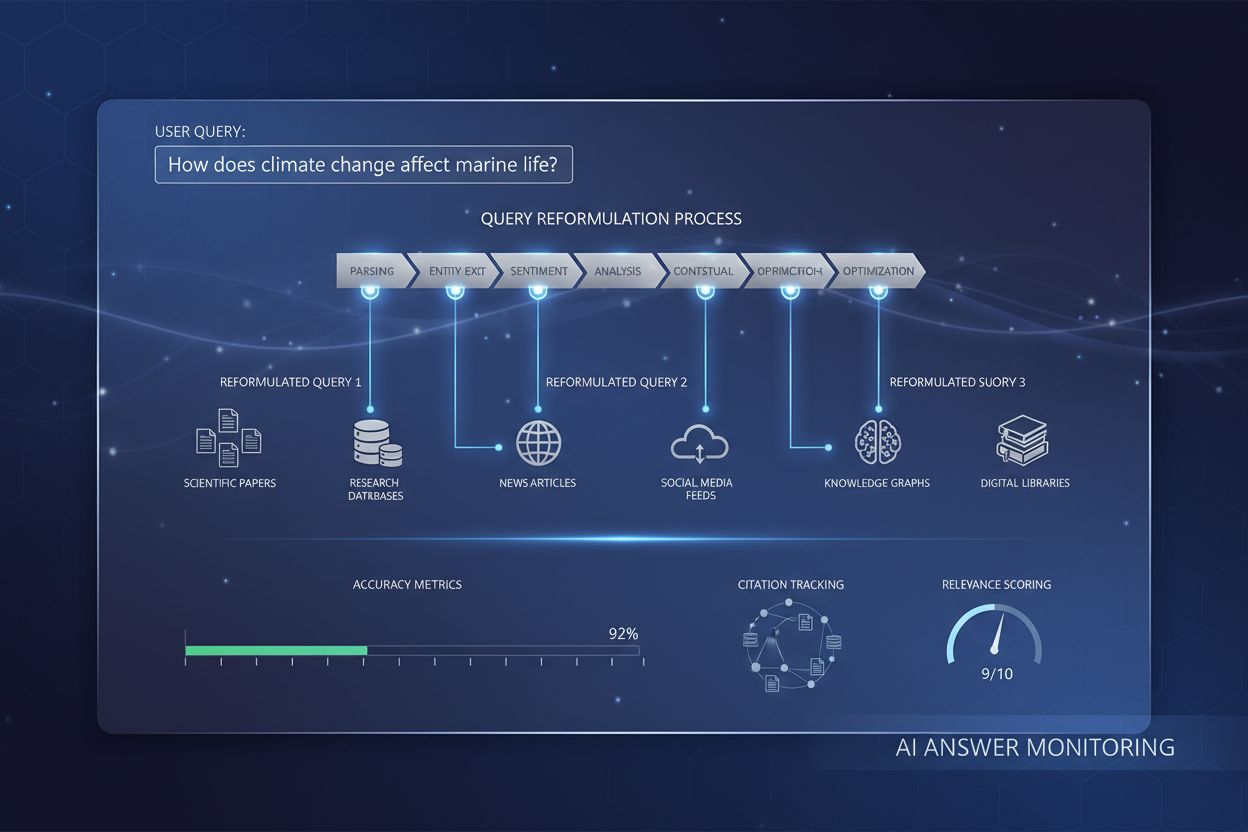

查询重述

了解查询重述如何帮助 AI 系统解释和增强用户查询,以实现更好的信息检索。掌握相关技术、优势及其对 AI 监控的影响。...

AI 去重逻辑指的是 AI 系统用来识别、分析并消除来自多个来源的冗余或重复信息的自动化流程和算法。这些系统采用机器学习、自然语言处理和相似性匹配等技术,能够在不同的数据存储库中识别相同或高度相似的内容,从而确保数据质量、降低存储成本并提升决策的准确性。

AI 去重逻辑指的是 AI 系统用来识别、分析并消除来自多个来源的冗余或重复信息的自动化流程和算法。这些系统采用机器学习、自然语言处理和相似性匹配等技术,能够在不同的数据存储库中识别相同或高度相似的内容,从而确保数据质量、降低存储成本并提升决策的准确性。

AI 去重逻辑是一种复杂的算法流程,利用人工智能和机器学习技术,从大型数据集中识别和消除重复或近似重复记录。该技术能够自动检测多个条目是否实际上代表同一个实体——无论是人、产品、文档还是信息本身——即使它们在格式、拼写或表现方式上存在差异。去重的核心目的是维护数据完整性并防止冗余,这些冗余会导致分析失真、增加存储成本,并降低决策的准确性。在当今数据驱动的世界中,企业每天都要处理数百万条记录,有效去重已成为提升运营效率和获取可靠洞察的关键。

AI 去重采用多种互补技术,能够极其精准地识别和聚类相似记录。流程从分析数据属性(如姓名、地址、电子邮件及其他识别信息)并将其与既定的相似度阈值进行比对开始。现代去重系统结合了语音相似匹配、字符串相似度算法和语义分析,能够发现传统规则系统容易遗漏的重复项。系统为潜在匹配打分,并将超过设定阈值的记录聚为同一实体。用户可以灵活调整去重包容度,根据具体场景和对误判的容忍度来设定灵敏性。

| 方法 | 描述 | 适用场景 |

|---|---|---|

| 语音相似 | 分组发音相近的字符串(如 “Smith” 与 “Smyth”) | 姓名变体、语音混淆 |

| 拼写相似 | 分组拼写近似的字符串 | 拼写错误、细微拼写变体 |

| TFIDF 相似度 | 应用词频-逆文档频率算法 | 一般文本匹配、文档相似性 |

去重引擎会多轮处理记录,先找出明显匹配项,再逐步分析更细微的变体。这种分层方法确保覆盖全面,同时在处理数百万级别数据时依然保持计算效率。

现代 AI 去重利用向量嵌入和语义分析来理解数据背后的含义,而不仅仅是比对表面特征。自然语言处理(NLP)让系统能够理解上下文和意图,识别出“Robert”、“Bob”和“Rob”其实都是同一个人。模糊匹配算法计算字符串间的编辑距离,发现仅有几处字符差异的记录——这对发现拼写错误和转录失误尤为关键。系统还会分析如时间戳、创建日期和修改历史等元数据,为是否为重复提供额外的置信度信号。高级实现还会结合基于标注数据集训练的机器学习模型,随着处理数据的增多以及不断接收去重反馈,持续提升准确率。

AI 去重逻辑已成为几乎所有大规模数据运营领域不可或缺的工具。各类组织利用此技术保持数据集的干净和可靠,从而推动精准分析和科学决策。实际应用涵盖众多关键业务场景:

这些应用案例显示,去重对合规性、防欺诈和运营完整性等多领域都产生了直接影响。

AI 去重的财务和运营效益显著且可量化。通过消除冗余数据,企业可大幅降低存储成本,部分实践案例显示存储需求减少 20-40%。提升的数据质量也直接转化为更优的分析结果和决策能力,因为干净数据带来的洞察更可靠。研究显示,数据科学家约有80% 的时间花在数据准备上,其中重复记录是主要负担之一——自动去重可释放分析师宝贵时间用于更高价值的工作。调查还发现,典型数据库中10-30% 的记录可能有重复,这极大增加了低效和错误风险。除了节省成本,去重还能加强合规与监管,确保记录准确,杜绝因重复提交而引发的审计或处罚。运营效率提升还体现在更快的查询响应、降低的计算资源消耗以及系统可靠性的提高。

尽管 AI 去重技术先进,但仍存在需谨慎应对的挑战与局限。误判(误报)——将不同记录错当成重复项合并——可能导致数据丢失或本应分开的记录被合并,而漏判(未检出)则让实际重复内容漏网。面对多格式数据时,去重复杂性指数级增加,系统、语言、数据结构各异,格式与编码标准不一。分析敏感个人信息时还涉及隐私与安全问题,需使用强加密和访问控制,确保数据匹配过程中的安全。去重系统的准确性也受限于输入数据质量;垃圾数据会导致垃圾结果,残缺或损坏的记录会让最先进算法也束手无策。

AI 去重已成为现代AI 答案监控平台和多源信息聚合搜索系统的关键组成部分。当 AI 系统从众多文档和来源合成答案时,去重确保同一信息不会被重复计入,否则会导致信心分数虚高、相关性排序失真。通过去重,来源归属变得更为真实,用户能看到支持答案的证据多样性。像 AmICited.com 这样的平台,就是利用去重逻辑实现透明准确的来源追踪,识别多来源实质为同一内容并进行合并。这避免了 AI 答案表面看起来得到广泛支持,实际上却只是同一个信息被多次引用,从而维护了来源归属和答案可信度。通过过滤重复来源,去重提升了 AI 搜索结果的质量,确保用户看到的是真正多元的观点,而非同一内容的多次变体。该技术最终增强了用户对 AI 系统的信任,因为它为 AI 输出提供了更清晰、更诚实的证据基础。

AmICited 跟踪 GPT、Perplexity 和 Google AI 等系统如何在多个来源中引用您的品牌。确保来源归属准确,防止重复内容影响您的 AI 可见度。

了解查询重述如何帮助 AI 系统解释和增强用户查询,以实现更好的信息检索。掌握相关技术、优势及其对 AI 监控的影响。...

了解什么是 AI 内容整合,以及合并相似内容如何增强 ChatGPT、Perplexity 和 Google AI Overviews 的可见性信号。探索整合策略、工具和最佳实践。...

了解在使用 AI 工具时如何管理和防止重复内容。发现规范标签、重定向、检测工具及维护网站内容唯一性的最佳实践。

Cookie 同意

我们使用 cookie 来增强您的浏览体验并分析我们的流量。 See our privacy policy.