Dane treningowe

Dane treningowe to zbiór danych używany do nauki modeli ML wzorców i zależności. Dowiedz się, jak jakość danych treningowych wpływa na wydajność modeli AI, ich ...

Trenowanie na danych syntetycznych to proces uczenia modeli sztucznej inteligencji przy użyciu sztucznie wygenerowanych danych, a nie rzeczywistych, stworzonych przez ludzi informacji. Takie podejście rozwiązuje problem niedoboru danych, przyspiesza rozwój modeli i chroni prywatność, jednocześnie wprowadzając wyzwania, takie jak degradacja modeli czy halucynacje, które wymagają starannego zarządzania i walidacji.

Trenowanie na danych syntetycznych to proces uczenia modeli sztucznej inteligencji przy użyciu sztucznie wygenerowanych danych, a nie rzeczywistych, stworzonych przez ludzi informacji. Takie podejście rozwiązuje problem niedoboru danych, przyspiesza rozwój modeli i chroni prywatność, jednocześnie wprowadzając wyzwania, takie jak degradacja modeli czy halucynacje, które wymagają starannego zarządzania i walidacji.

Trenowanie na danych syntetycznych odnosi się do procesu uczenia modeli sztucznej inteligencji przy użyciu sztucznie wygenerowanych danych, zamiast rzeczywistych informacji pochodzących od ludzi. W przeciwieństwie do tradycyjnego trenowania AI, które opiera się na autentycznych zbiorach danych zebranych w wyniku ankiet, obserwacji lub przeszukiwania internetu, dane syntetyczne powstają dzięki algorytmom i metodom obliczeniowym, które uczą się wzorców statystycznych z istniejących danych lub generują całkowicie nowe dane od podstaw. Ta fundamentalna zmiana w metodologii trenowania odpowiada na kluczowe wyzwanie współczesnego rozwoju AI: wykładniczy wzrost zapotrzebowania na moc obliczeniową wyprzedził ludzką zdolność do generowania wystarczającej ilości rzeczywistych danych, a badania wskazują, że zasoby danych treningowych wytworzonych przez ludzi mogą zostać wyczerpane w ciągu najbliższych kilku lat. Trenowanie na danych syntetycznych oferuje skalowalną, efektywną kosztowo alternatywę, którą można generować w nieskończoność, bez czasochłonnych procesów zbierania, etykietowania i czyszczenia danych, które pochłaniają nawet 80% czasu w tradycyjnym rozwoju AI.

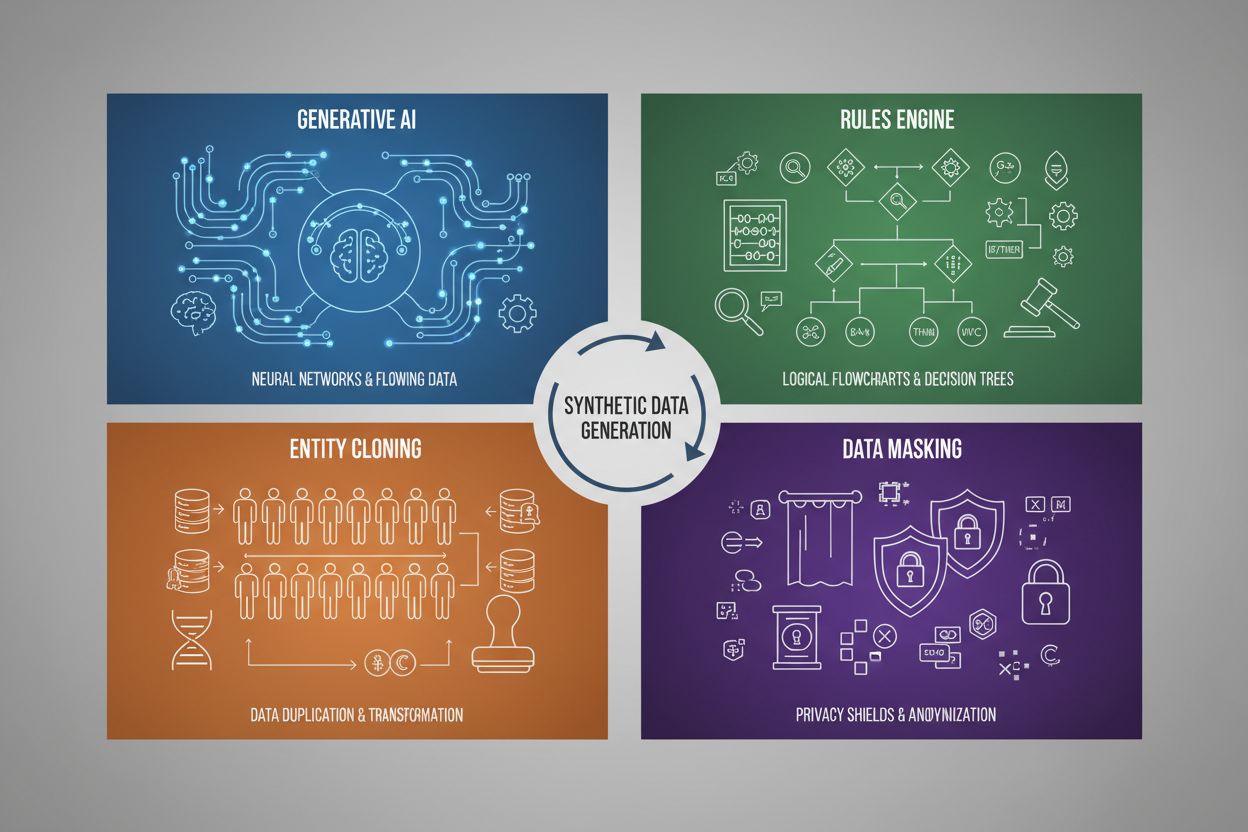

Generowanie danych syntetycznych wykorzystuje cztery główne techniki, z których każda ma odmienne mechanizmy i zastosowania:

| Technika | Na czym polega | Zastosowanie |

|---|---|---|

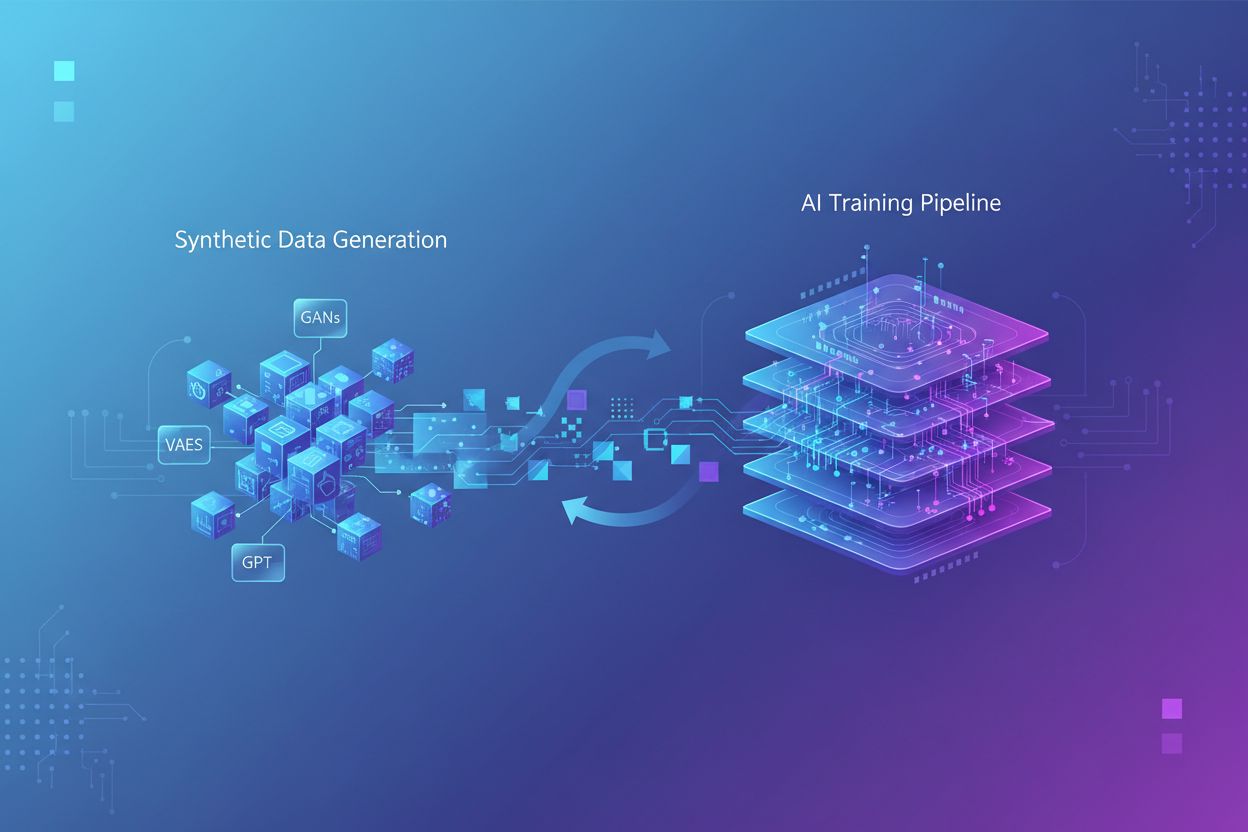

| Sztuczna inteligencja generatywna (GAN, VAE, GPT) | Wykorzystuje modele głębokiego uczenia do nauki wzorców statystycznych i rozkładów z danych rzeczywistych, a następnie generuje nowe próbki syntetyczne zachowujące te same właściwości i zależności. GAN-y używają sieci generującej i dyskryminującej, które wzajemnie się doskonalą, tworząc coraz bardziej realistyczne dane. | Trenowanie dużych modeli językowych jak ChatGPT, generowanie syntetycznych obrazów (np. DALL-E), tworzenie zróżnicowanych zestawów tekstu do przetwarzania języka naturalnego |

| Silnik reguł | Stosuje z góry określone reguły logiczne i ograniczenia, by generować dane zgodnie z logiką biznesową, wiedzą domenową lub wymaganiami prawnymi. Podejście deterministyczne, zapewniające zgodność z ustalonymi wzorcami, bez użycia uczenia maszynowego. | Dane transakcji finansowych, rejestry medyczne z określonymi wymogami prawnymi, dane z czujników przemysłowych o znanych parametrach pracy |

| Klonowanie encji | Duplikuje i modyfikuje istniejące rzeczywiste rekordy poprzez transformacje, zakłócenia lub wariacje, tworząc nowe instancje przy zachowaniu kluczowych własności statystycznych. Pozwala rozszerzyć zbiór danych bez utraty autentyczności. | Powiększanie ograniczonych zbiorów danych w branżach regulowanych, dane treningowe do diagnozowania rzadkich chorób, zwiększanie liczby przykładów klas mniejszościowych |

| Maskowanie i anonimizacja danych | Ukrywa wrażliwe dane osobowe (PII), zachowując strukturę i relacje statystyczne, stosując tokenizację, szyfrowanie lub podstawienie wartości. Pozwala uzyskać syntetyczne wersje danych rzeczywistych z zachowaniem prywatności. | Zbiory danych medycznych i finansowych, dane o zachowaniach klientów, wrażliwe informacje w badaniach naukowych |

Trenowanie na danych syntetycznych znacząco obniża koszty, eliminując drogie procesy zbierania, oznaczania i czyszczenia danych, które tradycyjnie pochłaniają dużo zasobów i czasu. Organizacje mogą generować nieograniczoną liczbę próbek treningowych na żądanie, radykalnie przyspieszając cykle rozwoju modeli i umożliwiając szybkie iteracje oraz eksperymenty bez oczekiwania na zebranie danych z rzeczywistości. Technika ta zapewnia potężne możliwości augmentacji danych, pozwalając deweloperom rozszerzać ograniczone zbiory danych i budować zbalansowane zestawy treningowe, rozwiązując problem niezrównoważonych klas – istotny tam, gdzie pewne kategorie są niedoreprezentowane w rzeczywistości. Dane syntetyczne są szczególnie wartościowe w zwalczaniu niedoboru danych w wyspecjalizowanych dziedzinach, takich jak obrazowanie medyczne, diagnoza rzadkich chorób czy testowanie pojazdów autonomicznych, gdzie zebranie odpowiedniej ilości przykładów realnych jest bardzo kosztowne lub nieetyczne. Zachowanie prywatności to kolejna istotna zaleta, ponieważ dane syntetyczne można generować bez ujawniania wrażliwych informacji osobowych – sprawdzają się więc idealnie do trenowania modeli na danych medycznych, finansowych czy innych regulowanych. Ponadto dane syntetyczne umożliwiają systematyczną redukcję uprzedzeń – programiści mogą celowo tworzyć zbalansowane, różnorodne zbiory, które przeciwdziałają dyskryminującym schematom obecnym w rzeczywistych danych, np. generując zróżnicowane demograficznie obrazy do treningu AI, by te nie powielały stereotypów płciowych czy rasowych w rekrutacji, finansach lub wymiarze sprawiedliwości.

Pomimo obietnic, trenowanie na danych syntetycznych wiąże się z istotnymi wyzwaniami technicznymi i praktycznymi, które mogą obniżyć wydajność modeli, jeśli nie będą odpowiednio zarządzane. Najważniejszym problemem jest degradacja modelu – zjawisko, w którym modele AI trenowane głównie na danych syntetycznych doświadczają poważnego spadku jakości, dokładności i spójności wyników. Wynika to z faktu, że dane syntetyczne, choć podobne statystycznie do rzeczywistych, nie oddają złożoności i przypadków brzegowych obecnych w autentycznych informacjach ludzkich – gdy modele uczą się na treściach generowanych przez AI, błędy i artefakty się nasilają, co prowadzi do stopniowej degradacji jakości kolejnych generacji danych syntetycznych.

Kluczowe wyzwania to:

Te wyzwania pokazują, że dane syntetyczne nie mogą całkowicie zastąpić rzeczywistych – muszą być starannie integrowane jako uzupełnienie autentycznych zbiorów, przy rygorystycznej kontroli jakości i nadzorze człowieka przez cały proces trenowania.

Wraz z rosnącym wykorzystaniem danych syntetycznych w trenowaniu modeli AI, marki stają przed nowym, kluczowym wyzwaniem: zapewnienie właściwej i korzystnej reprezentacji w wynikach i cytowaniach generowanych przez AI. Gdy duże modele językowe i systemy generatywne uczą się na danych syntetycznych, to właśnie jakość i charakter tych danych decydują o tym, jak marki są opisywane, rekomendowane i cytowane w wynikach wyszukiwania AI, odpowiedziach chatbotów czy automatycznie generowanych treściach. To rodzi poważne ryzyko dla bezpieczeństwa marki, ponieważ dane syntetyczne zawierające nieaktualne informacje, uprzedzenia konkurencyjne czy nieprecyzyjne opisy marki mogą zostać zakodowane w modelach AI, prowadząc do trwałego zniekształcenia wizerunku w milionach interakcji z użytkownikami. Dla organizacji korzystających z platform takich jak AmICited.com do monitorowania obecności marki w systemach AI, zrozumienie roli danych syntetycznych w trenowaniu modeli staje się niezbędne – marki potrzebują wglądu, czy cytowania i wzmianki AI pochodzą z rzeczywistych danych treningowych, czy ze źródeł syntetycznych, ponieważ wpływa to na wiarygodność i dokładność. Brak przejrzystości wokół wykorzystania danych syntetycznych w trenowaniu AI tworzy problemy z odpowiedzialnością: firmy nie mogą łatwo zweryfikować, czy ich wizerunek został prawidłowo odzwierciedlony w zbiorach syntetycznych używanych do trenowania modeli kształtujących percepcję konsumentów. Nowoczesne marki powinny priorytetowo traktować monitorowanie AI i śledzenie cytowań, by wcześnie wykrywać zniekształcenia, zabiegać o standardy transparentności wymagające ujawniania wykorzystania danych syntetycznych w trenowaniu AI oraz współpracować z platformami dostarczającymi wgląd w to, jak ich marka jest prezentowana w systemach AI uczonych zarówno na danych rzeczywistych, jak i syntetycznych. W miarę jak dane syntetyczne stają się dominującym paradygmatem trenowania do 2030 roku, monitorowanie marki przesunie się z tradycyjnego śledzenia mediów na kompleksowy wywiad AI dotyczący cytowań, a platformy śledzące obecność marki w systemach generatywnej AI staną się niezbędne do ochrony integralności marki i zapewnienia jej właściwego głosu w ekosystemie informacyjnym napędzanym przez AI.

Dowiedz się, jak Twoja marka jest reprezentowana w systemach AI trenowanych na danych syntetycznych. Śledź cytowania, monitoruj dokładność i dbaj o bezpieczeństwo marki w ekosystemie informacji napędzanym przez AI.

Dane treningowe to zbiór danych używany do nauki modeli ML wzorców i zależności. Dowiedz się, jak jakość danych treningowych wpływa na wydajność modeli AI, ich ...

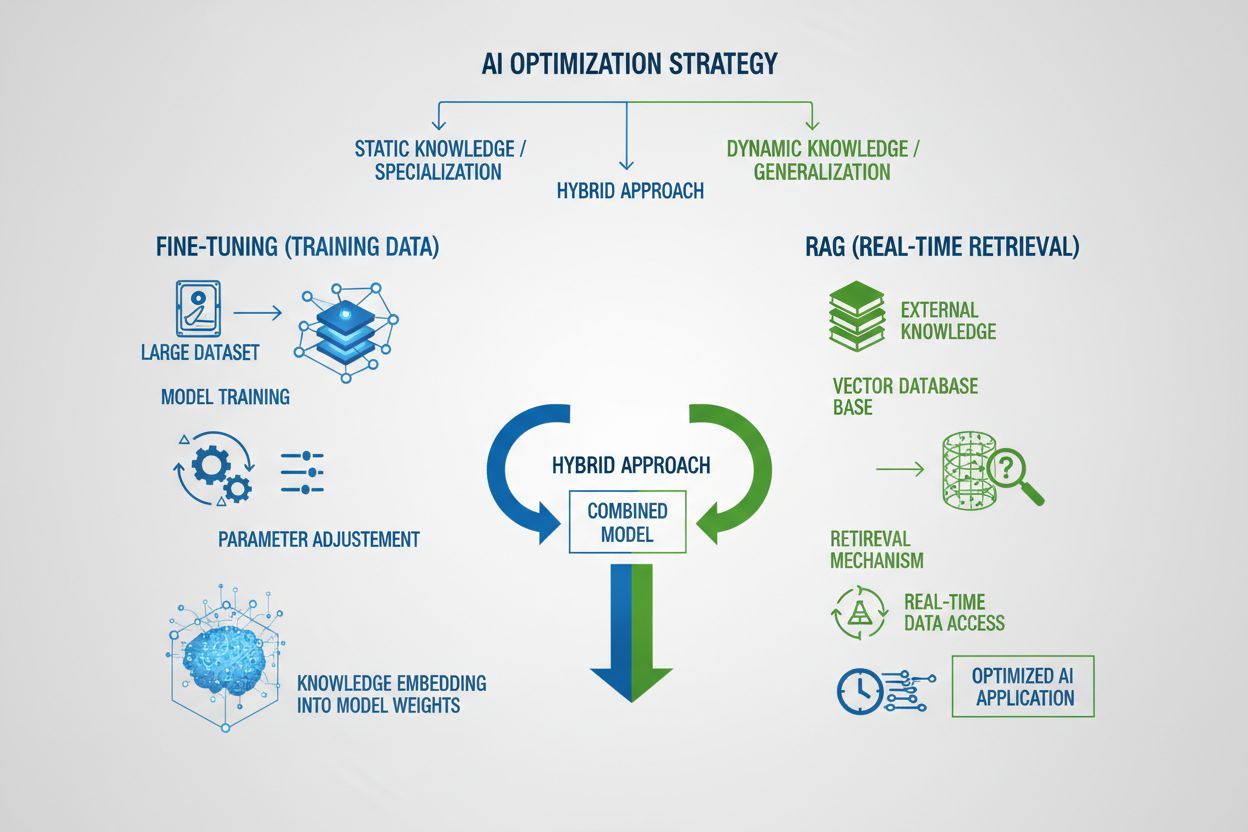

Porównaj optymalizację danych treningowych i strategie pobierania w czasie rzeczywistym dla AI. Dowiedz się, kiedy używać fine-tuningu, a kiedy RAG, jakie są ko...

Dyskusja społecznościowa o wpływaniu na dane treningowe AI dotyczące Twojej marki. Rzetelne spostrzeżenia na temat tego, jak tworzenie treści wpływa na to, czeg...

Zgoda na Pliki Cookie

Używamy plików cookie, aby poprawić jakość przeglądania i analizować nasz ruch. See our privacy policy.